Artificial Intelligence

AIハードウェアへの投資:CPUからXPUまで

Securities.ioは厳格な編集基準を維持しており、レビューされたリンクから報酬を受け取る場合があります。当社は登録投資顧問ではなく、これは投資アドバイスではありません。 アフィリエイト開示.

AIハードウェアへの投資:ピックとシャベルのアプローチ

AIは、過去数十年間で私たちの経済、生産システム、社会に最も重要な変化をもたらすと期待されており、比較するとインターネットがもたらした根本的な変化さえも些細なものにしてしまう可能性があります。

ドライバー、翻訳者、カスタマーサポート、Web デザイナーなど、職種の全体が消滅する可能性があります。プログラマー、初級弁護士、診断士など、他の職種では需要が急激に減少する可能性があります。

また、他の多くのタスクにも大きな付加価値と生産性がもたらされるはずで、有力な AI ソフトウェア企業は、これまで想像もできなかった時価総額に到達する最初の企業になる可能性が高い。

これらの理由から、資本市場と投資家はAIに魅了されており、AI分野の多くのテクノロジー大手の進歩と、中国のテクノロジー大手による激しい競争に大きな注目を払っています。 アリババ そしてスタートアップ企業 ディープシーク.

AIブームに乗るもう一つの方法は、ゴールドラッシュで効果を発揮することが知られている戦略に従うことです。金を探すのではなく、つるはしとシャベルを売るのです。これは、AIに最適化されたハードウェアを販売するのに絶好の位置にいた企業にとっては確かに効果的でした。 Nvidia (NVDA ) ゲーミンググラフィックカードをAIトレーニングチップに変え、時価総額が驚異の4兆ドルを超え、世界で最も価値のある企業となった。Nvidiaの完全なレポートについてはリンクをご覧ください).

AI は、これまでのコンピューティング タスクとはまったく異なる非常に特殊なハードウェアを必要とし、非常に大きなビジネス チャンスでもあるため、半導体業界は現在、AI プログラムのトレーニングと実行専用に設計された新しい形式のハードウェアの開発を競っています。

Nvidia は今後もこの分野でトップクラスの企業であり続ける可能性が高いが、現在では代替企業が台頭しており、早期に注目する投資家にとっては興味深い投資機会となる可能性がある。

AIに専用ハードウェアが必要な理由

多くの小さな計算

AIにおける初期の取り組みでは、他のプログラムと同じ計算能力が使用され、主にプロセッサ(中央処理装置、CPU)に重点が置かれていました。CPUは今でも重要ですが、現在AI開発に使用されているほとんどの手法には最適ではないことがすぐに明らかになりました。

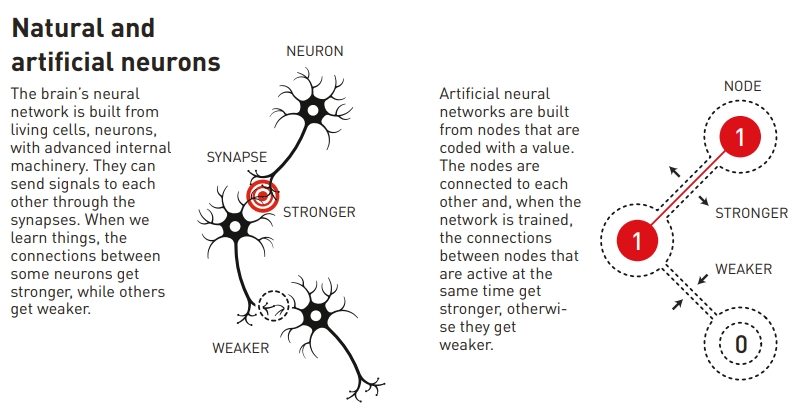

ニューラルネットワークなどの類似手法では、非常に複雑な計算を1つ行うのではなく、比較的単純な計算を多数実行する必要があります。そのため、大規模で強力なCPUよりも、多数の小型チップを並列に動作させる方が一般的に効果的です。

グラフィック カードは本質的に何千もの小さな計算を並行して実行するように設計されているため、GPU が急速に普及した主な理由です。

今日のAIトレーニングは主にニューラルネットワークに基づいており、 このコンセプトは2024年にノーベル物理学賞を受賞しました。この賞については当時特集記事で詳しく取り上げました。.

出典: ノーベル賞

AI技術における第二の革命は「トランスフォーマー」によってもたらされた。彼らは従来のニューラルネットワークの 長いデータ列を効率的に処理できないこと。これはあらゆる自然言語に共通する特徴である。.

2017年にGoogleの研究者によって初めて導入されたTransformerは、現在のAI能力の爆発的な向上の根本原因です。ChatGPTを含むLLM(大規模言語モデル)などのAI製品の中核を成しています。

さまざまな要件

AIワークフローにおける重要な違いの1つは、 微調整 および推論であり、どちらも異なるハードウェア要件があります。

- 微調整 特定のドメインデータを用いてモデルを学習させる必要があり、膨大な計算能力とメモリを必要とします。これは非常に技術的なタスクであり、AI科学の最先端に位置する場合が多いです。

- 推論 すでにトレーニング済みのモデルを使用して出力を生成することに重点を置いており、必要な計算能力は少なくなりますが、低レイテンシとコスト効率に重点が置かれます。

- これは、AI の専門家が既存のモデルを展開して現実の問題を解決する際に、より日常的に行われる作業です。

したがって、コストは AI の微調整/トレーニングと推論/使用の両方において明らかに懸念事項ですが、トレーニングでは可能な限り最高のハードウェアが必要になることが多く、使用タスクでは最適なハードウェア オプションを選択する際にハードウェアのコストとエネルギー消費に重点が置かれることになります。

CPUとGPU

中央処理装置 (CPU):

CPUは汎用的なものであり、AI専用のハードウェアではありません。しかし、AIシステムにおける命令の実行や基本的な計算には依然として不可欠です。

AI システムの最終ユーザーとのインターフェースを処理するソフトウェアのほとんども、個々のコンピューターであれクラウドベースのソフトウェアであれ、CPU 中心になります。

出典: アナンドテック

CPUは、専用ハードウェアをあまり必要としない非常にシンプルなAIにも使用できます。特に、出力がそれほど緊急性がなく、CPUのAI処理速度が比較的遅いことが問題にならない場合に有効です。

そのため、データと計算量が少ない小規模なモデルであれば、CPUで良好なパフォーマンスを発揮できます。CPUは一般的なコンピューターに広く搭載されているため、AI専用のハードウェアに投資したくない一般ユーザーにとってもCPUは優れた選択肢となります。

CPU は信頼性と安定性も非常に高いため、エラーがないことが必要不可欠な重要なタスクに最適です。

最後に、CPU は、データの読み込み、フォーマット、フィルタリング、視覚化など、他の種類のハードウェアと連携して AI トレーニングの一部のタスクに役立ちます。

グラフィックスプロセッシングユニット(GPU):

もともとグラフィックレンダリング用に設計されたGPUは、並列処理向けに設計されており、大規模なデータセットの処理を必要とするAIモデルのトレーニングに最適です。CPUからGPUへの移行により、トレーニング時間は数週間から数時間に短縮されました。

GPU は広く利用可能であり、IT スペシャリストが GPU を扱った経験もあったため、AI 研究を拡大するためにシリーズで導入される最初のタイプのコンピューティング ハードウェアでした。

出典: アオラス

GPUの成功に大きく貢献したのは、NVIDIA社によるCUDAの開発です。CUDAはNVIDIA社製GPU向けの汎用プログラミングインターフェースで、ゲーム以外の用途への道を開きました。これは、一部の研究者が既にスーパーコンピュータの代わりにGPUを計算に使用していたことによるものです。

「研究者たちは、GeForceと呼ばれるこのゲーミングカードを購入し、それをコンピュータに追加することで、実質的に個人用スーパーコンピュータを手に入れることができることに気づきました。

分子動力学、地震処理、CT再構成、画像処理など、実にさまざまなものがあります。」

現在でも、GPU は AI ハードウェアの中で最も人気のある種類の 1 つであり、Nvidia はギガワット規模の AI データセンターを構築するテクノロジー大手の需要を満たすのに十分な GPU をかろうじて生産できている状態です。

これはまた、「スーパーGPU時代」の始まりでもあり、Nvidiaの最近のリリースでは GB200 NVL72.

このハードウェアは、多数の小型GPUをネットワークで接続するのではなく、工場出荷時から単一の巨大なGPUとして機能するように設計されています。これにより、以前の記録破りのH100モデルよりもはるかにパワフルになっています。

出典: Nvidia

これにより、エネルギー効率も大幅に向上するはずです。これは、AIデータセンターの建設が現在のようなスピードで進んでいるため、AI業界はチップ不足よりも先にエネルギー不足に陥る可能性があるため、非常に重要なポイントです。また、コンピューティングとエネルギー効率の向上は、廃熱の削減を意味し、過熱の問題も一時的に解決します。

| ハードウェアタイプ | 最適な使用例 | 速度 | エネルギー効率 | 柔軟性 |

|---|---|---|---|---|

| CPU | 汎用タスク | ロー | ハイ | すごく高い |

| GPU | AIトレーニングと並列タスク | ハイ | 技法 | 技法 |

| TPU | テンソル演算とトランスフォーマー | すごく高い | ハイ | ロー |

| ASIC | シングルタスクの加速 | すごく高い | すごく高い | とても低い |

| FPGA | 再構成可能なAIワークロード | 技法 | 技法 | ハイ |

ASICとAIハードウェアの台頭

ASIC (特定用途向け集積回路) は、特定のコンピューティング タスク専用に設計されたコンピューティング ハードウェアであり、比較的汎用的な GPU よりもさらに特殊化されています。

そのため、汎用ハードウェアに比べて柔軟性とプログラム性が低くなります。

一般的に、それらはより複雑になる傾向があります。また、生産における規模の経済性の欠如とカスタム設計のコストの両方により、一般的にコストも高くなります。

しかし、それらは与えられたタスクにおいてはるかに効率的であり、通常、無駄な計算能力とエネルギーを大幅に削減して、より速く出力を生成します。

一部の計算は GPU では理想的には実行できず、より特殊な機器が必要であることが業界で徐々に認識されるようになり、ASIC やその他の AI 専用ハードウェアの利用が増加しています。

テンソルプロセッシングユニット(TPU)

TPUはGoogleによって開発された (GOOGL ) テンソル計算(トランスフォーマーベースの計算にリンク)に特化したものです。高スループット、低精度演算に最適化されています。

出典: C#コーナー

これにより、TPU は大規模なニューラル ネットワークのトレーニングにおいて高いパフォーマンス、効率、スケーラビリティを実現します。

TPU は、マトリックス乗算ユニット (MXU) や独自の相互接続トポロジなどの特殊な機能を備えており、AI のトレーニングと推論を加速するのに最適です。

TPU は、Gemini や、検索、フォト、マップなどの Google の AI を活用したすべてのアプリケーションに搭載されており、1 億人を超えるユーザーにサービスを提供しています。

このタイプのハードウェアは、ニューラル ネットワークの開発と動作を大幅に高速化できます。これらのモデルは、そもそも統計と大量の計算に大きく依存しているため、偶発的なエラーはそれほど重要ではありません。

エンドユーザータスクの中で、TPU に最も適しているのは、ディープラーニング、音声認識、画像分類です。

ニューラル ネットワーク プロセッサ (NNP):

ニューラル・プロセッシング・ユニット(NPU)にも接続され、ニューロモルフィック・チップと呼ばれるNPPは、ニューラルネットワーク計算に特化しており、人間の脳の神経接続を模倣するように設計されています。AIアクセラレータと呼ばれることもありますが、この用語の定義は明確ではありません。

NPUはシナプス重みを介してストレージと計算処理も統合します。これにより、時間の経過とともに調整(学習)が可能になり、運用効率が向上します。

NPU には、乗算と加算、アクティベーション関数、2D データ操作、および解凍のための特定のモジュールが含まれています。

特殊な乗算および加算モジュールは、行列の乗算と加算、畳み込み、ドット積、その他の関数の計算など、ニューラル ネットワーク アプリケーションの処理に関連する操作を実行するために使用されます。

この特殊化により、NPUは汎用ハードウェアで数千回の計算をする必要がなくなり、たった1回の計算で処理を完了できるようになります。例えば、 IBMは、NPUはGPUと比較してAI計算の効率を大幅に向上できると主張している。.

「テストでは、同じ消費電力で、一部の NPU のパフォーマンスが同等の GPU より 100 倍以上優れていることが示されました。」

このエネルギー効率の高さから、NPU はメーカーの間でユーザーデバイスへのインストールに人気があり、生成 AI アプリのローカルタスクの実行に役立ちます。これは「エッジコンピューティング」の一例です (このトピックの詳細については、以下を参照してください)。

ニューロモルフィック チップを作成する方法については、現在さまざまな方法が検討されています。

- 初期の強誘電性を活用するまだ十分に理解されていない現象です。

- バナジウムまたはチタンを使用した活性基板.

- メモリスタの使用、新しいタイプの電子部品であり、 AIタスクを1/800で実行th通常の電力消費量の.

A補助 P伐採 U寄生虫の卵 (XPU)

XPU は、CPU (プロセッサ)、GPU (グラフィック カード/並列プロセッサ)、およびメモリを同じ電子デバイスに統合します。

出典: ブロードコム

XPUは幅広い用語であり、すべてのハードウェアを独立したユニットにまとめるというコンセプトのさまざまなバリエーションを包含しています。 データ処理ユニット (DPU), インフラストラクチャ処理ユニット(IPU)、および 機能アクセラレータカード(FAC).

XPU は、AI データ センターの増大する問題を解決するものとして考えられています。この課題とは、サブユニット間の接続性に対するニーズが高まり、利用可能なコンピューティング能力以上に、データの遅延がコンピューティング速度を低下させる重要な要因となることです。

基本的に、チップ (GPU、TPU、NPP など) は、実際に動作しているのと同じくらいデータを待機しています。

この技術のリーダーはブロードコムである。 (AVGO )、その 専用の投資レポートで詳細に議論しました.

フィールドプログラマブルゲートアレイ (FPGA):

FPGAはプログラム可能なプロセッサであり、より柔軟性が高く、再構成が容易です。特定のAIアルゴリズムに合わせてカスタマイズできるため、より高いパフォーマンスとエネルギー効率を実現できる可能性があります。

出典: マイクロコントローララボ

FPGAは一般的に複雑で高価であり、消費電力も大きいため、柔軟性には代償が伴います。しかし、汎用的なハードウェアよりも効率性が高いという利点もあります。

そのため、FPGAはニッチな製品と位置付けられ、その柔軟性が欠点を補っています。例えば、機械学習、コンピュータービジョン、自然言語処理などは、FPGAの汎用性から恩恵を受けることができます。

高帯域幅メモリ (HBM):

AI 中心のカスタム ハードウェアにおける最も重要な開発はコンピューティング能力の分野にあり、これは長い間、新しい AI をトレーニングするためのコンピューティング能力をさらに構築する際のボトルネックとなってきました。

それでも、これらのシステムには高効率のサポートシステムも必要であり、その中でもメモリは重要な要素です。HBMは、その名が示すように、従来のDRAMよりも高い帯域幅を提供します。

これは、複数のDRAMダイを垂直に積み重ね、それらをシリコン貫通ビア(TSV)で接続することで実現されます。HBMの第一世代は2013年に開発されました。

垂直スタッキングによりスペースが節約され、データが移動する物理的な距離が短縮され、AI コンピューティングに必須のデータ転送が高速化されます。

HBM は DRAM よりも製造が複雑で高価ですが、パフォーマンスと電力効率の利点により、AI アプリケーションではコストの高さが正当化されることがよくあります。

AIデータセンターインフラストラクチャ:電力、冷却、接続

AIデータセンターでは、メモリと計算能力に加え、補助システムも重要です。これらがなければ、データの循環速度が十分でなかったり、チップが過熱したり、電力が不足したりする可能性があります。

これは、例えばブロードコムの接続ハードウェアもAIデータセンターの構築から大きな恩恵を受けるということであり、冷却装置サプライヤーのような特殊なソリューションも同様である。例えば、Vertiv (VRT ) またはシュナイダーエレクトリック(スーパ).

電力供給も問題になる可能性があり、いくつかのテクノロジー大手は原子力エネルギーに賭けてこの問題に取り組もうとしている。 2024年にマイクロソフトが最初の動きを見せ、その後も多数続きました。

AIの二酸化炭素排出量削減へのテクノロジー企業の取り組みと組み合わせることで、原子力や再生可能エネルギー分野の企業に大きな利益をもたらすはずです。 Cameco (CCJ ), GEベルノバ (GEV ), ファースト・ソーラー (FSLR ), ネクステラ (NEE )または ブルックフィールド・エナジー・パートナーズ (BEP ) (各企業のレポートについてはリンクをご覧ください)。

新興AIコンピューティング技術

量子コンピューティング

AI は計算能力を非常に必要とするため、この分野のハードウェアの将来は、現在利用可能なシリコン ソリューションでは対応できない可能性があります。

一つの可能性は、量子コンピューティングが従来のコンピューティングよりもはるかに効率的にパターンを検出できる可能性があることだ。 研究者によってすでに研究されているもの.

量子コンピューティングは全体として、バイナリコンピューティングではほぼ不可能な特定の計算を解くために利用できる可能性があります。これは最終的にはAIに応用される可能性が高いですが、最初の商用量子コンピュータの実現にはまだ数年かかり、大規模な量子ネットワークの実現はさらに先のことです。

フォトニクス

電子の代わりに光を使ってデータを伝送するフォトニクスは、電子デバイスよりもはるかに高速になる可能性があります。

量子コンピュータは通常、量子データをもつれた光子で運ぶため、量子コンピューティングと光子学の間にも多くの重複があり、 最初のデュアル量子光子チップはすでに発表されている.

オルガノイド

ほとんどの AI は脳のニューラル ネットワークの機能をコンピューターで再現するため、代わりに実際の脳細胞を使用できないかと考える研究者もいます。

これは興味深いアイデアです。特に いくつかの研究は、脳が実際には有機的な量子コンピュータであることを示唆している可能性がある。.

この種の「コンピューター」はオルガノイドと呼ばれ、基本的には実験室でコンピューターチップ上に培養されたニューロンで構成されています。ニューロンはチップからの刺激に応じて、樹状突起と神経接続を自己組織化します。

この技術はまだ新しく、 バイオ3Dプリンティング.

その他

私たちはシリコンコンピューティングの代替案を「シリコン以外のコンピューティング企業トップ10二酸化バナジウム、グラフェン、酸化還元ゲート、有機材料などの「ナノテクノロジー」分野における応用が期待されています。

いずれも、従来のシリコンベースのコンピューティングよりもはるかに高速、あるいははるかに低消費電力であることが期待されています。しかし、これらはまだ比較的新しい技術であり、少なくとも今後5~10年間は、商用規模でAI分野に革命を起こす可能性は低いでしょう。

クラウドAIとエッジAI:アクセシビリティのトレンド

クラウドAI

最も強力なAIシステムは大手テクノロジー企業によって開発されているため、そのほとんどはクラウド経由でアクセスできます。AI専用ハードウェアへのアクセスも同様になりつつあります。

このトレンドのリーダーは コアウィーブ (CRCW )は、クラウド プロバイダーから GPU を使用した暗号通貨マイニングに移行し、現在はオンデマンドの AI コンピューティングを提供する企業です。

これにより、CoreWeaveは、テクノロジー大手と競争しようとする新興AIスタートアップの重要なパートナーとなった。 屈折AI とその 1.3億ドルのGPUクラスター新たな資金調達ラウンドによって資金提供を受けた。

「500か月前には存在しなかった会社が、今ではXNUMX億ドルのベンチャーキャピタル資金を得ているかもしれません。

そして、彼らにとって最も重要なことは、コンピューティングへのアクセスを確保することです。それがなければ、製品やビジネスを立ち上げることはできません。」

AIハードウェアの純粋なプレイヤーが、大手テクノロジー企業が独自のGPU、TPU、XPUなどを生産し、クライアントから競合企業へと進化していることに警戒するようになるにつれ、CoreWeaveのような企業がNvidiaなどの最新ハードウェアリリースへの優先的なアクセスを得る可能性が高くなるでしょう。

このビジネス モデルは、すでにトレーニング済みの AI を使用するだけよりも、はるかに高いコンピューティング能力が要求される AI トレーニングにとって特に重要になるでしょう。

エッジコンピューティングとAI PC

急速に進化している AI コンピューティングのもう 1 つの事例は、AI システムのコンピューティングを実際の状況にできるだけ近い場所で実行する必要性です。

これは、接続が失敗した場合や、クラウドとのやり取りの遅延が遅すぎる場合に AI から切断されることを許容しない可能性のあるシステムには必須です。

良い例は自動運転車で、オフラインで環境の理解を実行することが期待されています。

このタイプの計算はエッジ コンピューティングと呼ばれ、より効率的で電力消費の少ないハードウェアから大きな恩恵を受けます。

これにより AI の信頼性が向上し、DeepSeek の飛躍的な進歩に見られるようにモデルがより効率的になるにつれ、将来的には AI 導入のより一般的なモデルになる可能性があります。

同じ理由で、AI PC Nvidiaが最近発売したもののように長期的には、多くの AI アプリケーションをローカルで実行するのに十分であり、クラウド AI に常時接続する場合と比べてプライバシーとセキュリティが向上する可能性があります。

結論

AIハードウェアは、しばらくの間、GPUとほぼ同義語でした。グラフィックカードはCPUなどの他の種類のハードウェアよりもAIトレーニングにおいてはるかに効率的だったためです。これがNVIDIAとその初期の株主の多くに富をもたらしました。

GPU、特にAIに特化した「スーパーGPU」は、AIデータセンターの構築において今後も重要な役割を担う可能性が高い。しかし、GPUはますます複雑化・特化していくシステムにおける、単なるコンポーネントの一つへと進化していくだろう。

トランスフォーマー操作は TPU に送信され、ニューラル ネットワークは NPP にタスクが割り当てられ、繰り返しタスクは専用の ASIC または再構成された FPGA に送信されます。

一方、高帯域幅メモリ、高度な通信コネクタ、超効率的な冷却により、コンピューティング コア周辺のすべての補助機能が稼働し続けます。

エッジコンピューティングや、大規模な LLM よりも小規模な AI の場合、おそらくオールインワン XPU を搭載したローカルコンピューティングは、科学者、自動運転車、プライバシーや検閲を懸念するユーザーによって、オープンソースの AI モデルとともに使用される可能性があります。

確かなのは、AIゴールドラッシュでAIハードウェアの「つるはしとシャベル」を売って得られる利益は、まだまだ終わっていないということだ。

Nvidia による独占期間が終わった後、投資家は IA ハードウェア ポートフォリオを他の設計に広げることでリスクを分散したいと考えるかもしれません。また、世界中でますます大規模かつ数が増えている AI データ センターを稼働させるために貴重なギガワットを供給する電力会社にまで広げたいと考えるかもしれません。