Inteligencia Artificial

Invertir en hardware de IA: desde CPU hasta XPU

Securities.io mantiene rigurosos estándares editoriales y podría recibir una compensación por los enlaces revisados. No somos asesores de inversiones registrados y esto no constituye asesoramiento de inversión. Consulte nuestra divulgación de afiliados.

Invertir en hardware de IA: un enfoque de picos y palas

La IA promete ser el cambio más importante en nuestra economía, sistemas productivos y sociedad en las últimas décadas, haciendo que incluso los cambios radicales introducidos por Internet resulten triviales en comparación.

Podría hacer desaparecer una categoría entera de empleos, incluidos conductores, traductores, atención al cliente, diseñadores web, etc. Otros empleos podrían ver una reducción radical en la demanda, como programadores, abogados principiantes, diagnosticadores, etc.

También debería crear mucho valor adicional y productividad para muchas otras tareas, y las empresas dominantes de software de IA probablemente serán las primeras en alcanzar capitalizaciones de mercado previamente inimaginables.

Por todas estas razones, los mercados de capitales y los inversores han quedado fascinados por la IA y prestan mucha atención al progreso de los numerosos gigantes tecnológicos en IA, así como a la fuerte competencia que surge de gigantes tecnológicos chinos como Alibaba y startups como búsqueda profunda.

Otra forma de aprovechar el auge de la IA es seguir la estrategia que funciona en toda fiebre del oro: no buscar oro, sino vender picos y palas. Esto sin duda ha funcionado para las empresas que estaban en la mejor posición para vender hardware optimizado para IA, con Nvidia (NVDA + 0.5%) habiendo convertido sus tarjetas gráficas para juegos en chips de entrenamiento de IA, convirtiéndose en la empresa más valiosa del mundo, habiendo superado la asombrosa capitalización de mercado de 4 billones de dólares (Siga el enlace para obtener un informe completo sobre Nvidia).

Debido a que la IA requiere un hardware muy específico, en su mayoría diferente de otras formas anteriores de tareas informáticas, y es una oportunidad comercial tan enorme, la industria de los semiconductores ahora está en una carrera para desarrollar nuevas formas de hardware diseñadas específicamente para entrenar y ejecutar programas de IA.

Si bien es probable que Nvidia siga siendo una de las principales empresas del sector, ahora están surgiendo alternativas que podrían brindar oportunidades interesantes para los inversores que presten atención tempranamente.

Por qué la IA necesita hardware especializado

Muchos pequeños cálculos

Los esfuerzos iniciales en IA utilizaron la misma capacidad de procesamiento que otros programas, centrándose principalmente en los procesadores (Unidad Central de Procesamiento, CPU). Si bien las CPU siguen siendo importantes, pronto se demostró que no son óptimas para la mayoría de los métodos utilizados actualmente para desarrollar IA.

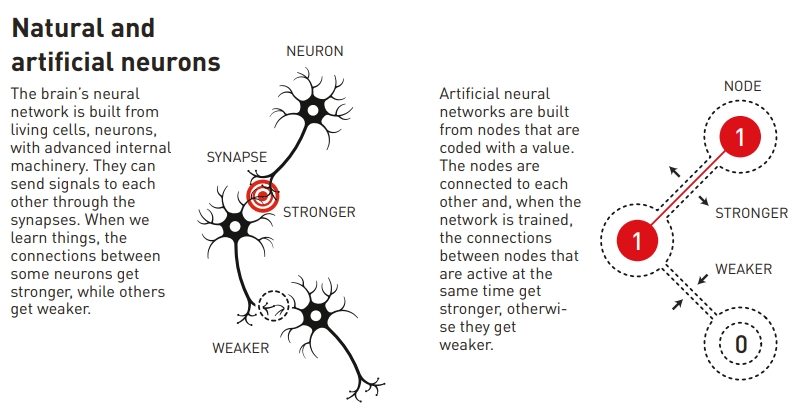

Las redes neuronales y otros métodos similares requieren muchos cálculos relativamente simples, en lugar de un solo cálculo complejo. Tener tantos chips pequeños trabajando en paralelo suele ser mejor que usar CPUs enormes y potentes.

Esta es en gran parte la razón por la que las GPU se volvieron rápidamente más populares, ya que las tarjetas gráficas están diseñadas inherentemente para realizar miles de cálculos más pequeños en paralelo.

El entrenamiento de IA actual se basa en gran medida en redes neuronales, Un concepto que ganó el Premio Nobel de Física en 2024, un premio que cubrimos en detalle en un artículo dedicado en ese momento..

Fuente: Premio Nobel

Una segunda revolución en la tecnología de IA llegó con los "transformadores". Estos resuelven los problemas de las redes neuronales tradicionales. incapacidad de procesar eficientemente largas secuencias de datos, una característica común de cualquier lenguaje natural.

Introducido por primera vez en 2017 por investigadores de Google, es la causa principal del auge actual de la capacidad de IA. Los transformadores son la base de productos de IA como los LLM (modelos de lenguaje grandes), incluido ChatGPT.

Diferentes requisitos

Una distinción importante en los flujos de trabajo de IA es la diferencia entre sintonia FINA e inferencia, ambas con requisitos de hardware distintos.

- Sintonia FINA Implica entrenar un modelo con datos específicos del dominio, lo que requiere una gran capacidad de procesamiento y memoria. Es una tarea muy técnica, a menudo en la vanguardia de la IA.

- Inferencia Se centra en el uso de un modelo ya entrenado para generar resultados, lo que exige menos potencia computacional pero un mayor enfoque en la baja latencia y la rentabilidad.

- Los expertos en IA hacen esto de forma más rutinaria al implementar modelos preexistentes para resolver problemas de la vida real.

Entonces, si bien los costos son obviamente una preocupación tanto para el ajuste/entrenamiento como para la inferencia/uso de la IA, el entrenamiento a menudo requerirá el mejor hardware posible, mientras que las tareas de uso se centrarán más en el costo del hardware y el consumo de energía al elegir la mejor opción de hardware.

CPU vs GPU

Unidades centrales de procesamiento (CPU):

Las CPU son de propósito general y no son hardware específico de IA. Sin embargo, siguen siendo esenciales para ejecutar instrucciones y realizar cálculos básicos en sistemas de IA.

La mayor parte del software que gestiona la interfaz con los usuarios finales de un sistema de IA también estará centrado en la CPU, ya sean computadoras individuales o software basado en la nube.

Fuente: AnandTech

Las CPU también pueden utilizarse para IA muy sencillas, donde no se requiere hardware dedicado. Esto es especialmente cierto cuando el resultado no es especialmente urgente y el procesamiento relativamente más lento de las CPU para IA no supone un problema.

Por lo tanto, los modelos pequeños con lotes reducidos de datos y cálculos pueden funcionar bien en las CPU. La omnipresencia de las CPU en los ordenadores convencionales también las convierte en una buena opción para el usuario promedio que no esté dispuesto a invertir en hardware específico para IA.

Las CPU también son muy confiables y estables, lo que las convierte en una buena opción para tareas críticas donde ningún error es un criterio importante.

Por último, las CPU son útiles para algunas de las tareas del entrenamiento de IA, generalmente en colaboración con otros tipos de hardware, como la carga, el formato, el filtrado y la visualización de datos.

Unidades de procesamiento de gráficos (GPU):

Diseñadas originalmente para la renderización de gráficos, las GPU están diseñadas para el procesamiento paralelo, lo que las hace ideales para entrenar modelos de IA que requieren el manejo de grandes conjuntos de datos. El cambio de CPU a GPU ha reducido los tiempos de entrenamiento de semanas a horas.

Debido a su amplia disponibilidad y la experiencia de los especialistas en TI que trabajan con ellas, las GPU fueron el primer tipo de hardware informático que se instaló en serie para ampliar la investigación en IA.

Fuente: Aorus

Otro factor decisivo para el éxito de las GPU fue el desarrollo de CUDA por parte de Nvidia, una interfaz de programación de propósito general para las GPU de NVIDIA, que abrió la puerta a otros usos además de los videojuegos. Esto se debió a que algunos investigadores ya utilizaban las GPU para realizar cálculos en lugar de las supercomputadoras habituales.

“Los investigadores se dieron cuenta de que al comprar esta tarjeta de juego llamada GeForce y agregarla a tu computadora, esencialmente tienes una supercomputadora personal.

Dinámica molecular, procesamiento sísmico, reconstrucción por TC, procesamiento de imágenes… un montón de cosas diferentes”.

Hoy en día, las GPU siguen estando entre los tipos de hardware de IA más buscados, y Nvidia apenas logra producir lo suficiente para satisfacer la demanda de los gigantes tecnológicos que construyen centros de datos de IA a escala de gigavatios.

También es el comienzo de la “era de las súper GPU”, con el reciente lanzamiento por parte de Nvidia de El GB200 NVL72.

Este hardware está diseñado para funcionar como una sola GPU enorme desde fábrica, en lugar de tener que conectar en red muchas GPU pequeñas. Esto lo hace mucho más potente que incluso el anterior modelo H100, que batió récords.

Fuente: Nvidia

Esto también debería ser mucho más eficiente energéticamente, un punto crucial, ya que la industria de la IA podría quedarse sin energía antes de quedarse sin chips al ritmo al que se construyen los centros de datos de IA. Además, una mayor eficiencia computacional y energética implica menos calor residual, lo que también soluciona temporalmente el problema del sobrecalentamiento.

| Tipo de hardware | Mejor caso de uso | Speed (Rapidez) | Eficiencia energética | Flexibilidad |

|---|---|---|---|---|

| CPU | Tareas de propósito general | Bajo | Alto | Muy Alta |

| GPU | Entrenamiento de IA y tareas paralelas | Alto | Media | Media |

| TPU | Operaciones tensoriales y transformadores | Muy Alta | Alto | Bajo |

| ASIC | Aceleración de una sola tarea | Muy Alta | Muy Alta | Muy Bajo |

| FPGA | Cargas de trabajo de IA reconfigurables | Media | Media | Alto |

El auge de los ASIC y el hardware de IA

Los circuitos integrados de aplicación específica (ASIC) son hardware informático diseñado específicamente para una tarea informática determinada, lo que los hace incluso más especializados que las GPU, que todavía son relativamente generalistas.

Por lo tanto, son menos flexibles y programables que el hardware de uso general.

Por lo general, suelen ser más complejos. También suelen ser más costosos, tanto por la falta de economías de escala en su producción como por el coste de los diseños a medida.

Sin embargo, son mucho más eficientes en su tarea asignada y normalmente producen un resultado más rápido con mucho menos energía y potencia computacional desperdiciadas.

Los ASIC y otros hardware específicos de IA están aumentando su uso, ya que el campo está notando progresivamente que algunos cálculos no se realizan idealmente en las GPU, sino que requieren equipos más especializados.

Unidades de procesamiento tensorial (TPU)

Las TPU fueron desarrolladas por Google (GOOGL -0.67%) Específicamente para realizar cálculos tensoriales (vinculados al cálculo basado en transformadores). Están optimizados para operaciones aritméticas de alto rendimiento y baja precisión.

Fuente: C#Corner

Esto proporciona a las TPU alto rendimiento, eficiencia y escalabilidad para el entrenamiento de grandes redes neuronales.

Las TPU poseen características especializadas, como la unidad de multiplicación de matrices (MXU) y una topología de interconexión patentada, que las hacen ideales para acelerar el entrenamiento y la inferencia de la IA.

Las TPU impulsan Gemini y todas las aplicaciones de Google impulsadas por IA, como Búsqueda, Fotos y Mapas, que atienden a más de mil millones de usuarios.

Este tipo de hardware puede acelerar significativamente el desarrollo y el funcionamiento de las redes neuronales, donde el error ocasional es menos significativo, ya que estos modelos dependen en gran medida de las estadísticas y de una gran cantidad de cálculos para empezar.

Entre las tareas del usuario final más adecuadas para las TPU se encuentran el aprendizaje profundo, el reconocimiento de voz y la clasificación de imágenes.

Procesadores de redes neuronales (NNP):

También vinculadas a las Unidades de Procesamiento Neural (NPU) y llamadas chips neuromórficos, las NPP se especializan en la computación de redes neuronales y están diseñadas para imitar las conexiones neuronales del cerebro humano. A veces también se les denomina aceleradores de IA, aunque este término no está tan bien definido.

Una NPU también integrará almacenamiento y computación mediante pesos sinápticos. De esta manera, podrá ajustarse o "aprender" con el tiempo, lo que se traduce en una mayor eficiencia operativa.

Una NPU incluye módulos específicos para multiplicación y suma, funciones de activación, operaciones de datos 2D y descompresión.

El módulo especializado de multiplicación y suma se utiliza para realizar operaciones relevantes para el procesamiento de aplicaciones de redes neuronales, como el cálculo de multiplicación y suma de matrices, convolución, producto escalar y otras funciones.

La especialización puede ayudar a una NPU a completar una operación con un solo cálculo, en lugar de varios miles con un hardware generalista. Por ejemplo, IBM afirma que la NPU puede mejorar radicalmente la eficiencia del cálculo de IA en comparación con las GPU.

“Las pruebas han demostrado que el rendimiento de algunas NPU es más de 100 veces mejor que el de una GPU comparable, con el mismo consumo de energía”.

Debido a esta eficiencia energética, los fabricantes suelen instalar NPU en dispositivos de usuario, donde pueden ayudar a realizar tareas locales para aplicaciones de IA generativa, un ejemplo de “computación de borde” (consulte a continuación para obtener más información sobre ese tema).

Actualmente se están explorando muchos métodos para crear chips neuromórficos:

- Aprovechar la ferroelectricidad incipiente, un fenómeno aún poco comprendido.

- Sustrato activo que utiliza vanadio o titanio.

- Uso de memristores, un nuevo tipo de componente electrónico, que puede realizar tareas de IA a 1/800thdel consumo normal de energía.

Auxiliar Prodeo Unoche (XPU)

XPU fusiona CPU (procesador), GPU (tarjeta gráfica/procesadores paralelos) y memoria en el mismo dispositivo electrónico.

Fuente: Broadcom

XPU es un término amplio que abarca muchas variaciones de este concepto de reunir todo el hardware en unidades autónomas, incluidas Unidades de procesamiento de datos (DPU), Unidades de procesamiento de infraestructura (IPU)y Tarjetas aceleradoras de funciones (FAC).

Se considera que las XPU solucionan un problema creciente de los centros de datos de IA, que es la creciente necesidad de conectividad entre las subunidades, hasta el punto en que el retraso de los datos se convierte en un factor importante en la ralentización de la computación, más que la potencia de computación disponible.

Básicamente, los chips (GPU, TPU, NPP, etc.) esperan los datos mientras realmente trabajan.

Un líder de esta tecnología es Broadcom (AVGO -0.19%), el cual Lo discutimos en detalle en un informe de inversión dedicado.

Matrices de puertas programables en campo (FPGA):

Los FPGA son procesadores programables, lo que los hace significativamente más flexibles y reconfigurables que los ASIC, más rígidos. Los FPGA se pueden personalizar para algoritmos de IA específicos, lo que potencialmente ofrece mayor rendimiento y eficiencia energética.

La flexibilidad tiene un precio, ya que los FPGA suelen ser más complejos, caros y consumen más electricidad. Sin embargo, pueden ser más eficientes que el hardware generalista.

Esto los convierte en un producto de nicho, donde su flexibilidad compensa las desventajas. Por ejemplo, el aprendizaje automático, la visión artificial y el procesamiento del lenguaje natural pueden beneficiarse de la versatilidad de los FPGA.

Memoria de alto ancho de banda (HBM):

Los avances más importantes en hardware personalizado centrado en IA se han producido en el campo de la potencia informática, durante mucho tiempo el punto de estrangulamiento en la creación de más capacidad informática para entrenar nuevas IA.

Aun así, estos sistemas también requieren sistemas de soporte de alta eficiencia, entre los cuales la memoria es un componente importante. HBM proporciona, como su nombre indica, un mayor ancho de banda que la DRAM tradicional.

Se logra apilando verticalmente múltiples matrices DRAM y conectándolas mediante vías a través del silicio (TSV). La primera generación de HBM se desarrolló en 2013.

El apilamiento vertical ahorra espacio y reduce la distancia física que deben recorrer los datos, lo que acelera la transferencia de datos, algo imprescindible en la informática de IA.

Los HBM son más complejos de fabricar y más costosos que la DRAM, pero los beneficios en rendimiento y eficiencia energética a menudo justifican el mayor costo para las aplicaciones de IA.

Infraestructura del centro de datos de IA: energía, refrigeración y conectividad

Además de la memoria y la potencia de cálculo, los sistemas auxiliares de los centros de datos de IA también son importantes. Sin ellos, los datos no pueden circular con la suficiente rapidez, los chips se sobrecalentarían o la energía disponible sería insuficiente.

Esto significa que, por ejemplo, el hardware de conectividad de Broadcom también se beneficia enormemente de la expansión del centro de datos con IA, al igual que las soluciones especializadas como las de los proveedores de equipos de refrigeración, por ejemplo, Vertiv. (VRT + 1.55%) o Schneider Electric (SU.PA).

El suministro de energía también podría convertirse en un problema, y varios gigantes tecnológicos están tratando de abordar el asunto apostando por la energía nuclear. con el primer movimiento de Microsoft en 2024, seguido por muchos otros desde entonces.

Combinado con un compromiso de reducir la huella de carbono de la IA por parte de las empresas tecnológicas, esto debería beneficiar en gran medida a las empresas del sector de la energía nuclear o renovable, como Cameco (CCJ + 0.24%), Vernova (GEV -0.05%), First Solar (FSLR -1.24%), SiguienteEra o Socios energéticos de Brookfield (BEP + 1.84%) (siga los enlaces para obtener un informe sobre cada empresa).

Tecnologías informáticas de IA emergentes

Computación cuántica

Debido a que la IA tiene tanta hambre de poder computacional, es posible que el futuro del hardware de este campo ni siquiera esté al nivel de las soluciones de silicio actualmente disponibles.

Una posibilidad es que la computación cuántica pueda utilizarse para detectar patrones de manera mucho más eficiente que la computación clásica. algo ya explorado por los investigadores.

La computación cuántica en su conjunto podría utilizarse para resolver algunos cálculos específicos que son prácticamente imposibles con la computación binaria. Es probable que esto se aplique finalmente a la IA, pero las primeras computadoras cuánticas comerciales aún están a años de distancia, y una gran red cuántica aún más lejos.

Fotónica

Al utilizar luz en lugar de electrones para transportar datos, la fotónica podría ser mucho más rápida que los dispositivos electrónicos.

Debido a que las computadoras cuánticas generalmente transportan datos cuánticos con fotones entrelazados, también existe una gran superposición entre la computación cuántica y la fotónica, y Ya se ha anunciado el primer chip cuántico-fotónico dual.

Organoides

Como la mayoría de la IA replica en las computadoras el funcionamiento de las redes neuronales del cerebro, algunos investigadores se preguntan si no podríamos utilizar en su lugar… células cerebrales reales.

Esta es una idea intrigante, especialmente porque Algunas investigaciones podrían indicar que el cerebro es en realidad una computadora cuántica orgánica.

Este tipo de "computadora" se denomina organoides y consiste esencialmente en neuronas cultivadas en un laboratorio en un chip. Las neuronas autoorganizan sus dendritas y conexiones en respuesta al estímulo del chip.

Esta tecnología todavía es nueva y se basa en impresión bio-3D.

Otros

Exploramos otras alternativas a la computación de silicio en “Las 10 principales empresas de informática sin silicio”, como el dióxido de vanadio, el grafeno, la activación redox o los materiales orgánicos.

Cada una promete ser mucho más rápida o consumir menos energía que la computación clásica basada en silicio. Sin embargo, aún son relativamente nuevas y es improbable que revolucionen el campo de la IA a escala comercial, al menos durante los próximos 5 a 10 años.

IA en la nube e IA de borde: tendencias de accesibilidad

IA en la nube

Dado que los sistemas de IA más potentes son desarrollados por grandes empresas tecnológicas, su acceso se realiza principalmente a través de la nube. Lo mismo ocurre con el acceso al propio hardware especializado en IA.

El líder de esta tendencia es tejido de núcleo (CRCW + 8.33%), una empresa que pasó de ser un proveedor de nube a una empresa de minería de criptomonedas mediante GPU, a ofrecer hoy computación con inteligencia artificial a pedido.

Esto convirtió a CoreWeave en un socio clave para las nuevas empresas de inteligencia artificial que intentan competir con los gigantes tecnológicos, como IA de inflexión Clúster de GPU de 1.3 millones de dólares, financiado mediante una nueva ronda de financiación.

“Hace dos meses, una empresa quizá no existiera y ahora puede tener 500 millones de dólares de financiación de capital de riesgo.

Y lo más importante para ellos es asegurar el acceso a la informática; no pueden lanzar su producto ni su negocio hasta que lo tengan”.

A medida que los actores puros en hardware de IA se vuelven cautelosos ante las grandes tecnologías que producen sus propias GPU, TPU, XPU, etc. y evolucionan desde clientes a competidores, es probable que empresas como CoreWeave obtengan acceso prioritario al último lanzamiento de hardware de Nvidia y otros.

Este modelo de negocio probablemente será especialmente importante para el entrenamiento de IA, que es mucho más exigente en capacidad computacional que simplemente utilizar las IA ya entrenadas.

Computación perimetral y PC con IA

Otro caso de computación de IA que está evolucionando rápidamente es la necesidad de que la computación de los sistemas de IA se realice en el sitio, lo más cerca posible de las situaciones de la vida real.

Esto es imprescindible para los sistemas que podrían no tolerar ser desconectados de la IA si la conexión falla, o cuando la latencia de ida y vuelta con la nube es demasiado lenta.

Un buen ejemplo son los coches autónomos, que se espera que comprendan su entorno sin conexión.

Este tipo de cálculo se denomina computación de borde y se beneficia enormemente de un hardware más eficiente y que consume menos energía.

Puede aumentar la confiabilidad de la IA y, a medida que los modelos se vuelven más eficientes, como lo ilustra el avance de DeepSeek, podría convertirse en un modelo más frecuente de implementación de IA en el futuro.

Por la misma razón, las PC con IA Como el que lanzó recientemente Nvidia, a largo plazo podría ser suficiente para ejecutar muchas aplicaciones de IA localmente, lo que aumenta la privacidad y la seguridad en comparación con las IA siempre conectadas a la nube.

Conclusión

Durante un tiempo, el hardware de IA ha estado estrechamente vinculado a las GPU, ya que las tarjetas gráficas eran mucho más eficientes en el entrenamiento de IA que otros tipos de hardware, como las CPU. Esto aportó la fortuna de Nvidia y de muchos de sus primeros accionistas.

Es probable que las GPU, especialmente las "superGPU" centradas en la IA, sigan siendo importantes en la construcción de centros de datos de IA. Sin embargo, se convertirán en uno de los componentes de sistemas cada vez más complejos y especializados.

Las operaciones del transformador se enviarán a TPU, las redes neuronales se asignarán a NPP y las tareas repetitivas a ASIC dedicados o FPGA reconfigurados.

Mientras tanto, la memoria de gran ancho de banda, los conectores de telecomunicaciones avanzados y el enfriamiento ultraeficiente mantendrán todas las funciones auxiliares alrededor del núcleo informático en funcionamiento.

Para la computación de borde y las IA más pequeñas que las masivas LLM, la computación local, tal vez impulsada por XPU todo en uno, probablemente será utilizada por científicos, autos autónomos y usuarios preocupados por la privacidad o la censura, potencialmente con modelos de IA de código abierto.

Lo que es seguro es que las ganancias provenientes de la venta de “picos y palas” de hardware de IA en la fiebre del oro de la IA están lejos de terminar.

Después de un período de dominio de Nvidia, los inversores podrían querer diversificar los riesgos extendiendo su cartera de hardware de IA a otros diseños, y tal vez incluso a las compañías eléctricas que proporcionarán los preciosos gigavatios para operar los centros de datos de IA cada vez más grandes y numerosos del mundo.