Inteligência artificial

Investindo em Hardware de IA: De CPUs para XPUs

Investindo em Hardware de IA: Abordagem de Picaretas e Pás

A IA promete ser a mudança mais importante em nossa economia, sistemas produtivos e sociedade nas últimas décadas, potencialmente tornando até mesmo as mudanças radicais trazidas pela Internet triviais em comparação.

Elle pode fazer com que uma categoria inteira de empregos desapareça, incluindo motoristas, tradutores, suporte ao cliente, designers de web, etc. Outros empregos podem ver uma redução radical na demanda, como programadores, advogados de nível de entrada, diagnosticianos, etc.

Também deve criar muito valor e produtividade adicionais para muitas outras tarefas, com as principais empresas de software de IA provavelmente sendo as primeiras a atingir capitalizações de mercado anteriormente inimagináveis.

Por todas essas razões, os mercados de capital e os investidores têm sido fascinados pela IA e dão muita atenção ao progresso dos muitos gigantes da tecnologia na IA, bem como à forte concorrência que emerge de gigantes da tecnologia chineses, como Alibaba e startups como DeepSeek.

Outra forma de aproveitar o boom da IA é seguir a estratégia conhecida por funcionar em todas as corridas do ouro: não procure ouro, mas venda picaretas e pás. Isso certamente funcionou para as empresas que aconteceram de estar no melhor lugar para vender hardware otimizado para IA, com Nvidia (NVDA ) tendo transformado seus cartões gráficos de jogos em chips de treinamento de IA, tornando-a a empresa mais valiosa do mundo, tendo ultrapassado a incrível capitalização de mercado de $4T (siga o link para um relatório completo sobre a Nvidia).

Porque a IA exige hardware muito específico, principalmente diferente de outras formas anteriores de tarefas de computação, e é uma oportunidade de negócios tão massiva, a indústria de semicondutores agora está em uma corrida para desenvolver novas formas de hardware projetadas especificamente para treinar e executar programas de IA.

Enquanto a Nvidia provavelmente permanecerá uma das principais empresas do setor, alternativas agora estão surgindo e podem fornecer oportunidades interessantes para investidores que prestam atenção cedo.

Por que a IA precisa de hardware especializado

Muitos cálculos pequenos

Os esforços iniciais na IA usaram a mesma capacidade de computação que outros programas, focando principalmente em processadores (Unidade Central de Processamento – CPUs). As CPUs ainda são importantes, mas logo ficou claro que elas não são ótimas para a maioria dos métodos usados atualmente para desenvolver IAs.

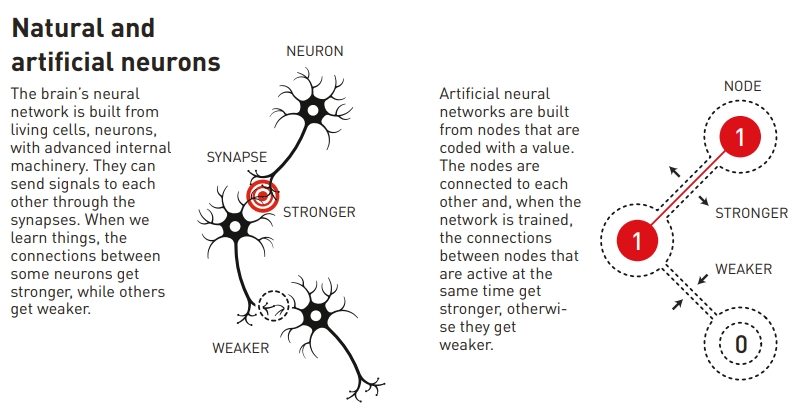

Redes neurais e outros métodos semelhantes exigem muitos cálculos relativamente simples, em vez de um cálculo muito complexo. Portanto, muitos chips menores trabalhando em paralelo são geralmente melhores do que CPUs massivas e poderosas.

Isso é em grande parte por que as GPUs rapidamente se tornaram mais populares, pois os cartões gráficos são intrinsicamente projetados para realizar milhares de cálculos menores em paralelo.

O treinamento de IA de hoje é amplamente baseado em redes neurais, um conceito que ganhou o Prêmio Nobel de Física em 2024, um prêmio que cobrimos em detalhe em um artigo dedicado na época.

Fonte: Prêmio Nobel

Uma segunda revolução na tecnologia de IA veio com “transformadores”. Eles resolvem a incapacidade das redes neurais tradicionais processar eficientemente sequências longas de dados, uma característica comum de qualquer linguagem natural.

Introduzidos pela primeira vez em 2017 por pesquisadores do Google, é a causa raiz da atual explosão na capacidade de IA. Os transformadores estão no núcleo de produtos de IA como LLMs (Modelos de Linguagem Grande), incluindo ChatGPT.

Requisitos diferentes

Uma distinção importante nos fluxos de trabalho de IA é a diferença entre ajuste fino e inferência, ambos com requisitos de hardware distintos.

- Ajuste fino envolve treinar um modelo em dados específicos de domínio, exigindo significativo poder de computação e memória. É uma tarefa muito técnica, frequentemente na fronteira da ciência da IA.

- Inferência se concentra em usar um modelo já treinado para gerar saídas, exigindo menos poder de computação, mas maior foco em baixa latência e eficiência de custo.

Portanto, enquanto os custos são obviamente uma preocupação tanto para o ajuste fino/treinamento quanto para a inferência/usabilidade da IA, o treinamento geralmente exigirá o melhor hardware possível, enquanto as tarefas de usabilidade se concentrarão mais no custo do hardware e no consumo de energia ao escolher a melhor opção de hardware.

CPUs x GPUs

Unidades Centrais de Processamento (CPUs):

As CPUs são de propósito geral e não são especificamente hardware de IA. Elas são, no entanto, ainda essenciais para executar instruções e realizar cálculos básicos em sistemas de IA.

A maioria do software que lida com a interface com os usuários finais de um sistema de IA também será centrado em CPU, seja em computadores individuais ou em software baseado em nuvem.

Fonte: AnandTech

As CPUs também podem ser usadas para IAs muito simples, onde hardware dedicado não é realmente necessário. Isso é especialmente verdadeiro quando a saída não é especialmente urgente e o processamento de IA relativamente lento das CPUs não é um problema.

Portanto, modelos pequenos com pequenos conjuntos de dados e cálculos podem se sair bem em CPUs. A onipresença de CPUs em computadores regulares também as torna uma boa opção para um usuário médio que não deseja investir em hardware de IA específico.

As CPUs também são muito confiáveis e estáveis, tornando-as uma boa escolha para tarefas críticas onde nenhum erro é um critério importante.

Por fim, as CPUs são úteis para algumas das tarefas no treinamento de IA, geralmente em colaboração com outros tipos de hardware, como carregamento de dados, formatação, filtragem e visualização.

Unidades de Processamento Gráfico (GPUs):

Originalmente projetadas para renderização gráfica, as GPUs são projetadas para processamento paralelo, tornando-as ideais para treinar modelos de IA que exigem lidar com grandes conjuntos de dados. A mudança de CPUs para GPUs reduziu os tempos de treinamento de semanas para horas.

Devido à sua ampla disponibilidade e à experiência de especialistas em TI para trabalhar com elas, as GPUs foram o primeiro tipo de hardware de computação a ser instalado em série para aumentar a pesquisa de IA.

Fonte: Aorus

Também foi instrumental no sucesso das GPUs o desenvolvimento do CUDA pela Nvidia, uma interface de programação de propósito geral para as GPUs da Nvidia, abrindo a porta para outros usos além de jogos. Isso foi feito porque alguns pesquisadores já estavam usando GPUs para realizar cálculos em vez de supercomputadores.

“Os pesquisadores perceberam que, comprando esse cartão de jogos chamado GeForce, você o adiciona ao seu computador, você basicamente tem um supercomputador pessoal.

Dinâmica molecular, processamento sísmico, reconstrução de TC, processamento de imagens — um monte de coisas diferentes.”

Hoje, as GPUs ainda estão entre os tipos mais procurados de hardware de IA, com a Nvidia mal conseguindo produzir o suficiente para atender à demanda dos gigantes da tecnologia que constroem centros de dados de IA em escala de gigawatt.

É também o início da “era do super GPU”, com o lançamento recente pela Nvidia do GB200 NVL72.

Esse hardware é projetado para atuar como uma GPU massiva única diretamente da fábrica, em vez de ter que conectar muitas pequenas. Isso o torna muito mais poderoso do que mesmo o modelo H100 de quebra de recordes anterior.

Fonte: Nvidia

Isso também deve ser muito mais eficiente em termos de energia, um ponto crucial, pois a indústria de IA pode ficar aquém em energia antes de ficar aquém de chips na velocidade com que os centros de dados de IA estão sendo construídos. E mais eficiência de computação e energia significam menos calor residual, o que resolve temporariamente o problema de superaquecimento também.

| Tipo de Hardware | Melhor Caso de Uso | Velocidade | Eficiência de Energia | Flexibilidade |

|---|---|---|---|---|

| CPU | Tarefas de propósito geral | Baixa | Alta | Muito Alta |

| GPU | Treinamento de IA e tarefas paralelas | Alta | Média | Média |

| TPU | Operações de tensor e transformadores | Muito Alta | Alta | Baixa |

| ASIC | Aceleração de tarefa única | Muito Alta | Muito Alta | Muito Baixa |

| FPGA | Cargas de trabalho de IA reconfiguráveis | Média | Média | Alta |

A Ascensão dos ASICs e do Hardware de IA

Circuitos Integrados de Aplicação Específica (ASICs) são hardware de computação projetados especificamente para uma tarefa de computação dada, tornando-os ainda mais especializados do que as GPUs relativamente generalistas.

Portanto, eles são menos flexíveis e programáveis do que o hardware de propósito geral.

Como regra, eles tendem a ser mais complexos. Eles também são geralmente mais caros, tanto devido à falta de economias de escala para sua produção quanto ao custo de designs personalizados.

Eles são, no entanto, muito mais eficientes em sua tarefa dada, normalmente produzindo uma saída mais rápida com muito menos poder de computação e energia desperdiçados.

Os ASICs e outros hardwares de IA específicos estão aumentando em utilização, à medida que o campo está progressivamente notando que alguns cálculos não são ideais para GPUs, mas exigem equipamento mais especializado.

Unidades de Processamento de Tensor (TPUs)

As TPUs foram desenvolvidas pelo Google (GOOGL ) especificamente para realizar cálculos de tensor (ligados ao cálculo baseado em transformadores). Elas são otimizadas para aritmética de alta taxa e baixa precisão.

Fonte: C#Corner

Isso fornece às TPUs alto desempenho, eficiência e escalabilidade para o treinamento de grandes redes neurais.

As TPUs possuem recursos especializados, como a unidade de multiplicação de matrizes (MXU) e topologia de interconexão proprietária, que as tornam ideais para acelerar o treinamento e a inferência de IA.

As TPUs alimentam o Gemini e todas as aplicações de IA do Google, como Pesquisa, Fotos e Mapas, atendendo a mais de 1 bilhão de usuários.

Esse tipo de hardware pode acelerar significativamente o desenvolvimento e o funcionamento de redes neurais, onde o erro ocasional é menos significativo, pois esses modelos são altamente dependentes de estatísticas e de um grande número de cálculos para começar.

Entre as tarefas de usuário mais adequadas para as TPUs estão aprendizado profundo, reconhecimento de fala e classificação de imagens.

Processadores de Rede Neural (NNPs):

Também ligados a Unidades de Processamento Neural (NPUs) e chamados de chips neuromórficos, os NPPs são especializados em computação de rede neural, projetados para imitar as conexões neurais no cérebro humano. Eles também são às vezes chamados de aceleradores de IA, embora esse termo seja menos bem definido.

Um NPU também integrará armazenamento e computação por meio de pesos sinápticos. Portanto, pode ajustar ou “aprender” com o tempo, levando a uma eficiência operacional melhorada.

Um NPU inclui módulos específicos para multiplicação e adição, funções de ativação, operações de dados 2D e descompressão.

O módulo de multiplicação e adição especializado é usado para realizar operações relevantes para o processamento de aplicações de rede neural, como calcular a multiplicação de matrizes e adição, convolução, produto escalar e outras funções.

A especialização pode ajudar um NPU a concluir uma operação com apenas um cálculo em vez de vários milhares com hardware generalista.

Por exemplo, a IBM afirma que o NPU pode melhorar radicalmente a eficiência do cálculo de IA em comparação com as GPUs.

“Os testes mostraram que o desempenho de alguns NPU é mais de 100 vezes melhor do que uma GPU comparável, com o mesmo consumo de energia.”

Devido a essa eficiência de energia, os NPUs são populares entre os fabricantes para instalar em dispositivos de usuário, onde podem ajudar a realizar tarefas locais para aplicativos de IA gerativos, um exemplo de “computação de borda”. (veja abaixo para mais sobre esse tópico).

Muitos métodos estão sendo explorados para criar chips neuromórficos:

- Aproveitar a ferroeletricidade incipiente, um fenômeno ainda mal compreendido.

- Substrato ativo usando vanádio ou titânio.

- Usar memristores, um novo tipo de componente eletrônico, que pode realizar tarefas de IA com 1/800ºdo consumo de energia normal.

Unidade de Processamento Auxiliar (XPU)

A XPU combina CPU (processador), GPU (placa gráfica / processadores paralelos) e memória no mesmo dispositivo eletrônico.

Fonte: Broadcom

A XPU é um termo amplo, abrangendo muitas variações desse conceito de trazer todo o hardware para unidades autônomas, incluindo Unidades de Processamento de Dados (DPUs), Unidades de Processamento de Infraestrutura (IPUs) e Cartões de Aceleração de Função (FACs).

As XPUs são vistas como solução para um problema crescente nos centros de dados de IA, que é a necessidade crescente de conectividade entre as subunidades, a ponto de o atraso de dados se tornar um fator importante no retardamento do cálculo, mais do que o poder de computação disponível.

Basicamente, os chips (GPUs, TPUs, NPPs, etc.) estão esperando os dados tanto quanto estão realmente trabalhando.

Um líder dessa tecnologia é a Broadcom (AVGO ), que discutimos em detalhe em um relatório de investimento dedicado.

Matrizes Programáveis em Campo (FPGAs):

As FPGAs são processadores programáveis, tornando-as significativamente mais flexíveis e reconfiguráveis do que os ASICs mais rígidos. As FPGAs podem ser personalizadas para algoritmos de IA específicos, potencialmente oferecendo maior desempenho e eficiência de energia.

Fonte: Microcontrollers Labs

A flexibilidade vem com um custo, pois as FPGAs são geralmente mais complexas, caras e consomem mais eletricidade. No entanto, elas ainda podem ser mais eficientes do que o hardware generalista.

Isso as torna um produto de nicho, onde sua flexibilidade compensa as desvantagens. Por exemplo, aprendizado de máquina, visão computacional e processamento de linguagem natural podem se beneficiar da versatilidade das FPGAs.

Memória de Alta Bandwidth (HBM):

Os principais desenvolvimentos em hardware de IA personalizado foram no campo do poder de computação, por um longo tempo o gargalo na construção de mais capacidade de computação para treinar novas IAs.

No entanto, esses sistemas também precisam de sistemas de suporte de alta eficiência, dos quais a memória é um importante. A HBM fornece, como seu nome indica, maior largura de banda do que a DRAM tradicional.

Isso é alcançado empilhando vários dies de DRAM verticalmente e conectando-os com vias de silício (TSVs). A primeira geração de HBM foi desenvolvida em 2013.

A empilhamento vertical economiza espaço e reduz a distância física que os dados precisam percorrer, acelerando a transferência de dados, uma necessidade na computação de IA.

As HBMs são mais complexas de fabricar e caras do que a DRAM, mas os benefícios de desempenho e eficiência de energia geralmente justificam o custo mais alto para aplicações de IA.

Infraestrutura de Centros de Dados de IA: Energia, Resfriamento e Conectividade

Além da memória e do poder de computação, os sistemas auxiliares dos centros de dados de IA também são importantes. Sem eles, os dados não podem circular rápido o suficiente, os chips superaqueceriam ou a energia disponível seria insuficiente.

Isso significa que, por exemplo, o hardware de conectividade da Broadcom também se beneficia muito da construção de centros de dados de IA, assim como soluções especializadas, como fornecedores de equipamentos de resfriamento, por exemplo, Vertiv (VRT ) ou Schneider Electric (SU.PA).

A alimentação de energia também pode se tornar um problema, e vários gigantes da tecnologia estão tentando resolver o problema apostando em energia nuclear, com a primeira movimentação da Microsoft em 2024, seguida por muitos outros desde então.

Combinado com um compromisso de reduzir a pegada de carbono da IA pelas empresas de tecnologia, isso deve beneficiar grandemente as empresas do setor nuclear ou de energia renovável, como Cameco (CCJ ), GE Vernova (GEV ), First Solar (FSLR ), NextEra (NEE ), ou Brookfield Energy Partners (BEP ) (siga os links para um relatório sobre cada empresa).

Tecnologias de Computação de IA Emergentes

Computação Quântica

Porque a IA é tão voraz em poder de computação, é possível que o futuro do campo do hardware não esteja mesmo com as soluções de silício atualmente disponíveis.

Uma possibilidade é que a computação quântica possa ser usada para detectar padrões muito mais eficientemente do que a computação clássica poderia, algo já explorado por pesquisadores.

A computação quântica como um todo pode ser usada para resolver alguns cálculos específicos que são quase impossíveis com a computação binária. Isso provavelmente será aplicado à IA, mas os primeiros computadores quânticos comerciais ainda estão alguns anos à frente, e uma rede quântica grande ainda mais à frente.

Fotônica

Usando luz em vez de elétrons para transportar dados, a fotônica pode ser muito mais rápida do que os dispositivos eletrônicos.

Porque os computadores quânticos geralmente transportam dados quânticos com fótons entrelaçados, há muito sobreposição entre a computação quântica e a fotônica, e o primeiro chip quântico-fotônico híbrido já foi anunciado.

Organoides

Como a maioria da IA replica em computadores o funcionamento das redes neurais do cérebro, alguns pesquisadores se perguntam se não poderíamos usar … células cerebrais reais.

Essa é uma ideia intrigante, especialmente porque algumas pesquisas podem indicar que o cérebro é na verdade um computador quântico orgânico.

Esse tipo de “computador” é chamado de organoides, e basicamente consiste em neurônios cultivados em laboratório em um chip de computador. Os neurônios então se autoorganizam seus dendritos e conexões em resposta ao estímulo do chip.

Essa tecnologia é nova e depende da impressão 3D de bioimpressão.

Outros

Exploramos outras alternativas à computação de silício em “Top 10 Empresas de Computação não de Silício“, como dióxido de vanádio, grafeno, portão de óxido redox ou materiais orgânicos.

Cada um promete ser muito mais rápido ou muito menos intensivo em energia do que a computação clássica de silício. No entanto, eles ainda são relativamente novos e improváveis de revolucionar o campo da IA em escala comercial, pelo menos nos próximos 5-10 anos.

IA em Nuvem e IA de Borda: Tendências de Acessibilidade

IA em Nuvem

Como os sistemas de IA mais poderosos são feitos por grandes empresas de tecnologia, eles são principalmente acessíveis por meio da nuvem. O mesmo está se tornando verdadeiro para o acesso ao próprio hardware de IA especializado.

O líder dessa tendência é Coreweave (CRCW ), uma empresa que mudou de provedor de nuvem para mineração de criptomoedas usando GPUs para, hoje, fornecer computação de IA sob demanda.

Isso tornou a CoreWeave um parceiro-chave de startups de IA emergentes que tentam competir com os gigantes da tecnologia, como Inflection AI e seu cluster de GPU de $1,3 bilhão, financiado por uma rodada de financiamento fresca.

“Dois meses atrás, uma empresa pode não ter existido, e agora pode ter $500 milhões de financiamento de venture capital.

E a coisa mais importante para eles fazer é garantir acesso a computação; eles não podem lançar seu produto ou lançar seu negócio até que tenham isso,”

À medida que os jogadores puros de hardware de IA ficam cautelosos com os grandes players de tecnologia produzindo seus próprios GPUs, TPUs, XPUs, etc. e evoluindo de clientes para concorrentes, é provável que empresas como a CoreWeave obtenham acesso prioritário às últimas versões de hardware pela Nvidia e outros.

Esse modelo de negócios provavelmente será especialmente importante para o treinamento de IA, que é muito mais exigente em capacidade de computação do que apenas usar as IAs já treinadas.

Computação de Borda e PCs de IA

Outro caso de computação de IA que está evoluindo rapidamente é a necessidade de ter o cálculo dos sistemas de IA feito localmente, o mais próximo possível de situações da vida real.

Isso é uma necessidade para sistemas que podem não tolerar ser desconectados da IA se a conexão falhar, ou quando a latência de ida e volta com a nuvem é muito lenta.

Um bom exemplo é carros autônomos, que são esperados para entender seu ambiente offline.

Esse tipo de cálculo é chamado de computação de borda, e se beneficia muito de hardware mais eficiente e menos consumidor de energia.

Isso pode aumentar a confiabilidade da IA e, à medida que os modelos se tornam mais eficientes, ilustrado pelo salto à frente do DeepSeek, pode se tornar um modelo de implantação de IA mais prevalente no futuro.

Por essa mesma razão, PCs de IA como o recentemente lançado pela Nvidia podem, a longo prazo, ser suficientes para executar muitas aplicações de IA localmente, aumentando a privacidade e a segurança em comparação com as IAs sempre conectadas à nuvem.

Conclusão

O hardware de IA tem, por um tempo, sido sinônimo de GPUs, pois as placas gráficas eram muito mais eficientes no treinamento de IA do que outros tipos de hardware, como CPUs. Isso fez a fortuna da Nvidia e de muitos de seus acionistas iniciais.

As GPUs, especialmente as “super GPUs” de IA, provavelmente continuarão importantes na construção de centros de dados de IA. Mas elas estão prestes a evoluir para apenas um dos componentes de sistemas cada vez mais complexos e especializados.

As operações de transformadores serão enviadas para TPUs, redes neurais encarregadas a NPPs, tarefas repetitivas a ASICs dedicados ou FPGAs reconfigurados.

Enquanto isso, memória de alta largura de banda, conectores de telecomunicação avançados e resfriamento ultraeficiente manterão todos os sistemas auxiliares em torno do núcleo de computação funcionando.

Para a computação de borda e IAs menores do que as LLMs maciças, a computação local, possivelmente alimentada por XPUs autônomas, provavelmente será usada por cientistas, carros autônomos e usuários preocupados com a privacidade ou censura, potencialmente com modelos de IA de código aberto.

O que é certo é que os lucros com a venda das “picaretas e pás” do hardware de IA na corrida do ouro da IA estão longe de terminar.

Após um período de domínio da Nvidia, os investidores podem querer diversificar os riscos espalhando sua carteira de hardware de IA para outros designs, e talvez até mesmo as empresas de utilidades de energia que fornecerão os preciosos gigawatts para executar os cada vez mais grandes e numerosos centros de dados de IA no mundo.