Kunstig intelligens

Investering i AI-maskinvare: Fra CPUer til XPUer

Securities.io har strenge redaksjonelle standarder og kan motta kompensasjon fra gjennomgåtte lenker. Vi er ikke en registrert investeringsrådgiver, og dette er ikke investeringsrådgivning. Vennligst se vår tilknytning.

Investering i AI-maskinvare: En enkel tilnærming

AI lover å bli den viktigste endringen i økonomien vår, produktive systemer og samfunnet vårt de siste tiårene, og potensielt gjøre selv de radikale endringene som internett har medført trivielle i sammenligning.

Det kan føre til at en hel kategori med jobber forsvinner, inkludert sjåfører, oversettere, kundesupport, webdesignere osv. Andre jobber kan oppleve en radikal reduksjon i etterspørsel, som programmerere, advokater på inngangsnivå, diagnostikere osv.

Det bør også skape mye merverdi og produktivitet for mange andre oppgaver, med de dominerende AI-programvareselskapene som sannsynligvis er de første som når markedsverdier som tidligere var utenkelige.

Av alle disse grunnene har kapitalmarkeder og investorer blitt fascinert av AI og vier stor oppmerksomhet til fremgangen til de mange teknologigigantene innen AI, samt den sterke konkurransen som dukker opp fra kinesiske teknologigiganter som Alibaba og startups som DeepSeek.

En annen måte å spille på AI-boomen er å følge strategien som er kjent for å fungere i ethvert gullrush: ikke let etter gull, men selg hakker og spader. Dette har absolutt fungert for selskapene som tilfeldigvis var i den beste posisjonen til å selge AI-optimalisert maskinvare, med Nvidia (NVDA ) etter å ha gjort spillgrafikkortene sine om til AI-treningsbrikker, noe som gjør dem til verdens mest verdifulle selskap, og etter å ha passert den forbløffende markedsverdien på 4 billioner dollar (Følg lenken for en fullstendig rapport om Nvidia).

Fordi AI krever svært spesifikk maskinvare, stort sett forskjellig fra andre tidligere former for databehandlingsoppgaver, og er en så enorm forretningsmulighet, er halvlederindustrien nå i et kappløp om å utvikle nye former for maskinvare som er spesielt utviklet for opplæring og kjøring av AI-programmer.

Selv om Nvidia sannsynligvis vil forbli et av de ledende selskapene i sektoren, dukker det nå opp alternativer som kan gi interessante muligheter for investorer som følger med tidlig.

Hvorfor AI trenger spesialisert maskinvare

Mange små beregninger

De første forsøkene innen kunstig intelligens brukte samme datakapasitet som andre programmer, med hovedsakelig fokus på prosessorer (CPU-er). CPU-er er fortsatt viktige, men det viste seg raskt at de ikke er optimale for de fleste metodene som brukes i dag for å utvikle kunstig intelligens.

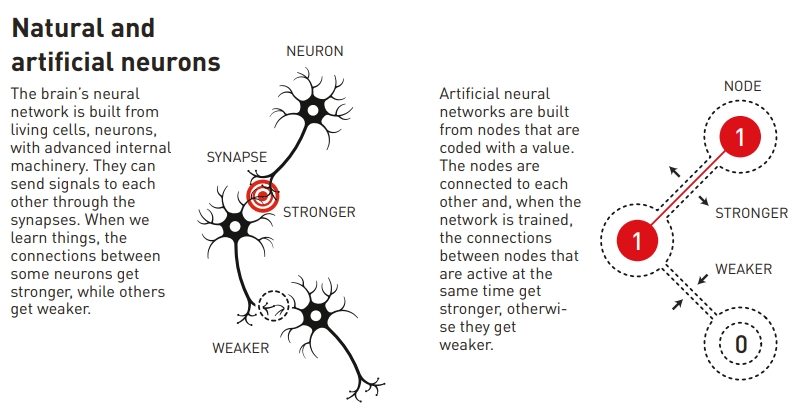

Nevrale nettverk og andre lignende metoder krever mange relativt enkle beregninger, i stedet for én veldig kompleks beregning. Så mange mindre brikker som jobber parallelt er generelt bedre enn på massive og kraftige CPU-er.

Dette er i stor grad grunnen til at GPU-er raskt ble mer populære, ettersom grafikkort iboende er designet for å utføre tusenvis av mindre beregninger parallelt.

Dagens AI-trening er i stor grad basert på nevrale nettverk, et konsept som vant Nobelprisen i fysikk i 2024, en belønning vi dekket i detalj i en egen artikkel den gangen..

kilde: Nobelprisen

En annen revolusjon innen AI-teknologi kom med «transformatorer». De løser tradisjonelle nevrale nettverksproblemer. manglende evne til å effektivt behandle lange datasekvenser, et vanlig kjennetegn ved ethvert naturlig språk.

Den ble først introdusert i 2017 av Google-forskere, og er roten til den nåværende eksplosjonen i AI-kapasitet. Transformere er kjernen i AI-produkter som LLM-er (store språkmodeller), inkludert ChatGPT.

Ulike krav

Et viktig skille i AI-arbeidsflyter er forskjellen mellom finjustering og inferens, som begge har forskjellige maskinvarekrav.

- Finjustering innebærer å trene en modell på domenespesifikke data, noe som krever betydelig datakraft og minne. Det er en svært teknisk oppgave, ofte helt i grenselandet innen kunstig intelligens-vitenskap.

- slutning fokuserer på å bruke en allerede trent modell for å generere resultater, noe som krever mindre beregningskraft, men et høyere fokus på lav latens og kostnadseffektivitet.

- Dette gjøres mer rutinemessig av AI-eksperter som bruker eksisterende modeller for å løse problemer i virkeligheten.

Så selv om kostnader åpenbart er en bekymring for både finjustering/opplæring og inferens/bruk av AI, vil opplæring ofte kreve den beste mulige maskinvaren, mens bruksoppgaver vil fokusere mer på maskinvarekostnadene og energiforbruket når man velger det beste maskinvarealternativet.

CPUer vs. GPUer

Sentrale prosessorenheter (CPU-er):

CPU-er er generelle formål og ikke spesifikt AI-maskinvare. De er imidlertid fortsatt essensielle for å utføre instruksjoner og grunnleggende beregninger i AI-systemer.

Det meste av programvaren som håndterer grensesnittet med sluttbrukerne av et AI-system vil også være CPU-sentrisk, enten det er individuelle datamaskiner eller skybasert programvare.

kilde: AnandTech

CPU-er kan også brukes til svært enkle AI-er, der dedikert maskinvare egentlig ikke er nødvendig. Dette gjelder spesielt når utdataene ikke er spesielt presserende, og den relativt tregere AI-prosesseringen til CPU-er ikke er et problem.

Så små modeller med små datamengder og beregninger kan fungere bra på CPUer. Den allestedsnærværende tilstedeværelsen av CPUer i vanlige datamaskiner gjør det også til et godt alternativ for en gjennomsnittlig bruker som ikke er villig til å investere i AI-spesifikk maskinvare.

CPU-er er også svært pålitelige og stabile, noe som gjør dem til et godt valg for kritiske oppgaver der ingen feil er et viktig kriterium.

Til slutt er CPU-er nyttige for noen av oppgavene i AI-trening, vanligvis i samarbeid med andre typer maskinvare, som datalasting, formatering, filtrering og visualisering.

Grafikkbehandlingsenheter (GPUer):

GPU-er, som opprinnelig var designet for grafikkgjengivelse, er designet for parallell prosessering, noe som gjør dem ideelle for trening av AI-modeller som krever håndtering av store datasett. Bytte fra CPU-er til GPU-er har redusert treningstiden fra uker til timer.

På grunn av deres utbredte tilgjengelighet og IT-spesialisters erfaring til å jobbe med dem, var GPU-er den første typen databehandlingsmaskinvare som ble installert i serie for å skalere opp AI-forskning.

kilde: Aorus

Nvidias utvikling av CUDA, et generelt programmeringsgrensesnitt for NVIDIAs GPU-er, var også avgjørende for GPU-enes suksess. Dette åpnet døren for andre bruksområder enn spilling. Dette ble gjort fordi noen forskere allerede brukte GPU-er til å utføre beregninger i stedet for vanlige superdatamaskiner.

«Forskerne innså at ved å kjøpe dette spillkortet kalt GeForce, legger du det til datamaskinen din, du har i hovedsak en personlig superdatamaskin.»

Molekylær dynamikk, seismisk prosessering, CT-rekonstruksjon, bildebehandling – en hel haug med forskjellige ting.»

I dag er GPU-er fortsatt blant de mest ettertraktede typene AI-maskinvare, og Nvidia klarer knapt å produsere nok til å dekke etterspørselen fra teknologigiganter som bygger AI-datasentre i gigawatt-skala.

Det er også begynnelsen på «super-GPU-æraen», med den nylige utgivelsen fra Nvidia av GB200 NVL72.

Denne maskinvaren er designet for å fungere som én massiv GPU rett fra fabrikken, i stedet for å måtte koble til mange små. Det gjør den mye kraftigere enn selv den tidligere rekordbrytende H100-modellen.

kilde: Nvidia

Dette bør også være mye mer energieffektivt, et avgjørende poeng ettersom AI-industrien kan komme til å gå glipp av energi før den går glipp av brikker med den hastigheten som AI-datasentre bygges med. Og mer databehandling og energieffektivitet betyr mindre spillvarme, noe som midlertidig løser problemet med overoppheting også.

| Maskinvaretype | Beste brukstilfelle | Speed | Energieffektivitet | Fleksibilitet |

|---|---|---|---|---|

| prosessor | Generelle oppgaver | Lav | Høyt | Svært høy |

| GPU | AI-opplæring og parallelle oppgaver | Høyt | Medium | Medium |

| TPU | Tensoroperasjoner og transformatorer | Svært høy | Høyt | Lav |

| ASIC | Akselerasjon av enkeltoppgaver | Svært høy | Svært høy | Veldig Lav |

| FPGA | Rekonfigurerbare AI-arbeidsbelastninger | Medium | Medium | Høyt |

Fremveksten av ASIC-er og AI-maskinvare

Applikasjonsspesifikke integrerte kretser (ASIC-er) er databehandlingsmaskinvare som er spesielt utviklet for en gitt dataoppgave, noe som gjør dem enda mer spesialiserte enn fortsatt relativt generelle GPU-er.

Så de er mindre fleksible og programmerbare enn maskinvare til generell bruk.

Som regel er de mer komplekse. De er også generelt dyrere, både på grunn av manglende stordriftsfordeler i produksjonen og kostnaden for spesialtilpassede design.

De er imidlertid mye mer effektive i sin gitte oppgave, og produserer vanligvis et resultat raskere med mye mindre bortkastet datakraft og energi.

Bruken av ASIC-er og annen AI-spesifikk maskinvare øker, ettersom feltet stadig legger merke til at noen beregninger ikke ideelt sett gjøres på GPU-er, men krever mer spesialisert utstyr.

Tensor Processing Units (TPUer)

TPU-er ble utviklet av Google (GOOGL ) spesielt for å utføre tensorberegninger (knyttet til transformatorbasert kalkulus). De er optimalisert for aritmetikk med høy gjennomstrømning og lav presisjon.

kilde: C#Hjørnet

Dette gir TPU-er høy ytelse, effektivitet og skalerbarhet for trening av store nevrale nettverk.

TPU-er har spesialiserte funksjoner, som matrisemultiplikasjonsenheten (MXU) og proprietær sammenkoblingstopologi, som gjør dem ideelle for å akselerere AI-trening og inferens.

TPU-er driver Gemini og alle Googles AI-drevne applikasjoner som Søk, Bilder og Kart, og betjener over 1 milliard brukere.

Denne maskinvaretypen kan øke hastigheten på utviklingen og driften av nevrale nettverk betydelig, hvor sporadiske feil er mindre betydelige, ettersom disse modellene er svært avhengige av statistikk og et stort antall beregninger til å begynne med.

Blant sluttbrukeroppgavene som passer best for TPU-er er dyp læring, talegjenkjenning og bildeklassifisering.

Nevrale nettverksprosessorer (NNP-er):

NPP-er, også knyttet til nevrale prosesseringsenheter (NPU-er) og kalt nevromorfe brikker, er spesialisert i beregning av nevrale nettverk, designet for å etterligne nevrale forbindelser i den menneskelige hjerne. De kalles også noen ganger en AI-akselerator, selv om dette begrepet er mindre veldefinert.

En NPU vil også integrere lagring og beregning gjennom synaptiske vekter. Slik at den kan justere eller «lære» over tid, noe som fører til forbedret driftseffektivitet.

En NPU inkluderer spesifikke moduler for multiplikasjon og addisjon, aktiveringsfunksjoner, 2D-dataoperasjoner og dekompresjon.

Den spesialiserte multiplikasjons- og addisjonsmodulen brukes til å utføre operasjoner som er relevante for behandling av nevrale nettverksapplikasjoner, for eksempel beregning av matrisemultiplikasjon og addisjon, konvolusjon, punktprodukt og andre funksjoner.

Spesialiseringen kan hjelpe en NPU med å fullføre en operasjon med bare én beregning i stedet for flere tusen med generell maskinvare. For eksempel, IBM hevder at NPU kan forbedre effektiviteten til AI-beregninger radikalt sammenlignet med GPU-er.

«Testing har vist at ytelsen til noen NPU-er er over 100 ganger bedre enn en sammenlignbar GPU, med samme strømforbruk.»

På grunn av denne energieffektiviteten er NPU-er populære blant produsenter å installere i brukerenheter, der de kan bidra til å utføre lokale oppgaver for generative AI-apper, et eksempel på «edge computing». (se nedenfor for mer om dette emnet).

Mange metoder blir for tiden utforsket for å lage nevromorfe brikker:

- Utnytt begynnende ferroelektrisitet, et fortsatt dårlig forstått fenomen.

- Aktivt substrat ved bruk av vanadium eller titan.

- Bruk av memristorer, en ny type elektronisk komponent, som kan utføre AI-oppgaver på 1/800thav det normale strømforbruket.

Ahjelpemiddel Processing Unit (XPU-er)

XPU slår sammen CPU (prosessor), GPU (grafikkort/parallelle prosessorer) og minne i den samme elektroniske enheten.

kilde: Broadcom

XPU-er er et bredt begrep som omfatter mange varianter av dette konseptet med å bringe all maskinvaren inn i selvstendige enheter, inkludert Databehandlingsenheter (DPU-er), Infrastrukturbehandlingsenheter (IPU-er), og Funksjonsakseleratorkort (FAC-er).

XPU-er blir sett på som en løsning på et voksende problem for AI-datasentre, som er det økende behovet for tilkobling mellom underenhetene, til det punktet hvor dataforsinkelser blir en viktig faktor for å bremse databehandling, mer enn den tilgjengelige datakraften.

I hovedsak venter brikkene (GPU-er, TPU-er, NPP-er osv.) på dataene like mye som de faktisk fungerer.

En leder innen denne teknologien er Broadcom (AVGO ), Som vi diskuterte det i detalj i en egen investeringsrapport.

Feltprogrammerbare gatearrayer (FPGA-er):

FPGA-er er programmerbare prosessorer, noe som gjør dem betydelig mer fleksible og rekonfigurerbare enn de mer rigide ASIC-ene. FPGA-er kan tilpasses for spesifikke AI-algoritmer, noe som potensielt kan tilby høyere ytelse og energieffektivitet.

kilde: Mikrokontroller Labs

Fleksibiliteten kommer med en kostnad, ettersom FPGA-er generelt er mer komplekse, dyre og bruker mer strøm. De kan imidlertid fortsatt være mer effektive enn generell maskinvare.

Dette gjør dem til et nisjeprodukt, der fleksibiliteten deres kompenserer for ulempene. For eksempel kan maskinlæring, datasyn og naturlig språkbehandling dra nytte av FPGA-enes allsidighet.

Høybåndbreddeminne (HBM):

Den viktigste utviklingen innen tilpasset AI-sentrisk maskinvare har vært innen datakraft, som lenge var et hinder i å bygge mer datakapasitet for å trene nye AI-er.

Likevel trenger disse systemene også høyeffektive støttesystemer, hvorav minne er et viktig et. HBM gir, som navnet antyder, høyere båndbredde enn tradisjonell DRAM.

Det oppnås ved å stable flere DRAM-brikker vertikalt og koble dem sammen med gjennomgående silisiumvias (TSV-er). Den første generasjonen av HBM ble utviklet i 2013.

Den vertikale stablingen sparer plass og reduserer den fysiske avstanden dataene må reise, noe som fremskynder dataoverføringen, et must i AI-databehandling.

HBM-er er mer komplekse å produsere og dyrere enn DRAM, men fordelene med ytelse og energieffektivitet rettferdiggjør ofte den høyere kostnaden for AI-applikasjoner.

AI-datasenterinfrastruktur: Strøm, kjøling og tilkobling

I tillegg til minne og datakraft er også hjelpesystemene i AI-datasentre viktige. Uten dem kan ikke dataene sirkulere raskt nok, brikkene ville overopphetes, eller den tilgjengelige strømmen ville være utilstrekkelig.

Dette betyr at for eksempel Broadcom-tilkoblingsmaskinvare også drar stor nytte av oppbygging av AI-datasentre, i likhet med spesialiserte løsninger som leverandører av kjøleutstyr, for eksempel Vertiv. (VRT ) eller Schneider Electric (SU.PA).

Strømforsyning kan også bli et problem, og flere teknologigiganter prøver å takle problemet ved å satse på kjernekraft. med det første trekket fra Microsoft i 2024, etterfulgt av mange andre siden.

Kombinert med en forpliktelse til å redusere karbonavtrykket til AI fra teknologiselskaper, bør dette være til stor fordel for selskaper innen kjernekraft eller fornybar energi, som cameco (CCJ ), GE Vernova (GEV ), First Solar (FSLR ), NextEra (NEE )eller Brookfield Energy Partners (BEP ) (følg lenkene for en rapport om hvert selskap).

Nye AI-databehandlingsteknologier

Quantum Computing

Fordi AI er så sulten på datakraft, er det mulig at fremtiden til feltets maskinvare ikke engang ligger i de nåværende tilgjengelige silisiumløsningene.

En mulighet er at kvantedatamaskiner kan brukes til å oppdage mønstre mye mer effektivt enn klassisk databehandling noen gang kunne, noe som allerede er utforsket av forskere.

Kvantedatamaskiner som helhet kan brukes til å løse spesifikke beregninger som er nesten umulige med binær databehandling. Dette vil sannsynligvis til slutt bli brukt på kunstig intelligens, men de første kommersielle kvantedatamaskinene er fortsatt noen år unna, og et stort kvantenettverk enda lenger unna.

Photonics

Ved å bruke lys i stedet for elektroner til å bære data, kan fotonikk være mye raskere enn elektroniske enheter.

Fordi kvantedatamaskiner vanligvis bærer kvantedata med sammenfiltrede fotoner, er det også mye overlapping mellom kvantedatabehandling og fotonikk, og Den første dobbelte kvantefotoniske brikken er allerede annonsert.

Organoider

Ettersom de fleste kunstige intelligenser replikerer funksjonen til hjernens nevrale nettverk i datamaskiner, lurer noen forskere på om vi ikke i stedet kunne bruke … faktiske hjerneceller.

Dette er en spennende idé, spesielt siden Noe forskning kan tyde på at hjernen faktisk er en organisk kvantedatamaskin.

Denne typen «datamaskin» kalles organoider, og består i hovedsak av nevroner dyrket i et laboratorium på en databrikke. Nevronene organiserer deretter dendrittene og forbindelsene sine selv som respons på stimulansen fra brikkesystemet.

Denne teknologien er fortsatt ny og er avhengig av bio-3D-printing.

andre

Vi utforsket andre alternativer til silisiumdatabehandling i «Topp 10 ikke-silisium databedrifter”, som for eksempel vanadiumdioksid, grafen, redoks-gating eller organiske materialer.

Hver av dem lover å være enten mye raskere eller mye mindre energikrevende enn klassisk silisiumbasert databehandling. De er imidlertid fortsatt relativt nye og vil neppe revolusjonere feltet AI i kommersiell skala, i hvert fall ikke de neste 5–10 årene.

Cloud AI og Edge AI: Tilgjengelighetstrender

Cloud AI

Ettersom de kraftigste AI-systemene lages av store teknologiselskaper, er de stort sett tilgjengelige via skyen. Det samme er i ferd med å bli tilfelle for tilgang til AI-spesialisert maskinvare.

Lederen for denne trenden er Kjernevev (CRCW ), et selskap som gikk fra å være en skyleverandør til kryptovalutautvinning ved hjelp av GPU-er, til i dag å tilby AI-beregning på forespørsel.

Dette gjorde CoreWeave til en nøkkelpartner for kommende AI-oppstartsbedrifter som prøver å konkurrere med teknologigiganter, som Bøyning AI og dens GPU-klynge på 1.3 milliarder dollar, finansiert av en ny finansieringsrunde.

«For to måneder siden kunne et selskap kanskje ikke ha eksistert, og nå har de kanskje 500 millioner dollar i risikokapitalfinansiering.

Og det viktigste de må gjøre er å sikre tilgang til databehandling. De kan ikke lansere produktet sitt eller lansere virksomheten sin før de har det.»

Etter hvert som den rene aktøren innen AI-maskinvare blir skeptisk til store teknologiselskaper som produserer sine egne GPU-er, TPU-er, XPU-er osv. og utvikler seg fra å være klienter til konkurrenter, er det sannsynlig at selskaper som CoreWeave vil få prioritert tilgang til den nyeste maskinvareutgivelsen fra Nvidia og andre.

Denne forretningsmodellen vil sannsynligvis være spesielt viktig for AI-opplæring, som er mye mer krevende når det gjelder datakapasitet enn bare å bruke de allerede trente AI-ene.

Edge Computing og AI-PC-er

Et annet tilfelle av AI-databehandling som er i rask utvikling, er behovet for å få databehandlingen av AI-systemer gjort på stedet, så nært virkelige situasjoner som mulig.

Dette er et must for systemer som kanskje ikke tolererer å bli koblet fra AI hvis forbindelsen svikter, eller når latensen frem og tilbake med skyen er for langsom.

Et godt eksempel er selvkjørende biler, som forventes å kunne forstå omgivelsene sine offline.

Denne typen beregning kalles edge computing, og drar stor nytte av mer effektiv og mindre strømkrevende maskinvare.

Det kan øke påliteligheten til AI, og etter hvert som modellene blir mer effektive, illustrert av spranget fremover til DeepSeek, kan det bli en mer utbredt modell for AI-distribusjon i fremtiden.

Av samme grunn, AI-PC-er som den som nylig ble lansert av Nvidia, kan på lang sikt være nok til å kjøre mange AI-applikasjoner lokalt, noe som øker personvernet og sikkerheten sammenlignet med å alltid være koblet til skybaserte AI-er.

Konklusjon

AI-maskinvare har en stund vært noe synonymt med GPU-er, ettersom grafikkort var mye mer effektive til AI-trening enn andre typer maskinvare som CPU-er. Dette ga Nvidia og mange av selskapets tidlige aksjonærer en formue.

GPU-er, spesielt AI-fokuserte «super-GPU-er», vil sannsynligvis forbli viktige i byggingen av AI-datasentre. Men de vil utvikle seg til bare én av komponentene i stadig mer komplekse og spesialiserte systemer.

Transformatoroperasjoner vil bli sendt til TPU-er, nevrale nettverk som er tildelt NPP, og gjentatte oppgaver til dedikerte ASIC-er eller rekonfigurerte FPGA-er.

I mellomtiden vil minne med høy båndbredde, avanserte telekommunikasjonskontakter og ultraeffektiv kjøling holde alle hjelpefunksjonene rundt datakjernen i gang.

For kantdatabehandling og mindre AI-er enn de massive LLM-ene, vil lokal databehandling, kanskje drevet av alt-i-ett-XPU-er, sannsynligvis bli brukt av forskere, selvkjørende biler og brukere som er bekymret for personvern eller sensur, potensielt med åpen kildekode-AI-modeller.

Det som er sikkert er at profitten fra å selge «hakker og spader» av AI-maskinvare i AI-gullrushet langt fra er over.

Etter en periode med Nvidias dominans, kan det være lurt å diversifisere risikoen ved å spre sin IA-maskinvareportefølje til andre design, og kanskje til og med strømselskapene som vil levere de verdifulle gigawattene til å drive de stadig større og tallrike AI-datasentrene i verden.