Intelligenza Artificiale

Investire nell'hardware AI: dalle CPU alle XPU

Securities.io mantiene rigorosi standard editoriali e potrebbe ricevere compensi per i link recensiti. Non siamo consulenti finanziari registrati e questo non costituisce consulenza finanziaria. Si prega di consultare il nostro divulgazione di affiliati.

Investire in hardware AI: approccio con picconi e pale

L'intelligenza artificiale promette di rappresentare il cambiamento più importante nella nostra economia, nei nostri sistemi produttivi e nella nostra società degli ultimi decenni, rendendo potenzialmente banali persino i cambiamenti radicali apportati da Internet.

Potrebbe far scomparire un'intera categoria di lavori, tra cui autisti, traduttori, addetti all'assistenza clienti, web designer, ecc. Altri lavori potrebbero vedere una drastica riduzione della domanda, come programmatori, avvocati principianti, diagnostici, ecc.

Dovrebbe inoltre creare molto valore aggiunto e produttività per molte altre attività, con le aziende leader nel software di intelligenza artificiale che saranno probabilmente le prime a raggiungere capitalizzazioni di mercato prima inimmaginabili.

Per tutte queste ragioni, i mercati dei capitali e gli investitori sono rimasti affascinati dall'intelligenza artificiale e prestano molta attenzione ai progressi dei numerosi giganti della tecnologia in questo campo, nonché alla forte concorrenza emergente da parte di giganti della tecnologia cinese come Alibaba e startup come DeepSeek.

Un altro modo per sfruttare il boom dell'intelligenza artificiale è seguire la strategia che funziona in ogni corsa all'oro: non cercare l'oro, ma vendere picconi e pale. Questo ha sicuramente funzionato per le aziende che si trovavano nella posizione migliore per vendere hardware ottimizzato per l'intelligenza artificiale, con Nvidia (NVDA -2.17%) avendo trasformato le sue schede grafiche per il gaming in chip per l'addestramento all'intelligenza artificiale, diventando l'azienda più preziosa al mondo, avendo superato la sorprendente capitalizzazione di mercato di 4 trilioni di dollari (segui il link per un report completo su Nvidia).

Poiché l'intelligenza artificiale richiede hardware molto specifico, per lo più diverso da altre precedenti forme di attività informatiche, e rappresenta un'enorme opportunità commerciale, l'industria dei semiconduttori è ora impegnata in una corsa allo sviluppo di nuove forme di hardware progettate specificamente per la formazione e l'esecuzione di programmi di intelligenza artificiale.

Sebbene sia probabile che Nvidia rimanga una delle aziende leader del settore, ora stanno emergendo alternative che potrebbero offrire opportunità interessanti per gli investitori che presteranno attenzione per tempo.

Perché l'intelligenza artificiale ha bisogno di hardware specializzato

Molti piccoli calcoli

I primi sforzi nell'ambito dell'intelligenza artificiale utilizzavano la stessa capacità di calcolo di altri programmi, concentrandosi principalmente sui processori (Central Processing Unit, CPU). Le CPU sono ancora importanti, ma è presto emerso che non sono ottimali per la maggior parte dei metodi attualmente utilizzati per sviluppare IA.

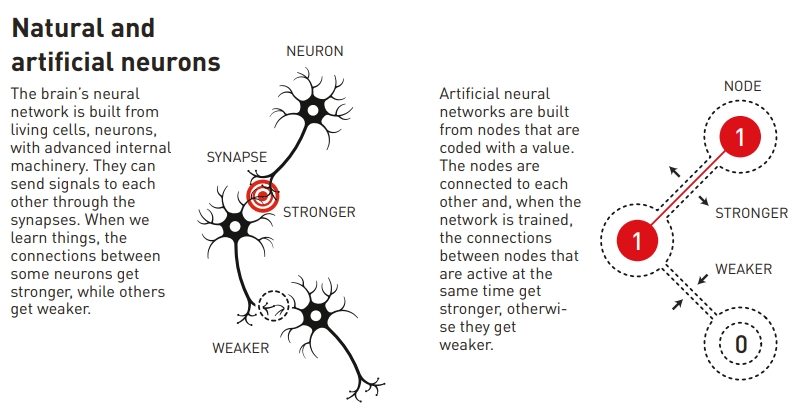

Le reti neurali e altri metodi simili richiedono molti calcoli relativamente semplici, anziché un singolo calcolo molto complesso. Molti chip più piccoli che lavorano in parallelo sono generalmente preferibili rispetto a CPU enormi e potenti.

Questo è in gran parte il motivo per cui le GPU sono diventate rapidamente più popolari, poiché le schede grafiche sono intrinsecamente progettate per eseguire migliaia di calcoli più piccoli in parallelo.

L'addestramento dell'intelligenza artificiale odierno si basa in gran parte sulle reti neurali, un concetto che ha vinto il Premio Nobel per la fisica nel 2024, un premio di cui abbiamo parlato in dettaglio in un articolo dedicato all'epoca.

Fonte: Premio Nobel

Una seconda rivoluzione nella tecnologia dell'intelligenza artificiale è arrivata con i "trasformatori". Essi risolvono i problemi delle reti neurali tradizionali. incapacità di elaborare in modo efficiente lunghe sequenze di dati, una caratteristica comune di qualsiasi linguaggio naturale.

Introdotti per la prima volta nel 2017 dai ricercatori di Google, sono la causa principale dell'attuale esplosione delle capacità dell'intelligenza artificiale. I trasformatori sono al centro di prodotti di intelligenza artificiale come gli LLM (Large Language Models), tra cui ChatGPT.

Requisiti diversi

Una distinzione importante nei flussi di lavoro dell'IA è la differenza tra ritocchi e inferenza, entrambe con requisiti hardware distinti.

- Ritocchi comporta l'addestramento di un modello su dati specifici di un dominio, il che richiede notevole potenza di calcolo e memoria. È un compito molto tecnico, spesso ai limiti della scienza dell'intelligenza artificiale.

- Inferenza si concentra sull'utilizzo di un modello già addestrato per generare output, richiedendo meno potenza di calcolo ma concentrandosi maggiormente sulla bassa latenza e sull'efficienza dei costi.

- Questa attività viene svolta più frequentemente dagli esperti di intelligenza artificiale, che utilizzano modelli preesistenti per risolvere problemi della vita reale.

Quindi, sebbene i costi siano ovviamente un problema sia per la messa a punto/addestramento che per l'inferenza/uso dell'IA, l'addestramento richiederà spesso il miglior hardware possibile, mentre le attività di utilizzo si concentreranno maggiormente sul costo dell'hardware e sul consumo energetico quando si sceglie l'opzione hardware migliore.

CPU contro GPU

Unità di elaborazione centrale (CPU):

Le CPU sono hardware generici e non specificamente dedicati all'intelligenza artificiale. Tuttavia, sono comunque essenziali per l'esecuzione di istruzioni e calcoli di base nei sistemi di intelligenza artificiale.

La maggior parte del software che gestisce l'interfaccia con gli utenti finali di un sistema di intelligenza artificiale sarà anch'esso incentrato sulla CPU, che si tratti di singoli computer o di software basati su cloud.

Fonte: AnandTech

Le CPU possono essere utilizzate anche per IA molto semplici, dove non è realmente necessario hardware dedicato. Questo è particolarmente vero quando l'output non è particolarmente urgente e la relativamente più lenta elaborazione IA delle CPU non rappresenta un problema.

Quindi, modelli di piccole dimensioni con piccoli lotti di dati e calcoli possono funzionare bene sulle CPU. L'onnipresenza delle CPU nei computer tradizionali le rende anche una buona opzione per l'utente medio che non è disposto a investire in hardware specifico per l'intelligenza artificiale.

Le CPU sono inoltre molto affidabili e stabili, il che le rende un'ottima scelta per attività critiche in cui l'assenza di errori è un criterio importante.

Infine, le CPU sono utili per alcune attività di addestramento dell'intelligenza artificiale, generalmente in collaborazione con altri tipi di hardware, come il caricamento dei dati, la formattazione, il filtraggio e la visualizzazione.

Unità di elaborazione grafica (GPU):

Originariamente progettate per il rendering grafico, le GPU sono progettate per l'elaborazione parallela, il che le rende ideali per l'addestramento di modelli di intelligenza artificiale che richiedono la gestione di grandi set di dati. Il passaggio dalle CPU alle GPU ha ridotto i tempi di addestramento da settimane a ore.

Grazie alla loro ampia diffusione e all'esperienza degli specialisti IT nel lavorarci, le GPU sono state il primo tipo di hardware informatico a essere installato in serie per ampliare la ricerca sull'intelligenza artificiale.

Fonte: Aorus

Un altro fattore determinante per il successo delle GPU fu lo sviluppo di CUDA da parte di NVIDIA, un'interfaccia di programmazione generica per le GPU NVIDIA, che aprì la strada ad altri usi oltre al gaming. Questo perché alcuni ricercatori utilizzavano già le GPU per eseguire calcoli al posto dei consueti supercomputer.

"I ricercatori hanno capito che acquistando questa scheda video da gioco chiamata GeForce, la si aggiunge al computer e si ottiene essenzialmente un supercomputer personale.

Dinamica molecolare, elaborazione sismica, ricostruzione TC, elaborazione delle immagini: un sacco di cose diverse."

Oggi, le GPU sono ancora tra i tipi di hardware per l'intelligenza artificiale più richiesti, con Nvidia che riesce a malapena a produrne abbastanza per soddisfare la domanda dei giganti della tecnologia che costruiscono data center per l'intelligenza artificiale su scala gigawatt.

È anche l'inizio dell'era delle "super GPU", con il recente rilascio da parte di Nvidia di il GB200 NVL72.

Questo hardware è progettato per funzionare come un'unica, enorme GPU direttamente dalla fabbrica, anziché dover collegare in rete tante piccole GPU. Questo lo rende molto più potente persino del precedente modello H100, che aveva battuto ogni record.

Fonte: Nvidia

Questo dovrebbe anche essere molto più efficiente dal punto di vista energetico, un punto cruciale poiché l'industria dell'intelligenza artificiale potrebbe trovarsi a corto di energia prima di ritrovarsi a corto di chip, alla velocità con cui vengono costruiti i data center dedicati all'intelligenza artificiale. E una maggiore efficienza energetica e di elaborazione significa meno calore di scarto, il che risolve temporaneamente anche il problema del surriscaldamento.

| Tipo di hardware | Miglior caso d'uso | Velocità | Energy Efficiency | Flessibilità |

|---|---|---|---|---|

| CPU | Attività di uso generale | Basso | Alto | Molto alto |

| GPU | Formazione AI e attività parallele | Alto | Medio | Medio |

| TPU | Operazioni tensoriali e trasformatori | Molto alto | Alto | Basso |

| ASIC | Accelerazione di singole attività | Molto alto | Molto alto | Molto basso |

| FPGA | Carichi di lavoro di intelligenza artificiale riconfigurabili | Medio | Medio | Alto |

L'ascesa degli ASIC e dell'hardware AI

I circuiti integrati specifici per l'applicazione (ASIC) sono hardware di elaborazione progettati specificamente per una determinata attività di elaborazione, il che li rende ancora più specializzati rispetto alle GPU, che sono comunque relativamente generaliste.

Sono quindi meno flessibili e programmabili rispetto all'hardware generico.

Di norma, tendono ad essere più complessi. Sono anche generalmente più costosi, sia per la mancanza di economie di scala nella loro produzione, sia per il costo dei progetti personalizzati.

Tuttavia, sono molto più efficienti nel loro compito specifico e solitamente producono un output più velocemente con molto meno spreco di potenza di calcolo ed energia.

L'utilizzo di ASIC e altri hardware specifici per l'intelligenza artificiale è in aumento, poiché il settore sta progressivamente notando che alcuni calcoli non vengono eseguiti in modo ideale sulle GPU, ma richiedono apparecchiature più specializzate.

Unità di elaborazione tensore (TPU)

Le TPU sono state sviluppate da Google (GOOGL -2.34%) Specificamente per eseguire calcoli tensoriali (collegati al calcolo basato su trasformatori). Sono ottimizzati per calcoli aritmetici ad alta produttività e bassa precisione.

Fonte: Angolo C#

Ciò conferisce alle TPU elevate prestazioni, efficienza e scalabilità per l'addestramento di grandi reti neurali.

Le TPU possiedono caratteristiche specializzate, come l'unità di moltiplicazione della matrice (MXU) e la topologia di interconnessione proprietaria, che le rendono ideali per accelerare l'addestramento e l'inferenza dell'IA.

Le TPU sono alla base di Gemini e di tutte le applicazioni di Google basate sull'intelligenza artificiale, come Ricerca, Foto e Maps, che servono oltre 1 miliardo di utenti.

Questo tipo di hardware può accelerare notevolmente lo sviluppo e il funzionamento delle reti neurali, dove l'errore occasionale è meno significativo, poiché questi modelli si basano in larga misura sulle statistiche e su un gran numero di calcoli.

Tra le attività dell'utente finale più adatte alle TPU ci sono l'apprendimento profondo, il riconoscimento vocale e la classificazione delle immagini.

Processori di reti neurali (NNP):

Collegati anche alle unità di elaborazione neurale (NPU) e chiamati chip neuromorfici, gli NPP sono specializzati nel calcolo delle reti neurali, progettati per imitare le connessioni neurali del cervello umano. A volte vengono anche chiamati acceleratori di intelligenza artificiale, sebbene questo termine sia meno definito.

Una NPU integrerà anche storage e calcolo tramite pesi sinaptici. In questo modo, potrà adattarsi o "apprendere" nel tempo, migliorando l'efficienza operativa.

Una NPU include moduli specifici per moltiplicazione e addizione, funzioni di attivazione, operazioni sui dati 2D e decompressione.

Il modulo specializzato di moltiplicazione e addizione viene utilizzato per eseguire operazioni rilevanti per l'elaborazione di applicazioni di reti neurali, come il calcolo della moltiplicazione e dell'addizione di matrici, della convoluzione, del prodotto scalare e di altre funzioni.

La specializzazione può aiutare una NPU a completare un'operazione con un solo calcolo invece di diverse migliaia con un hardware generalista. Ad esempio, IBM sostiene che la NPU può migliorare radicalmente l'efficienza del calcolo dell'intelligenza artificiale rispetto alle GPU.

"I test hanno dimostrato che le prestazioni di alcune NPU sono oltre 100 volte migliori rispetto a quelle di una GPU comparabile, con lo stesso consumo energetico."

Grazie a questa efficienza energetica, le NPU sono molto diffuse tra i produttori, che le installano nei dispositivi degli utenti, dove possono aiutare a svolgere localmente attività per le app di intelligenza artificiale generativa, un esempio di "edge computing" (vedere di seguito per maggiori informazioni sull'argomento).

Attualmente si stanno esplorando molti metodi per creare chip neuromorfici:

- Sfruttare la ferroelettricità incipiente, un fenomeno ancora poco compreso.

- Substrato attivo con vanadio o titanio.

- Utilizzo dei memristori, un nuovo tipo di componente elettronico, che può eseguire attività di intelligenza artificiale a 1/800thdel normale consumo energetico.

Aausiliario Psfornare Ulendine (XPU)

XPU unisce CPU (processore), GPU (scheda grafica/processori paralleli) e memoria nello stesso dispositivo elettronico.

Fonte: Broadcom

XPU è un termine ampio, che comprende molte varianti di questo concetto di portare tutto l'hardware in unità autonome, tra cui Unità di elaborazione dati (DPU), Unità di elaborazione delle infrastrutture (IPU), e Schede acceleratrici di funzioni (FAC).

Le XPU sono considerate la soluzione a un problema crescente dei data center di intelligenza artificiale, ovvero la crescente necessità di connettività tra le sotto-unità, al punto che il ritardo dei dati diventa un fattore importante nel rallentamento dell'elaborazione, più della potenza di calcolo disponibile.

In sostanza, i chip (GPU, TPU, NPP, ecc.) sono in attesa dei dati tanto quanto lo sono effettivamente quando sono in funzione.

Un leader di questa tecnologia è Broadcom (AVGO -2.82%), quale ne abbiamo discusso in dettaglio in un report dedicato agli investimenti.

Array di porte programmabili sul campo (FPGA):

Gli FPGA sono processori programmabili, il che li rende significativamente più flessibili e riconfigurabili rispetto ai più rigidi ASIC. Gli FPGA possono essere personalizzati per specifici algoritmi di intelligenza artificiale, offrendo potenzialmente prestazioni ed efficienza energetica più elevate.

La flessibilità ha un costo, poiché gli FPGA sono generalmente più complessi, costosi e consumano più energia. Tuttavia, possono comunque essere più efficienti dell'hardware generalista.

Questo li rende in un certo senso un prodotto di nicchia, la cui flessibilità compensa gli svantaggi. Ad esempio, l'apprendimento automatico, la visione artificiale e l'elaborazione del linguaggio naturale possono trarre vantaggio dalla versatilità degli FPGA.

Memoria ad alta larghezza di banda (HBM):

Gli sviluppi più importanti nell'hardware personalizzato incentrato sull'intelligenza artificiale hanno riguardato il campo della potenza di calcolo, che per lungo tempo ha rappresentato il punto critico nella creazione di una maggiore capacità di calcolo per addestrare nuove IA.

Tuttavia, questi sistemi necessitano anche di sistemi di supporto ad alta efficienza, tra cui la memoria è un elemento importante. HBM offre, come suggerisce il nome, una larghezza di banda maggiore rispetto alle DRAM tradizionali.

Si ottiene impilando verticalmente più die DRAM e collegandoli tramite vie passanti nel silicio (TSV). La prima generazione di HBM è stata sviluppata nel 2013.

L'impilamento verticale consente di risparmiare spazio e riduce la distanza fisica che i dati devono percorrere, velocizzando il trasferimento dei dati, un aspetto fondamentale nell'informatica basata sull'intelligenza artificiale.

Le memorie HBM sono più complesse da produrre e costose delle DRAM, ma i vantaggi in termini di prestazioni ed efficienza energetica giustificano spesso i costi più elevati per le applicazioni di intelligenza artificiale.

Infrastruttura del data center AI: alimentazione, raffreddamento e connettività

Oltre alla memoria e alla potenza di calcolo, anche i sistemi ausiliari dei data center di intelligenza artificiale sono importanti. Senza di essi, i dati non potrebbero circolare abbastanza velocemente, i chip si surriscalderebbero o la potenza disponibile sarebbe insufficiente.

Ciò significa, ad esempio, che anche l'hardware di connettività Broadcom trae grandi vantaggi dall'accumulo di data center AI, così come soluzioni specializzate come i fornitori di apparecchiature di raffreddamento, ad esempio Vertiv (VRT -0.53%) o Schneider Electric (SU.PA).

Anche l'approvvigionamento energetico potrebbe diventare un problema e diversi giganti della tecnologia stanno cercando di affrontare la questione puntando sull'energia nucleare. con la prima mossa di Microsoft nel 2024, seguito da molti altri da allora.

In combinazione con l'impegno delle aziende tecnologiche a ridurre l'impronta di carbonio dell'intelligenza artificiale, ciò dovrebbe apportare grandi benefici alle aziende del settore nucleare o dell'energia rinnovabile, come Cameco (CCJ -0.72%), GEVernova (GEV -2.29%), First Solar (FSLR + 2.4%), Era successiva (NEE + 0.26%), o Partner energetici di Brookfield (BEP + 1.02%) (seguire i link per un report su ciascuna azienda).

Tecnologie informatiche emergenti basate sull'intelligenza artificiale

Quantum Computing

Poiché l'intelligenza artificiale è così affamata di potenza di calcolo, è possibile che il futuro dell'hardware in questo campo non sia garantito nemmeno dalle soluzioni in silicio attualmente disponibili.

Una possibilità è che il calcolo quantistico possa essere utilizzato per rilevare modelli in modo molto più efficiente di quanto potrebbe mai fare il calcolo classico, qualcosa già esplorato dai ricercatori.

L'informatica quantistica nel suo complesso potrebbe essere utilizzata per risolvere calcoli specifici quasi impossibili con l'informatica binaria. Probabilmente questa tecnologia verrà applicata all'intelligenza artificiale, ma i primi computer quantistici commerciali sono ancora lontani, e una rete quantistica di grandi dimensioni è ancora più lontana.

Photonics

Utilizzando la luce al posto degli elettroni per trasportare i dati, la fotonica potrebbe essere molto più veloce dei dispositivi elettronici.

Poiché i computer quantistici solitamente trasportano dati quantistici con fotoni entangled, c'è anche molta sovrapposizione tra il calcolo quantistico e la fotonica, e è già stato annunciato il primo chip fotonico quantistico duale.

organoidi

Poiché la maggior parte dell'intelligenza artificiale riproduce nei computer il funzionamento delle reti neurali del cervello, alcuni ricercatori si chiedono se non potremmo invece utilizzare... vere e proprie cellule cerebrali.

Questa è un'idea intrigante, soprattutto perché alcune ricerche potrebbero indicare che il cervello è in realtà un computer quantistico organico.

Questo tipo di "computer" è chiamato organoide ed è costituito essenzialmente da neuroni coltivati in laboratorio su un chip. I neuroni auto-organizzano i loro dendriti e connessioni in risposta allo stimolo del chip.

Questa tecnologia è ancora nuova e si basa su stampa bio-3D.

Altro

Abbiamo esplorato altre alternative al calcolo al silicio in "Le 10 migliori aziende informatiche non basate sul silicio”, come il biossido di vanadio, il grafene, il gating redox o i materiali organici.

Ognuno di essi promette di essere molto più veloce o molto meno dispendioso in termini energetici rispetto ai classici sistemi di elaborazione basati sul silicio. Tuttavia, sono ancora relativamente nuovi e difficilmente rivoluzioneranno il campo dell'intelligenza artificiale su scala commerciale, almeno per i prossimi 5-10 anni.

Cloud AI e Edge AI: tendenze di accessibilità

IA cloud

Poiché i sistemi di intelligenza artificiale più potenti sono realizzati da grandi aziende tecnologiche, sono per lo più accessibili tramite il cloud. Lo stesso sta accadendo per l'accesso all'hardware specializzato in intelligenza artificiale.

Il leader di questa tendenza è Coreweave (CRCW -7.69%), un'azienda che è passata dall'essere un fornitore di servizi cloud al mining di criptovalute tramite GPU, per arrivare oggi a fornire elaborazione AI on-demand.

Ciò ha reso CoreWeave un partner chiave per le future startup di intelligenza artificiale che cercano di competere con i giganti della tecnologia, come Inflessione AI e il suo tool proprietario Cluster GPU da 1.3 miliardi di dollari, finanziato da un nuovo round di finanziamenti.

"Due mesi fa, un'azienda potrebbe non esistere e ora potrebbe avere 500 milioni di dollari di finanziamenti di capitale di rischio.

E la cosa più importante per loro è garantire l'accesso al computer; non possono lanciare il loro prodotto o avviare la loro attività finché non lo avranno",

Poiché i veri protagonisti dell'hardware AI stanno diventando diffidenti nei confronti delle grandi aziende tecnologiche che producono le proprie GPU, TPU, XPU, ecc. e che si stanno evolvendo da clienti a concorrenti, è probabile che aziende come CoreWeave avranno accesso prioritario alle ultime versioni hardware di Nvidia e altre.

Questo modello di business sarà probabilmente particolarmente importante per la formazione dell'IA, che richiede una capacità di calcolo molto più elevata rispetto al semplice utilizzo di IA già addestrate.

Edge Computing e PC con intelligenza artificiale

Un altro caso di elaborazione basata sull'intelligenza artificiale in rapida evoluzione è la necessità di eseguire l'elaborazione dei sistemi di intelligenza artificiale in loco, il più vicino possibile alle situazioni della vita reale.

Questo è un requisito essenziale per i sistemi che potrebbero non tollerare la disconnessione dall'IA in caso di interruzione della connessione o quando la latenza tra i due sistemi e il cloud è troppo lenta.

Un buon esempio sono le auto a guida autonoma, che dovrebbero essere in grado di comprendere l'ambiente circostante anche offline.

Questo tipo di calcolo è chiamato edge computing e trae grandi vantaggi da hardware più efficienti e meno dispendiosi in termini di energia.

Può aumentare l'affidabilità dell'intelligenza artificiale e, man mano che i modelli diventano più efficienti, come dimostra il balzo in avanti di DeepSeek, potrebbe diventare un modello più diffuso di implementazione dell'intelligenza artificiale in futuro.

Per lo stesso motivo, i PC AI come quello lanciato di recente da Nvidia, potrebbe essere sufficiente a lungo termine per eseguire molte applicazioni di intelligenza artificiale in locale, aumentando la privacy e la sicurezza rispetto alle IA sempre connesse al cloud.

Conclusione

Per un certo periodo, l'hardware per l'intelligenza artificiale è stato in qualche modo sinonimo di GPU, poiché le schede grafiche erano molto più efficienti nell'addestramento dell'intelligenza artificiale rispetto ad altri tipi di hardware come le CPU. Questo ha fatto la fortuna di Nvidia e di molti dei suoi primi azionisti.

Le GPU, in particolare le "super GPU" focalizzate sull'intelligenza artificiale, continueranno probabilmente a svolgere un ruolo importante nella realizzazione di data center basati sull'intelligenza artificiale. Ma si evolveranno in uno dei componenti di sistemi sempre più complessi e specializzati.

Le operazioni del trasformatore saranno inviate alle TPU, le reti neurali saranno assegnate alle NPP, le attività ripetute ad ASIC dedicati o FPGA riconfigurati.

Nel frattempo, la memoria ad alta larghezza di banda, i connettori di telecomunicazione avanzati e il raffreddamento ultra-efficiente manterranno attive tutte le funzioni ausiliarie del core di elaborazione.

Per l'edge computing e le IA più piccole rispetto ai grandi LLM, l'elaborazione locale, magari basata su XPU all-in-one, sarà probabilmente utilizzata da scienziati, auto a guida autonoma e utenti preoccupati per la privacy o la censura, potenzialmente con modelli di IA open source.

Quel che è certo è che i profitti derivanti dalla vendita di “picconi e pale” di hardware di intelligenza artificiale nella corsa all’oro dell’intelligenza artificiale sono ben lungi dall’essere terminati.

Dopo un periodo di predominio di Nvidia, gli investitori potrebbero voler diversificare i rischi distribuendo il loro portafoglio di hardware IA ad altri progetti e magari anche alle aziende di servizi energetici che forniranno i preziosi gigawatt per gestire i sempre più grandi e numerosi data center di IA nel mondo.