Weltraum

Weltraum‑basierte KI: Die nächste Grenze für Cloud‑Skalierung

Warum KI‑Infrastruktur in den Orbit verlagert wird

Während die KI boomt, sind mehrere Lieferengpässe entstanden. Der erste waren GPUs, wobei spezialisierte Hardware von einer Nischen‑Gaming‑Anwendung zur Massenadoption in KI‑Rechenzentren überging. Infolgedessen ist Nvidia (NVDA ), der Branchenführer, zum größten Unternehmen der Welt geworden.

Aber eine weitere Einschränkung wird zum Hauptproblem: die Energieversorgung.

Das liegt daran, dass KI‑Rechenzentren jetzt nicht mehr so sehr an ihrer Rechenleistung gemessen werden, sondern an ihrem Stromverbrauch. Deshalb kämpfen KI‑Unternehmen darum, KI‑Unternehmen versuchen, Kernkraftwerke wieder in Betrieb zu nehmen, die ersten SMR‑Prototypen zu sichern, oder staatliche Regulierungsbehörden beschleunigen die Genehmigung neuer gasbefeuerter Kraftwerke.

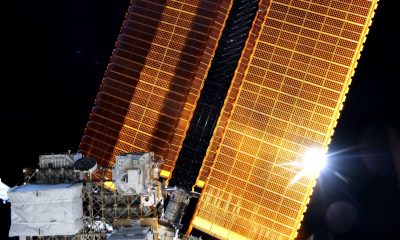

Während die Jagd nach Energie für Rechenzentren intensiver wird, richtet sich der Blick auf eine andere Option: weltraum‑basierte KI, die dem Begriff „Cloud‑Computing“ eine völlig neue physische Bedeutung verleiht.

Die Möglichkeit einer unbegrenzten Energieversorgung durch Satelliten im Orbit haben wir bereits ausführlich in „Space‑Based Energy Solutions For Endless Clean Energy“ analysiert.

Doch dieses Konzept ist stets etwas eingeschränkt durch die Notwendigkeit, Sonnenenergie in Strom umzuwandeln, diesen Strom in Mikrowellen zu verwandeln, um ihn zur Erde zurückzusenden, und anschließend wieder in Strom zu konvertieren.

Damit steigt die Komplexität der Strom‑Satelliten, es wird mehr bodenbasierte Infrastruktur benötigt, und insgesamt wird die Effizienz des Verfahrens stark reduziert, da jede Umwandlung in eine andere Energieform Verluste verursacht. Dies könnte wahrscheinlich nur bei sehr günstigen orbitalen Starts funktionieren.

Alternativ, wenn die Energie direkt im Orbit genutzt würde, wäre das deutlich effizienter und wirtschaftlich früher rentabel – besonders wenn das End‑„Produkt“ leicht zur Erde zurückgesendet werden kann.

Theoretisch könnten Rechenzentren im Weltraum die ideale Lösung sein: Sie benötigen viel Energie, aber das Zurücksenden der Berechnungsergebnisse zur Erde ist trivial, erfordert keine neue Infrastruktur und verursacht keine Energieverluste.

Die Idee ist nicht nur theoretisch; zum Beispiel hat Alphabet/Google gerade „Project Suncatcher“ angekündigt, einen Prototyp eines orbitalen KI‑Rechnersystems, den wir in „Google’s Project Suncatcher and the Rise of Orbital AI“ behandelt haben.

Könnte das also funktionieren, und warum könnte es der nächste Schritt beim Aufbau von KI‑Infrastruktur sein?

Die Kollision zweier Trends

Lösen des irdischen Energieengpasses

Mehr Energie denn je wird benötigt, um die menschliche Zivilisation zu betreiben, und die Kommerzialisierung von LLMs hat den Bedarf an neuen Energieanlagen weiter erhöht. Bisher stammt die meiste neu installierte Stromerzeugung aus Solarenergie.

Quelle: ARK Invest

Doch das stellt ein Problem für irdische Netze dar, da Solarenergie nur erzeugt, wenn die Sonne scheint, was zu geringerer Produktion an bewölkten Tagen, im Winter oder am Abend führt. Im Gegensatz dazu benötigen energieintensive Quellen wie KI‑Rechenzentren eine kontinuierliche Energieversorgung, wobei der Spitzenverbrauch häufig am Abend und im Winter auftritt.

Theoretisch kann dies mit günstigen Energiespeichern, wie großflächigen Batteriefeldern, gelöst werden. In der Praxis jedoch werden viele Vorteile von Solar als grüne und günstigere Energiequelle dadurch aufgehoben.

Quelle: ARK Invest

ARK Invest schätzt, dass die Investitionsausgaben für die Stromerzeugung bis 2030 etwa das Doppelte erreichen und rund 10 Billionen $ betragen müssen, um die globale Stromnachfrage zu decken. Davon muss der Ausbau stationärer Energiespeicher um das 19‑fache steigen.

Quelle: ARK Invest

Dies erfordert ebenfalls massive Investitionen in das Stromnetz, was die Kosten weiter erhöht. Jede Alternative, die Batterien und Netzkosten umgeht, könnte wettbewerbsfähig sein, selbst mit eigenen einzigartigen Infrastrukturkosten, wie dem orbitalen Start von weltraum‑basierten KI‑Rechenzentren.

Der deflationäre Zyklus von Starship

Es ist kein Geheimnis, dass SpaceX das erfolgreichste weltraum‑fokussierte Unternehmen aller Zeiten ist. Durch die Einführung zuverlässiger wiederverwendbarer Trägerraketen hat das Unternehmen die Kosten für das Heben nützlicher Nutzlasten in die Erdumlaufbahn drastisch gesenkt. Die Kosten sind in den 17 Jahren seit 2008 um etwa 95 % gesunken, von rund 15.600 $/kg auf unter 1.000 $/kg.

Der neue super‑schwere Träger, Starship, wird diesen Trend voraussichtlich fortsetzen und die Startkosten letztlich in den Bereich von etwa 100 $/kg bringen.

Quelle: ARK Invest

Was noch nicht vollständig verstanden wurde, ist, dass dies nicht nur Satelliten oder Weltraummissionen billiger macht; es verändert radikal, was im Weltraum möglich ist.

Wenn das Platzieren eines Kilogramms Material im Weltraum nur 100 $ kostet, wird das Senden von nützlichen oder leichten Gegenständen in die Umlaufbahn wirtschaftlich rentabel. Das gilt für Dünnschicht‑Solarzellen, die sehr leicht sein können, wenn sie nicht durch Glas oder starre Metallrahmen vor irdischem Wetter geschützt werden müssen.

Das gilt ebenfalls für Materialien, die pro Kilogramm sehr profitabel sind, wie etwa Computerchips.

Zum Beispiel kostet ein kompletter GB300 NVL72 Rack/Schrank von NVIDIA etwa 4 Mio. $, wiegt jedoch nur rund 1,8 t (4.000 lb). Die Kosten, ein solches Material mit 100 $/kg in die Umlaufbahn zu schicken, betragen nur 180.000 $, was im Vergleich zu den Hardware‑Kosten fast nur ein Rundungsfehler ist.

Natürlich wären die Gesamtkosten höher, wenn unterstützende Ausrüstung (Abschirmung, Kühlung, Stromerzeugung usw.) berücksichtigt wird, aber das bedeutet, dass das Platzieren eines KI‑Rechensystems im Orbit die Kosten nicht massiv erhöhen wird. Wahrscheinlich liegt der Wendepunkt bei etwa 500 $/kg Startkosten.

Quelle: ARK Invest

Als zusätzlicher Bonus könnte der Aufstieg orbitaler KI die Wirtschaftlichkeit wiederverwendbarer Raketen weiter verbessern, indem ein riesiger Markt zum Bedienen entsteht. Während das Abschließen der Starlink‑Konstellation möglicherweise das 11‑fache der kumulierten Nutzlast erfordert, die SpaceX bis 2025 gehoben hat, würde ein Rechenvolumen von 100 GW KI die Nachfrage nach orbitalen Starts um weitere 60‑fach erhöhen. Dieser Umfang würde wiederum die Startkosten weiter senken.

Quelle: ARK Invest

Warum orbitaler KI strukturelle Vorteile hat

Wischen zum Scrollen →

| Treiber | Terrestrische KI‑Rechenzentren | Orbitale KI‑Rechenzentren | Warum es wichtig ist |

|---|---|---|---|

| Stromverfügbarkeit | Durch Netzkapazität, Brennstoffversorgung und Genehmigungsfristen begrenzt | Nahe‑kontinuierliches Solarpotenzial in der richtigen Umlaufbahn; keine Netzanschluss | Orbitale Berechnung umgeht den langsamsten Teil der KI‑Skalierung: Strom + Genehmigungen |

| Kapazitätsfaktor | Solar ist intermittierend; zur Stabilisierung sind Speicher oder steuerbare Erzeugung nötig | Hohe Solarverfügbarkeit mit geringerer Intermittenz gegenüber bodengebundenem Solar | Reduziert oder eliminiert Investitionskosten für Speicher zur Stabilisierung |

| Kühlungsaufwand | Hohe HLK‑/Wärmeabfuhr‑Lasten; Wasserbeschränkungen in vielen Regionen | Strahlungs‑Kühlung über große Wärmestrahler; kein Wasserbedarf | Mehr Rechenleistung pro Watt bei geringer Kühlenergie (aber die Masse der Strahler ist relevant) |

| Latenz & Bandbreite | Ausgezeichnet für interaktive Workloads; Glasfasernetzwerke sind dicht | Am besten geeignet für Batch/HPC, Training oder asynchrone Inferenz; basiert auf Satellitenkommunikations‑Links | Orbitale KI wird wahrscheinlich mit latenzunempfindlichen Workloads beginnen |

| Einführungs‑geschwindigkeit | Land, Genehmigungen, Netzaufrüstungen und Bau dauern Jahre | Die Startfrequenz wird zum limitierenden Faktor, wenn standardisierte Plattformen existieren | Ein „Herstellung + Start“-Modell kann die Zeit bis zur Kapazität verkürzen |

| Harte Risiken | Genehmigungen, Netzüberlastung, lokale Wasser‑/Thermal‑Grenzen | Strahlung, Trümmer/Kollision, Wartung und Entsorgung am Lebensende | Die Wirtschaftlichkeit orbitaler Systeme hängt von der Minderung raumspezifischer Fehlermodi ab |

| Wirtschaftlicher Dreh‑ und Angelpunkt | Strom + Anbindung + Kühlungs‑CAPEX dominieren die Skalierung | Start + Plattformmasse + Betriebszeit im Orbit dominieren die Skalierung | Der Wendepunkt tritt ein, wenn $/kg und standardisierte Plattformen die Gesamtrechenleistung senken |

Perfekt für Solar

Solarenergie ist im Weltraum reichlich vorhanden – bis zu das Vierfache der Leistung bei gleicher Nennkapazität, dank direktem Sonnenlicht ohne atmosphärische Verluste. In der richtigen Umlaufbahn ist sie zudem viel zuverlässiger und scheint rund um die Uhr beständig.

Damit werden die Einschränkungen der bodengebundenen Solarenergie beseitigt. Theoretisch könnte dies die endgültige Form der Solarenergieerzeugung sein. Allerdings erfordert die Schwierigkeit, diese Energie zurück zur Erde zu bringen, ultra‑günstige Startkosten oder Fertigung im Orbit, um wirtschaftlich zu sein.

Alternativ könnten einfachere orbitale Spiegel, die auf irdische Solarfarmen scheinen, wie von Reflect Orbital gefördert, die Verluste der Licht‑zu‑Mikrowellen‑Umwandlung umgehen.

Im Gegensatz dazu, wenn die Energie im Orbit genutzt wird, sind keine dieser Schritte erforderlich. Sobald die Berechnung abgeschlossen ist, können die resultierenden Daten mit Standard‑Telekommunikationsmethoden zur Erde gesendet werden, wobei die Satellitenbandbreite schnell zunimmt.

Natürliche Kühlung

Ein weiterer einzigartiger Vorteil weltraum‑basierter KI‑Rechenzentren ist die Kühlung. Wenn sie nicht der Sonnenstrahlung ausgesetzt sind, ist der Weltraum extrem kalt und liegt bei -148 °F (-100 °C) für ein Raumfahrzeug im Erdschatten oder im Schatten seiner eigenen Paneele.

Ein erheblicher Teil des Energieverbrauchs von irdischen Rechenzentren stammt aus der Kühlung. Es wurde vorgeschlagen, sie in der Arktis oder sogar in der Stratosphäre zu platzieren, sodass der Weltraum einen natürlichen Vorteil bietet. Dies wird wahrscheinlich massive passive Kühlsysteme erfordern, um Wärme abzustrahlen, aber das ist technisch machbar.

Allgegenwärtige Satelliten‑Intelligenz

SpaceX und sein Breitband‑Satellitennetzwerk haben die orbitale Landschaft grundlegend verändert, wobei Starlink‑Satelliten etwa die Hälfte aller Satelliten im Orbit ausmachen.

Quelle: ARK Invest

Dies hat zu einem exponentiellen Rückgang der Satelliten‑Bandbreitenkosten geführt, die zwischen 2020 und 2024 fast um das 100‑fache gesunken sind, wobei weitere Verbesserungen durch Starship‑Flüge erwartet werden.

Quelle: ARK Invest

Telekommunikation im Weltraum wird so allgegenwärtig und billig, dass orbitale Rechenzentren vorhandene Netze nutzen können, um mit der Erde zu kommunizieren, ohne dedizierte Kapazitäten aufzubauen. Darüber hinaus könnte ein dichtes Satellitennetz zusätzliche Wartungsdienste ermöglichen, wie Betankung oder „Schlepp“, was die Lebensdauer dieser Anlagen verlängern würde.

Trennung von Weltraum‑ und Land‑Infrastrukturen

Da orbitale KI‑Rechenzentren nicht an das reguläre Netz angeschlossen sind, werden sie die Strompreise auf der Erde nicht beeinflussen. Im Gegenteil, die zusätzliche Nachfrage nach Solartechnologie wird dazu beitragen, Solarenergie weltweit günstiger zu machen.

Zudem müssen diese Zentren nicht auf irdische Netzaufrüstungen warten, die Jahre dauern können. Der Prozess vermeidet zudem die Nutzung von Land und wertvollen Wasserressourcen, was die Gesamteffizienz verbessert.

Investieren in orbitaler KI

Broadcom

(AVGO )

Neben GPU‑Herstellern und KI‑Modell‑Entwicklern sind Unternehmen, die Konnektivität und spezialisierte IT‑Ausrüstung für Rechenzentren produzieren, große Gewinner des KI‑Booms. Ein bedeutendes Unternehmen in dieser Kategorie ist Broadcom, ein Technologieriese mit Wurzeln aus der Dot‑Com‑Ära.

Nach der Fusion von Broadcom und Avago im Jahr 2016 sind die Aktivitäten des Unternehmens zwischen Infrastruktursoftware und Konnektivitätshardware (Wireless, Server, KI‑Netzwerke usw.) aufgeteilt.

Quelle: Broadcom

Eine weitere wachsende KI‑bezogene Aktivität ist das Design und die Fertigung von XPUs, die CPU, GPU und Speicher zu einem einzigen elektronischen Gerät verschmelzen. Broadcom nutzt seine Erfahrung in der Produktion von ASICs (Application‑Specific Integrated Circuits), um speziell für KI‑Rechnen konzipierte Chips zu erstellen.

Quelle: Broadcom

Diese Art von dichten, energieeffizienten Recheneinheiten passen perfekt zu orbitaler KI, die ein optimiertes Gleichgewicht zwischen Leistung und Gewicht erfordert. Die höhere Energieeffizienz von ASICs ist ebenfalls ein Vorteil, da ein geringerer Stromverbrauch die Masse der im Orbit benötigten Solarpaneele reduziert.

- Kernthese: Die bindende Beschränkung der KI verschiebt sich von der Rechenleistung hin zu Stromverfügbarkeit und Genehmigungsfristen; orbitale Berechnung ist ein potenzieller struktureller Umweg.

- Wirtschaftlicher Auslöser: Sinkende Startkosten in Richtung von ~ 500 $/kg erweitern das realisierbare Nutzlastmix (Solar, Strahler, Abschirmung) für rentable orbitalen Compute‑Einsatz deutlich.

- Frühe Gewinner: “Picks‑and‑shovels”‑Ermöglicher – ASIC/XPU‑Designer, Photonik/Co‑Packaged‑Optik und Thermomanagement – profitieren, bevor ein öffentliches reines orbital‑Cloud‑Angebot existiert.

- Wesentliche Risiken: Strahlungshärtung, Logistik für Wartung im Orbit und Trümmer‑/Kollisionsrisiken können die Wirtschaftlichkeit selbst bei fallenden Startpreisen untergraben.

- Zeithorizont: Betrachte orbitale KI als langfristiges Infrastrukture‑Thema; konzentriere dich auf Unternehmen, die heute die Skalierung irdischer KI monetarisieren und gleichzeitig Optionen für Weltraum‑Workloads schaffen.