Tekoäly

Investoiminen tekoälylaitteistoon: suorittimista XPU-prosessoreihin

Securities.io noudattaa tiukkoja toimituksellisia standardeja ja voi saada korvausta tarkistetuista linkeistä. Emme ole rekisteröity sijoitusneuvoja, eikä tämä ole sijoitusneuvontaa. Katso lisätietoja tytäryhtiöiden ilmoittaminen.

Tekoälylaitteistoon sijoittaminen: Poiminnat ja lapiot -lähestymistapa

Tekoälyn on lupaavasti odotettavissa olevan merkittävin muutos taloudessamme, tuotantojärjestelmissämme ja yhteiskunnassamme viime vuosikymmeninä, mikä saattaa tehdä jopa internetin mukanaan tuomista radikaaleista muutoksista mitättömiä verrattuna siihen.

Se saattaa katoaa kokonaisen työkategorian, mukaan lukien kuljettajat, kääntäjät, asiakastuki, web-suunnittelijat jne. Muiden työpaikkojen, kuten ohjelmoijien, aloittelevien juristien, diagnostiikkojen jne., kysyntä saattaa vähentyä radikaalisti.

Sen pitäisi myös luoda paljon lisäarvoa ja tuottavuutta moniin muihin tehtäviin, ja hallitsevat tekoälyohjelmistoyritykset ovat todennäköisesti ensimmäisiä, jotka saavuttavat aiemmin käsittämättömän markkina-arvon.

Kaikista näistä syistä pääomamarkkinat ja sijoittajat ovat lumoutuneet tekoälystä ja kiinnittävät paljon huomiota monien teknologiajättien edistymiseen tekoälyn parissa sekä kiinalaisten teknologiajättien, kuten Alibaba ja startupit kuten DeepSeek.

Toinen tapa hyödyntää tekoälybuumia on noudattaa strategiaa, jonka tiedetään toimivan jokaisessa kultaryntäyksessä: älä etsi kultaa, vaan myy hakkuja ja lapioita. Tämä on varmasti toiminut yrityksille, jotka sattuivat olemaan parhaassa asemassa myymään tekoälyoptimoitua laitteistoa, kuten Nvidia (NVDA ) muutettuaan peligrafiikkakorttinsa tekoälyharjoitussiruiksi, mikä teki siitä maailman arvokkaimman yrityksen ja ylitti hämmästyttävän 4 biljoonan dollarin markkina-arvon (Täydellinen raportti Nvidiasta löytyy linkistä).

Koska tekoäly vaatii hyvin erityistä laitteistoa, joka eroaa enimmäkseen aiemmista laskentatehtävistä, ja on valtava liiketoimintamahdollisuus, puolijohdeteollisuus on nyt kilpajuoksussa kehittääkseen uusia laitteistoja, jotka on suunniteltu erityisesti tekoälyohjelmien koulutukseen ja suorittamiseen.

Vaikka Nvidia todennäköisesti pysyy yhtenä alan parhaista yrityksistä, vaihtoehtoja on nyt syntymässä ja ne voivat tarjota mielenkiintoisia mahdollisuuksia sijoittajille, jotka kiinnittävät huomiota aikaisin.

Miksi tekoäly tarvitsee erikoislaitteistoa

Monta pientä laskelmaa

Alkuvaiheen tekoälyprojektit käyttivät samaa laskentakapasiteettia kuin muutkin ohjelmat, keskittyen pääasiassa prosessoreihin (CPU). Suorittimet ovat edelleen tärkeitä, mutta nopeasti kävi ilmi, etteivät ne ole optimaalisia useimmille tekoälyjen kehittämisessä nykyisille menetelmille.

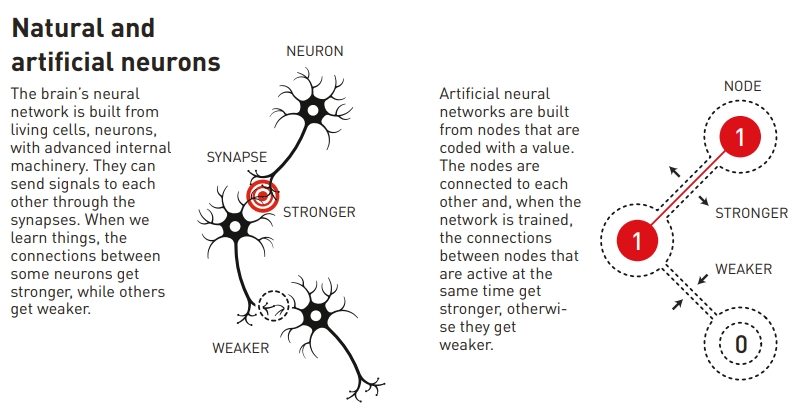

Neuroverkot ja muut vastaavat menetelmät vaativat paljon suhteellisen yksinkertaisia laskelmia yhden hyvin monimutkaisen laskennan sijaan. Useiden pienten sirujen rinnakkainen käyttö on yleensä parempi vaihtoehto kuin massiivisten ja tehokkaiden suorittimien käyttö.

Tämä on suurelta osin syy siihen, miksi GPU:t nousivat nopeasti suosioon, koska näytönohjaimet on luonnostaan suunniteltu suorittamaan tuhansia pienempiä laskelmia rinnakkain.

Nykypäivän tekoälykoulutus perustuu pitkälti neuroverkkoihin, käsite, joka voitti Nobelin fysiikanpalkinnon vuonna 2024, palkinnon, jota käsittelimme yksityiskohtaisesti tuolloin omassa artikkelissaan.

Lähde: Nobel palkinto

Toinen tekoälyteknologian vallankumous tuli "transformers"-teknologian myötä. Ne ratkaisevat perinteisten neuroverkkojen ongelmia. kyvyttömyys käsitellä tehokkaasti pitkiä datasarjoja, mikä on yleinen ominaisuus kaikille luonnollisille kielille.

Googlen tutkijoiden vuonna 2017 esittelemä teknologia on tekoälykapasiteetin nykyisen räjähdysmäisen kasvun perimmäinen syy. Transformers-teknologiat ovat tekoälytuotteiden, kuten LLM:ien (Large Language Model), kuten ChatGPT:n, ytimessä.

Eri vaatimukset

Yksi tärkeä ero tekoälyn työnkuluissa on ero hienosäätö ja päättely, joilla molemmilla on erilliset laitteistovaatimukset.

- Hienosäätö sisältää mallin kouluttamisen toimialakohtaisella datalla, mikä vaatii merkittävästi laskentatehoa ja muistia. Se on erittäin tekninen tehtävä, usein tekoälytieteen aallonharjalla.

- Päättely keskittyy jo koulutetun mallin käyttämiseen tulosteiden tuottamiseen, mikä vaatii vähemmän laskentatehoa, mutta painottaa enemmän pientä latenssia ja kustannustehokkuutta.

- Tämän tekevät rutiininomaisesti tekoälyasiantuntijat, jotka käyttävät olemassa olevia malleja tosielämän ongelmien ratkaisemiseen.

Vaikka kustannukset ovat ilmeisesti huolenaihe sekä tekoälyn hienosäädössä/koulutuksessa että päättelyssä/käytössä, koulutus vaatii usein parasta mahdollista laitteistoa, kun taas käyttötehtävissä keskitytään enemmän laitteistokustannuksiin ja energiankulutukseen parasta laitteistovaihtoehtoa valittaessa.

CPU:t vs. GPU:t

Keskusyksiköt (CPU:t):

CPU:t ovat yleiskäyttöisiä eivätkä erityisesti tekoälylaitteistoja. Ne ovat kuitenkin edelleen välttämättömiä käskyjen suorittamiseksi ja peruslaskennan suorittamiseksi tekoälyjärjestelmissä.

Suurin osa tekoälyjärjestelmän loppukäyttäjien rajapintaa käsittelevästä ohjelmistosta on myös prosessorikeskeistä, olipa kyseessä sitten yksittäiset tietokoneet tai pilvipohjaiset ohjelmistot.

Lähde: AnandTech

Suorittimia voidaan käyttää myös hyvin yksinkertaisiin tekoälyihin, joissa erillistä laitteistoa ei oikeastaan tarvita. Tämä pätee erityisesti silloin, kun tuloste ei ole erityisen kiireellinen, eikä suorittimien suhteellisen hitaampi tekoälyn prosessointi ole ongelma.

Pienet mallit, joissa on pieniä data- ja laskentaeriä, voivat toimia hyvin suorittimilla. Suorittimien läsnäolo tavallisissa tietokoneissa tekee siitä myös hyvän vaihtoehdon keskivertokäyttäjälle, joka ei ole halukas investoimaan tekoälyyn perustuvaan laitteistoon.

Suorittimet ovat myös erittäin luotettavia ja vakaita, mikä tekee niistä hyvän valinnan kriittisiin tehtäviin, joissa virheettömyys on tärkeä kriteeri.

Lopuksi, suorittimet ovat hyödyllisiä joissakin tekoälyn koulutuksen tehtävissä, yleensä yhteistyössä muuntyyppisten laitteistojen kanssa, kuten tiedon lataamisessa, muotoilussa, suodatuksessa ja visualisoinnissa.

Grafiikkaprosessointiyksiköt (GPU:t):

Alun perin grafiikan renderöintiä varten suunnitellut GPU:t on suunniteltu rinnakkaisprosessointiin, mikä tekee niistä ihanteellisia tekoälymallien kouluttamiseen, jotka vaativat suurten tietojoukkojen käsittelyä. Vaihtaminen suorittimista GPU:ihin on lyhentänyt koulutusaikaa viikoista tunneihin.

Koska näytönohjaimet olivat laajalti saatavilla ja IT-asiantuntijoilla oli paljon kokemusta niiden kanssa työskentelystä, ne olivat ensimmäinen sarjaan asennettava laskentalaitteisto tekoälytutkimuksen laajentamiseksi.

Lähde: Aorus

Myös Nvidian kehittämä CUDA, yleiskäyttöinen ohjelmointirajapinta NVIDIAn näytönohjaimille, avasi oven muillekin käyttötarkoituksille kuin pelaamiseen, oli merkittävä tekijä näytönohjainten menestyksessä. Tämä tehtiin, koska jotkut tutkijat käyttivät jo näytönohjaimia laskutoimitusten suorittamiseen tavallisten supertietokoneiden sijaan.

”Tutkijat ymmärsivät, että ostamalla tämän GeForce-nimisen pelikortin, lisäät sen tietokoneeseesi, sinulla on käytännössä henkilökohtainen supertietokone.”

Molekyylidynamiikka, seisminen prosessointi, tietokonetomografiarekonstruktio, kuvankäsittely – koko joukko erilaisia asioita.”

Nykyään näytönohjaimet ovat edelleen halutuimpia tekoälylaitteistoja, ja Nvidia onnistuu tuskin tuottamaan tarpeeksi tyydyttääkseen gigawattiluokan tekoälydatakeskuksia rakentavien teknologiajättien kysynnän.

Se on myös "super-GPU-aikakauden" alku, kun Nvidia julkaisi hiljattain GB200 NVL72.

Tämä laitteisto on suunniteltu toimimaan yhtenä massiivisena tehtaalta tulevana näytönohjaimena sen sijaan, että sen tarvitsisi verkottaa useita pieniä. Se tekee siitä paljon tehokkaamman kuin edes aiemmin ennätyksiä rikkonut H100-malli.

Lähde: Nvidia

Tämän pitäisi myös olla paljon energiatehokkaampaa, mikä on ratkaiseva seikka, sillä tekoälyteollisuudella saattaa olla energiapulaa ennen kuin sillä on pulaa siruista tekoälydatakeskusten rakentamisen vauhdissa. Ja enemmän laskentaa ja energiatehokkuutta tarkoittavat vähemmän hukkalämpöä, mikä ratkaisee väliaikaisesti myös ylikuumenemisongelman.

| Laitteiston tyyppi | Paras käyttökotelo | Nopeus | Energiatehokkuus | Joustavuus |

|---|---|---|---|---|

| prosessori | Yleiskäyttöiset tehtävät | Matala | Korkea | Erittäin korkea |

| GPU | Tekoälykoulutus ja rinnakkaistehtävät | Korkea | Keskikova | Keskikova |

| TPU | Tensorioperaatiot ja muuntajat | Erittäin korkea | Korkea | Matala |

| ASIC | Yksittäisen tehtävän kiihdytys | Erittäin korkea | Erittäin korkea | Erittäin matala |

| FPGA | Uudelleenkonfiguroitavat tekoälytyökuormat | Keskikova | Keskikova | Korkea |

ASIC-piirien ja tekoälylaitteiston nousu

Sovelluskohtaiset integroidut piirit (ASIC) ovat laskentalaitteistoja, jotka on suunniteltu erityisesti tiettyyn laskentatehtävään, mikä tekee niistä vieläkin erikoistuneempia kuin suhteellisen yleiset näytönohjaimet.

Joten ne ovat vähemmän joustavia ja ohjelmoitavia kuin yleiskäyttöiset laitteet.

Yleensä ne ovat monimutkaisempia. Ne ovat myös yleensä kalliimpia, sekä tuotannon mittakaavaetujen puutteen että räätälöityjen suunnittelujen kustannusten vuoksi.

Ne ovat kuitenkin paljon tehokkaampia annetussa tehtävässä ja yleensä tuottavat tulosteen nopeammin paljon vähemmällä laskentatehon ja energian hukkaamisella.

ASIC-piirien ja muiden tekoälyyn perustuvien laitteistojen käyttöaste kasvaa, koska alalla on yhä enemmän havaittavissa, että jotkin laskelmat eivät ihanteellisesti tapahdu grafiikkasuorittimilla, vaan ne vaativat erikoistuneempia laitteita.

Tensor Processing Units (TPU:t)

Google kehitti TPU-piirit (GOOGL ) erityisesti tensorilaskelmien suorittamiseen (liittyy muuntajapohjaiseen laskentaan). Ne on optimoitu suurta läpimenoa ja matalaa tarkkuutta vaativaan aritmetiikkaan.

Lähde: C#Corner

Tämä antaa TPU:ille korkean suorituskyvyn, tehokkuuden ja skaalautuvuuden suurten neuroverkkojen kouluttamiseen.

TPU-piireissä on erikoisominaisuuksia, kuten matriisikertolaskuyksikkö (MXU) ja patentoitu yhteenliitäntätopologia, jotka tekevät niistä ihanteellisia tekoälyn koulutuksen ja päättelyn nopeuttamiseen.

TPU-piirit pyörittävät Geminiä ja kaikkia Googlen tekoälypohjaisia sovelluksia, kuten Hakua, Kuvat ja Karttoja, ja palvelevat yli miljardia käyttäjää.

Tämän tyyppinen laitteisto voi merkittävästi nopeuttaa neuroverkkojen kehitystä ja toimintaa, joissa satunnainen virhe on vähemmän merkittävä, koska nämä mallit ovat lähtökohtaisesti erittäin riippuvaisia tilastoista ja suuresta määrästä laskelmia.

Loppukäyttäjien tehtävistä TPU:ille sopivimpia ovat syväoppiminen, puheentunnistus ja kuvien luokittelu.

Neuroverkkoprosessorit (NNP:t):

Myös neuroverkkolaskentaan erikoistuneet NPP:t, joita kutsutaan neuroverkoiksi ja jotka yhdistetään neuroprosessointiyksiköihin (NPU), on suunniteltu jäljittelemään ihmisaivojen hermoyhteyksiä. Niitä kutsutaan joskus myös tekoälykiihdyttimiksi, vaikka termi on vähemmän määritelty.

NPU integroi myös tallennuksen ja laskennan synaptisten painojen avulla. Näin se voi mukautua eli "oppia" ajan myötä, mikä johtaa parempaan toiminnan tehokkuuteen.

NPU sisältää erityisiä moduuleja kerto- ja yhteenlaskulle, aktivointifunktioille, 2D-dataoperaatioille ja pakkauksen purkamiselle.

Erikoistunutta kerto- ja yhteenlaskumoduulia käytetään neuroverkkosovellusten käsittelyyn liittyvien toimintojen suorittamiseen, kuten matriisien kerto- ja yhteenlaskujen, konvoluution, pistetulon ja muiden funktioiden laskemiseen.

Erikoistuminen voi auttaa NPU:ta suorittamaan operaation yhdellä laskutoimituksella useiden tuhansien sijaan, kun käytetään yleistä laitteistoa. Esimerkiksi IBM väittää, että NPU voi parantaa radikaalisti tekoälylaskennan tehokkuutta verrattuna GPU:ihin.

”Testaukset ovat osoittaneet joidenkin NPU-suorittimien suorituskyvyn olevan yli 100 kertaa parempi kuin vastaavan näytönohjaimen, samalla virrankulutuksella.”

Tämän energiatehokkuuden vuoksi NPU:t ovat suosittuja valmistajien keskuudessa asennettaviksi käyttäjien laitteisiin, missä ne voivat auttaa suorittamaan paikallisia tehtäviä generatiivisille tekoälysovelluksille, esimerkkinä "reunalaskennasta" (lisätietoja aiheesta alla).

Tällä hetkellä tutkitaan monia menetelmiä neuromorfisten sirujen luomiseksi:

- Hyödynnä alkavaa ferrosähköä, vielä huonosti ymmärretty ilmiö.

- Aktiivinen substraatti vanadiinilla tai titaanilla.

- Memristoreiden käyttö, uudentyyppinen elektroninen komponentti, joka voi suorittaa tekoälytehtäviä 1/800thnormaalista virrankulutuksesta.

Aapu Processing Uhölmö (XPU:t)

XPU yhdistää CPU:n (prosessorin), GPU:n (näytönohjaimen/rinnakkaisprosessorit) ja muistin samaksi elektroniseksi laitteeksi.

Lähde: Broadcom

XPU on laaja termi, joka kattaa monia muunnelmia tästä konseptista, jossa kaikki laitteisto tuodaan itsenäisiksi yksiköiksi, mukaan lukien Tietojenkäsittely-yksiköt (DPU:t), Infrastruktuurin käsittely-yksiköt (IPU)ja Toimintokiihdyttikortit (FAC).

XPU:iden nähdään ratkaisevan tekoälydatakeskusten kasvavan ongelman, joka on aliyksiköiden välisen yhteyden kasvava tarve. Siinä määrin dataviiveestä tulee merkittävä laskentatehoa hidastava tekijä, jopa enemmän kuin käytettävissä olevasta laskentatehosta.

Pohjimmiltaan sirut (GPU:t, TPU:t, NPP:t jne.) odottavat dataa yhtä paljon kuin ne itse asiassa työskentelevät.

Tämän teknologian johtaja on Broadcom. (AVGO ), Joka käsittelimme yksityiskohtaisesti erillisessä sijoitusraportissa.

Kenttäohjelmoitavat porttimatriisit (FPGA):

FPGA-piirit ovat ohjelmoitavia prosessoreita, mikä tekee niistä huomattavasti joustavampia ja uudelleenkonfiguroitavampia kuin jäykemmät ASIC-piirit. FPGA-piirejä voidaan räätälöidä tiettyjä tekoälyalgoritmeja varten, mikä voi tarjota parempaa suorituskykyä ja energiatehokkuutta.

Lähde: Mikrokontrollerilaboratoriot

Joustavuudella on hintansa, sillä FPGA:t ovat yleensä monimutkaisempia, kalliimpia ja kuluttavat enemmän sähköä. Ne voivat kuitenkin olla tehokkaampia kuin yleiskäyttöiset laitteistot.

Tämä tekee niistä jossain määrin niche-tuotteen, jossa niiden joustavuus kompensoi haittoja. Esimerkiksi koneoppiminen, konenäkö ja luonnollisen kielen käsittely voivat hyötyä FPGA-piirien monipuolisuudesta.

Suuren kaistanleveyden muisti (HBM):

Tärkeimmät räätälöityjen tekoälykeskeisten laitteistojen kehitysaskeleet ovat olleet laskentatehon alalla, joka on pitkään ollut keskeinen tekijä uusien tekoälyjen kouluttamiseen tarvittavan laskentakapasiteetin rakentamisessa.

Nämä järjestelmät tarvitsevat kuitenkin myös tehokkaita tukijärjestelmiä, joista muisti on tärkeä. HBM tarjoaa, kuten nimestä voi päätellä, suuremman kaistanleveyden kuin perinteinen DRAM.

Se saavutetaan pinoamalla useita DRAM-piirilevyjä pystysuunnassa ja yhdistämällä ne piiläpireikiin (TSV). Ensimmäinen HBM-sukupolvi kehitettiin vuonna 2013.

Pystysuuntainen pinoaminen säästää tilaa ja vähentää datan kuljettamiseen tarvittavaa fyysistä etäisyyttä, mikä nopeuttaa datan siirtoa, mikä on välttämätöntä tekoälylaskennassa.

HBM-muistien valmistus on monimutkaisempaa ja kalliimpaa kuin DRAM-muistien, mutta suorituskyky- ja energiatehokkuushyödyt usein oikeuttavat tekoälysovellusten korkeammat kustannukset.

Tekoälyinen datakeskuksen infrastruktuuri: Virta, jäähdytys ja liitettävyys

Muistin ja laskentatehon lisäksi myös tekoälydatakeskusten apujärjestelmät ovat tärkeitä. Ilman niitä data ei voi kiertää riittävän nopeasti, sirut ylikuumenevat tai käytettävissä oleva teho ei ole riittävä.

Tämä tarkoittaa, että esimerkiksi Broadcomin yhteyslaitteisto hyötyy suuresti tekoälypohjaisesta datakeskuksen rakentamisesta, samoin kuin erikoistuneet ratkaisut, kuten jäähdytyslaitetoimittajat, kuten Vertiv. (VRT ) tai Schneider Electric (SU.PA).

Myös virtalähteestä voi tulla ongelma, ja useat teknologiajätit yrittävät ratkaista ongelman panostamalla ydinvoimaan. Microsoftin ensimmäisellä siirrolla vuonna 2024, jota ovat seuranneet monet muut sen jälkeen.

Yhdessä teknologiayritysten sitoutumisen kanssa tekoälyn hiilijalanjäljen pienentämiseen tämän pitäisi hyödyttää merkittävästi ydin- tai uusiutuvan energian alan yrityksiä, kuten cameco (CCJ ), GE Vernova (GEV ), First Solar (FSLR ), SeuraavaEra (NEE )tai Brookfield Energy Partners (BEP ) (seuraa linkkejä nähdäksesi raportin kustakin yrityksestä).

Uudet tekoälyyn perustuvat laskentatekniikat

Quantum Computing

Koska tekoäly janoaa niin paljon laskentatehoa, on mahdollista, että alan laitteiston tulevaisuus ei olekaan nykyisten piipohjaisten ratkaisujen varassa.

Yksi mahdollisuus on, että kvanttilaskentaa voitaisiin käyttää kuvioiden havaitsemiseen paljon tehokkaammin kuin klassista laskentaa koskaan pystyisi, jotain, mitä tutkijat ovat jo tutkineet.

Kvanttilaskentaa kokonaisuudessaan voitaisiin käyttää tiettyjen laskutoimitusten ratkaisemiseen, jotka ovat lähes mahdottomia binäärilaskennalla. Tätä sovelletaan todennäköisesti lopulta tekoälyyn, mutta ensimmäiset kaupalliset kvanttitietokoneet ovat vielä muutaman vuoden päässä ja suuri kvanttiverkko vielä kauempana.

fotoniikka

Käyttämällä valoa elektronien sijaan tiedonsiirtoon fotoniikka voisi olla paljon nopeampaa kuin elektroniset laitteet.

Koska kvanttitietokoneet yleensä kuljettavat kvanttidataa lomittuneine fotoneineen, kvanttilaskennan ja fotoniikan välillä on myös paljon päällekkäisyyksiä, ja ensimmäinen kaksoiskvanttifotoninen siru on jo julkistettu.

Organoidit

Koska useimmat tekoälyt kopioivat tietokoneissa aivojen hermoverkkojen toimintaa, jotkut tutkijat miettivät, voisimmeko sen sijaan käyttää … oikeita aivosoluja.

Tämä on kiehtova ajatus, varsinkin kun jotkut tutkimukset saattavat viitata siihen, että aivot ovat itse asiassa orgaaninen kvanttitietokone.

Tämän tyyppistä "tietokonetta" kutsutaan organoideiksi, ja se koostuu pohjimmiltaan laboratoriossa tietokonesirulle kasvatetuista neuroneista. Neuronit sitten itseorganisoivat dendriittinsä ja yhteytensä vastauksena sirun aiheuttamaan ärsykkeeseen.

Tämä tekniikka on vielä uusi ja perustuu bio-3D-tulostus.

Muuta

Tutkimme muita vaihtoehtoja piitietokoneille julkaisussa ”Top 10 ei-pii-tietokoneyritystä”, kuten vanadiinidioksidi, grafeeni, redox-portti tai orgaaniset materiaalit.

Kukin lupaa olla joko paljon nopeampi tai paljon vähemmän energiaa kuluttava kuin klassinen piipohjainen laskenta. Ne ovat kuitenkin vielä suhteellisen uusia, eivätkä ne todennäköisesti mullista tekoälyn alaa kaupallisessa mittakaavassa, ainakaan seuraavien 5–10 vuoden aikana.

Pilvipohjainen tekoäly ja reunalaskennan tekoäly: esteettömyystrendit

Pilvitekijä

Koska tehokkaimmat tekoälyjärjestelmät ovat suurten teknologiayritysten valmistamia, ne ovat enimmäkseen käytettävissä pilven kautta. Sama pätee myös tekoälyyn erikoistuneen laitteiston käyttöön.

Tämän trendin johtaja on Coreweave (CRCW ), yritys, joka siirtyi pilvipalveluntarjoajasta kryptovaluuttojen louhintaan näytönohjainten avulla ja tarjoaa nykyään tekoälylaskentaa tarpeen mukaan.

Tämä teki CoreWeavesta tärkeän kumppanin nouseville tekoälyalan startup-yrityksille, jotka yrittävät kilpailla teknologiajättien, kuten Taivutus AI ja se on 1.3 miljardin dollarin GPU-klusteri, rahoitetaan uudella rahoituskierroksella.

"Kaksi kuukautta sitten yritystä ei ehkä ollut olemassa, ja nyt sillä voi olla 500 miljoonaa dollaria riskipääomarahoitusta."

Ja tärkeintä heille on varmistaa turvallinen pääsy laskentaan; he eivät voi lanseerata tuotettaan tai liiketoimintaansa ennen kuin heillä on se.”

Koska puhtaasti tekoälylaitteiston alalla toimiva toimija alkaa suhtautua varauksella omien näytönohjainten, telineprosessorien, sisarprosessorien jne. tuottamiseen ja asiakkaista kilpailijoiksi kehittymiseen liittyviin suuryrityksiin, on todennäköistä, että CoreWeaven kaltaiset yritykset saavat etuoikeuden Nvidian ja muiden uusimpiin laitteistojulkaisuihin.

Tämä liiketoimintamalli on todennäköisesti erityisen tärkeä tekoälyn koulutuksessa, joka on paljon vaativampaa laskentakapasiteetin suhteen kuin jo koulutettujen tekoälyjen käyttö.

Reunalaskenta ja tekoälytietokoneet

Toinen nopeasti kehittyvä esimerkki tekoälylaskennasta on tarve suorittaa tekoälyjärjestelmien laskenta paikan päällä mahdollisimman lähellä tosielämän tilanteita.

Tämä on välttämätöntä järjestelmille, jotka eivät välttämättä siedä tekoälystä irrottautumista, jos yhteys katkeaa tai jos pilviyhteyden viive on liian hidas.

Hyvä esimerkki ovat itseohjautuvat autot, joiden odotetaan ymmärtävän ympäristöään offline-tilassa.

Tämän tyyppistä laskentaa kutsutaan reunalaskennaksi, ja se hyötyy suuresti tehokkaammasta ja vähemmän virtaa kuluttavasta laitteistosta.

Se voi lisätä tekoälyn luotettavuutta, ja mallien tehostuessa, kuten DeepSeekin edistysaskel osoittaa, siitä voi tulla yleisempi tekoälyn käyttöönottomalli tulevaisuudessa.

Samasta syystä tekoälytietokoneet kuten Nvidian hiljattain julkaisema, saattaa pitkällä aikavälillä riittää useiden tekoälysovellusten suorittamiseen paikallisesti, mikä lisää yksityisyyttä ja turvallisuutta verrattuna aina pilvipohjaisiin tekoälyihin yhteydessä olemiseen.

Yhteenveto

Tekoälylaitteisto on jonkin aikaa ollut jossain määrin synonyymi GPU:ille, koska näytönohjaimet olivat paljon tehokkaampia tekoälyn kouluttamisessa kuin muuntyyppiset laitteet, kuten suorittimet. Tämä loi Nvidian ja monien sen varhaisten osakkeenomistajien omaisuuden.

Näytönohjaimet, erityisesti tekoälyyn keskittyvät "super-näytönohjaimet", tulevat todennäköisesti pysymään tärkeinä tekoälydatakeskusten rakentamisessa. Mutta niistä tulee vain yksi yhä monimutkaisempien ja erikoistuneempien järjestelmien komponenteista.

Muuntajaoperaatiot lähetetään TPU-prosessoreille, neuroverkoille NPP-prosessoreille ja toistuville tehtäville erillisille ASIC-piireille tai uudelleenkonfiguroiduille FPGA-piireille.

Samaan aikaan suuren kaistanleveyden muisti, edistyneet tietoliikenneliittimet ja erittäin tehokas jäähdytys pitävät kaikki laskentaytimen ympärillä olevat aputoiminnot käynnissä.

Reunalaskennassa ja massiivisia LLM-järjestelmiin verrattuna pienemmissä tekoälyissä tiedemiehet, itseohjautuvat autot ja yksityisyydestä tai sensuurista huolissaan olevat käyttäjät käyttävät todennäköisesti paikallista laskentaa, jota mahdollisesti tukevat all-in-one-XPU:t, mahdollisesti avoimen lähdekoodin tekoälymallien avulla.

Varmaa on, että tekoälylaitteiston "hakkujen ja lapioiden" myynnistä saadut voitot tekoälyn kultaryntäyksen aikana ovat kaikkea muuta kuin ohi.

Nvidian hallitseman kauden jälkeen sijoittajat saattavat haluta hajauttaa riskejä levittämällä AI-laitteistovalikoimaansa muihin suuntiin ja ehkä jopa sähköyhtiöihin, jotka tarjoavat arvokkaita gigawatteja yhä suurempien ja lukuisten tekoälydatakeskusten ylläpitämiseen maailmassa.