Computación

Centros de datos cuánticos estratosféricos: La próxima nube

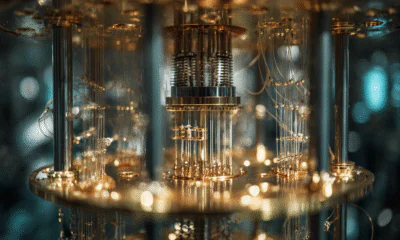

¿Qué pasaría si la “informática en la nube” se convirtiera en algo literal? Los científicos están explorando la posibilidad de desplegar computadoras avanzadas en la estratosfera para abordar uno de los problemas fundamentales de la computación cuántica.

Si se despliegan, esta forma única de resolver el problema puede ahorrar costos de enfriamiento y cambiar completamente la forma en que conocemos y pensamos en la “informática en la nube”.

TL;DR

-

-

Los computadores cuánticos requieren un enfriamiento extremo, y los sistemas criogénicos actuales hacen que los centros de datos cuánticos sean costosos, intensivos en energía y difíciles de escalar.

-

Los investigadores de KAUST proponen colocar procesadores cuánticos en plataformas de altitud alta (HAP), utilizando las temperaturas naturalmente frías de la estratosfera para reducir la demanda de enfriamiento hasta un 21%.

-

-

Estas plataformas aéreas dependerán de la energía solar, enlaces ópticos de espacio libre y globos de relevo para conectarse con centros de datos terrestres, mientras ofrecen capacidad de cálculo flexible y móvil.

-

La modelización temprana sugiere que el enfoque podría admitir más qubits con tasas de error más bajas, lo que apunta hacia un futuro en el que la computación cuántica y la informática en la nube convergen literalmente en las nubes.

El costo creciente de enfriar los centros de datos cuánticos

Los computadores cuánticos son un tipo de computadora que utiliza la mecánica cuántica para realizar cálculos complejos mucho más rápido que las computadoras clásicas.

A diferencia de las computadoras clásicas, que almacenan y procesan datos en bits (es decir, ceros o unos), los computadores cuánticos utilizan qubits que pueden existir en múltiples estados al mismo tiempo, un fenómeno llamado superposición, y también pueden estar vinculados entre sí, un fenómeno llamado entrelazamiento. Estas propiedades permiten que los computadores cuánticos exploren muchas posibilidades simultáneamente.

Con qubits como su unidad de datos fundamental, los computadores cuánticos pueden realizar cálculos paralelos avanzados y disfrutar de una capacidad de almacenamiento significativamente aumentada. Los qubits, sin embargo, son muy sensibles al ruido ambiental, como el calor, las vibraciones y la interferencia electromagnética.

Son simplemente muy frágiles y, como tal, se mantienen a temperaturas extremadamente bajas para prevenir errores causados por el ruido y garantizar el funcionamiento adecuado.

La mayoría de los sistemas cuánticos operan a temperaturas tan bajas como varios milikelvin hasta 10 K.

Entonces, mientras que los centros de datos cuánticos (QDC) tienen el potencial de completar una tarea dos veces más rápido que uno tradicional, consumen diez veces más energía debido al uso de sistemas de enfriamiento criogénico intensivos en energía.

Como resultado, hay una necesidad de examinar los aspectos termodinámicos de los QDC para reducir el consumo de energía de enfriamiento de estos centros de datos.

Algunas de las técnicas de enfriamiento principales utilizadas en centros de datos para chips cuánticos incluyen enfriamiento láser, refrigeración por dilución y refrigeración por tubo de pulso, con tecnologías avanzadas como el uso del efecto magnetocalórico (un fenómeno en el que los materiales magnéticos se calientan cuando se aplica un campo magnético y se enfrían cuando se elimina el campo) en supersólidos que también están ganando impulso.

Otra técnica implica sumergir circuitos cuánticos en el raro fluido criogénico helio-3, que se convierte en un superfluido a temperaturas extremadamente bajas y exhibe propiedades cuánticas únicas.

Sin embargo, lograr y mantener ambientes criogénicos para qubits requiere un costo y energía sustanciales, lo que plantea una barrera importante para la adopción y escalabilidad de la computación cuántica.

Esto requiere enfoques de ingeniería innovadores que puedan permitir la computación cuántica de alto rendimiento.

Un estudio de los investigadores de KAUST ha hecho justo eso al proponer el despliegue de procesadores cuánticos en plataformas de altitud alta (HAP) estratosféricas. Los procesadores se alojarán en dirigibles que vuelan a través de la estratosfera a una altitud de alrededor de 20 kilómetros (12,4 millas), donde la temperatura ambiental es de -50°C (alrededor de -58°F).

Al aprovechar estas condiciones frías naturalmente, los investigadores apuntan a reducir significativamente las demandas de enfriamiento de los QDC y permitir la computación cuántica sostenible y de alto rendimiento.

Convirtiendo dirigibles en centros de datos criogénicos alimentados por energía solar

La nueva propuesta de los investigadores de la Universidad de Ciencia y Tecnología King Abdullah de Arabia Saudita (KAUST), publicada en la revista npj Wireless Technology, detalla un marco novedoso para desplegar computadoras cuánticas en la estratosfera utilizando dirigibles o blimps.

También demuestra que su enfoque único para la computación cuántica verde y flexible en la atmósfera superior ofrece una mayor eficiencia energética. Además, el sistema funciona mejor computacionalmente que los centros de datos tradicionales en tierra.

“Al operar por encima de las nubes y los sistemas climáticos, el dirigible tiene acceso a una irradiación solar predecible e ininterrumpida.”

– Autor principal, Basem Shihada de KAUST

Para aprovechar las condiciones frías de la estratosfera, el equipo propone Plataformas de Altitud Alta Habilitadas para Computación Cuántica (QC-HAP). Estos dirigibles estratosféricos alojarán los dispositivos cuánticos dentro de criostatos para mantener la temperatura criogénica requerida.

Sí, los criostatos todavía son necesarios para mantener los estados cuánticos, pero a tal altitud, las temperaturas ambientales naturalmente bajas reducen drásticamente la energía necesaria para el enfriamiento criogénico.

Desplazar para desplazar →

| Parámetro | Centro de datos cuántico en tierra | Dirigible QC-HAP estratosférico |

|---|---|---|

| Temperatura ambiental | ~20–25 °C a nivel del suelo, requiere pilas criogénicas profundas | ≈ −50 °C a ~20 km de altitud, lo que facilita la carga criogénica |

| Demanda de energía de enfriamiento | Alta, dominada por refrigeradores de dilución y enfriadores de tubo de pulso | La modelización sugiere una demanda de enfriamiento un 21% más baja en comparación con los QDC en tierra |

| Fuente de energía principal | Electricidad de la red, a menudo de fuentes mixtas de fósiles y renovables | Energía solar de alta irradiación más baterías de litio-azufre para la noche |

| Capacidad de qubits y errores | Limitado por la potencia de enfriamiento y el ruido; tasas de error más altas a escala | Los modelos indican ~30% más qubits con tasas de error más bajas en algunas arquitecturas |

| Conectividad | Fibra y redes clásicas; enlaces cuánticos aún experimentales | Enlaces ópticos de espacio libre con respaldo RF y estaciones de relevo de globo para acceso de largo alcance |

| Flexibilidad de despliegue | Ubicaciones fijas, ciclos de construcción de varios años y gastos de capital | Flota móvil que puede cambiar la capacidad hacia puntos calientes de demanda o regiones remotas |

Además, los dirigibles estarán equipados con paneles solares para convertir la luz solar en energía eléctrica y baterías de litio-azufre para garantizar una operación suave durante la noche y en condiciones climáticas disruptivas.

Según el documento, los rayos cósmicos, partículas de alta energía producidas por el sol, tendrían un impacto negligible en la confiabilidad de los sistemas de computación cuántica estratosféricos, lo que confirma la viabilidad de la plataforma en la estratosfera.

Los QC-HAP en el cielo estarán vinculados a centros de datos cuánticos en tierra.

Para ello, los HAP enviarán información codificada en ondas de luz a través de enlaces ópticos de espacio libre (FSO). Para condiciones nubosas, los enlaces de radiofrecuencia servirán como respaldo.

Para prevenir la degradación de la señal y la decoherencia mientras los datos viajan a través de la atmósfera, el equipo sugiere utilizar plataformas intermedias, con globos a altitudes más bajas como estaciones de relevo.

Lo bueno de los QC-HAP es que se pueden mover dondequiera que se necesiten, ya sea en puntos calientes de demanda o en regiones remotas. Este despliegue flexible amplía la cobertura de la computación cuántica, alivia los cuellos de botella computacionales y reduce la latencia.

Además, se pueden vincular entre sí para aumentar la potencia de cálculo general, formando “una flota dinámica capaz de ofrecer servicios de cálculo cuántico escalables y bajo demanda en todo el mundo”, dijo el coautor del estudio, Wiem Abderrahim, quien actualmente es investigador en la Universidad de Cartago en Túnez.

Esta arquitectura de constelación de HAP múltiple escalable puede superar las limitaciones de energía individuales y mejorar las ventajas computacionales.

Según los cálculos de los investigadores, su solución alimentada por energía solar podría reducir la demanda de enfriamiento en un 21% en comparación con los centros de datos cuánticos equivalentes en tierra.

Los investigadores utilizaron este enfoque para dos formas principales de computación cuántica por su madurez, estabilidad, escalabilidad y tiempo de coherencia. La reducción en la demanda de enfriamiento varía con la arquitectura de qubits porque cada tipo opera en un rango de temperatura criogénica diferente.

Un enfoque utiliza qubits basados en iones atrapados enfriados a alrededor de 4 K (alrededor de -269°C). Este obtuvo los mayores beneficios del concepto de QC-HAP. El otro utiliza circuitos superconductores que funcionan a temperaturas entre 10 y 20 milikelvin.

Su análisis también muestra que estos HAP habilitados para cuántica admiten un 30% más de qubits que los QDC en tierra, mientras mantienen tasas de error más bajas, especialmente cuando se aprovechan las capacidades de hardware avanzadas.

Además de los qubits, los ahorros de energía logrados por el sistema cuántico estratosférico también dependen de la arquitectura del centro de datos, señaló el estudio.

Aunque poderoso, este concepto futurista está lejos de la implementación práctica, lo que requiere avances significativos en el hardware de computación cuántica, como sistemas robustos para identificar y corregir errores, particularmente durante la transmisión.

También hay las características únicas del entorno estratosférico, como las variaciones estacionales en la irradiación solar y las condiciones climáticas que afectan la energía solar cosechada, y a su vez afectan la eficiencia energética de la plataforma propuesta, que requieren una consideración cuidadosa.

El enfoque del estudio para la investigación futura debería centrarse en analizar cómo los factores ambientales afectan los sistemas cuánticos y en desarrollar diseños robustos para el despliegue en el mundo real de los QC-HAP.

“Nuestros próximos pasos son pasar de la etapa conceptual y analítica a estudios más enfocados en la implementación.”

– Coautor del estudio, Osama Amin

Mirando hacia adelante, los investigadores esperan que las soluciones aéreas cuánticas no reemplacen sino que coexistan junto con los centros de datos tradicionales en tierra en un marco de computación en la nube híbrido.

La carrera global para hacer que los computadores cuánticos sean una realidad

Mientras los investigadores exploran plataformas cuánticas basadas en el cielo, los principales actores de la industria continúan avanzando en el hardware necesario para la era cuántica que estas plataformas pueden llegar a respaldar. Por ejemplo, IBM (IBM ) está profundamente involucrada en computadoras cuánticas, con la esperanza de entregar Starling, un computador cuántico a gran escala tolerante a fallas, antes de que termine la década.

Recientemente, la compañía anunció el desarrollo de nuevas unidades de procesamiento cuántico (QPUs) que se espera que les ayuden a lograr la ventaja cuántica, así como un computador cuántico completamente tolerante a fallas.

Con 120 qubits, IBM Quantum Nighthawk es su primer procesador nuevo que puede procesar cálculos cuánticos más complejos en un 30% que el QPU anterior de IBM (R2 Heron). Cada uno de estos qubits puede conectarse con los cuatro vecinos más cercanos gracias a los acopladores sintonizables.

Este marco permitirá a los científicos explorar problemas que requieren 5,000 puertas de dos qubits, con IBM esperando que las versiones futuras de Nighthawk entreguen hasta 10,000 puertas para fines de 2027.

IBM Loon es el otro procesador más pequeño, que tiene 112 qubits y todos los elementos de hardware necesarios para la tolerancia a fallas completa para abordar la alta tasa de fallas en los qubits. Esto ayudará al equipo a aprender con anticipación a Kookaburra, otro procesador de concepto de prueba, que será el primer QPU de diseño modular para almacenar y procesar información codificada. Se espera que esté disponible el próximo año.

Además, IBM compartió que su nuevo formato de fabricación de unidades de procesamiento cuántico en un wafer de 300 mm (12 pulgadas) reduce a la mitad el tiempo necesario para construir cada una, mientras que aumenta la complejidad física de los chips en un 10x.

Mientras el hardware avanza, los plazos para la computación cuántica mainstream varían dramáticamente entre los líderes de la industria.

Los computadores cuánticos, según el ex CEO de Intel (INTC ), se volverán mainstream mucho más rápido, en unos dos años, y marcarán el final de las GPU. Mientras que Nvidia (NVDA ), un jugador dominante en el mercado de GPU, ha dicho que tomará dos décadas que la computación cuántica se vuelva mainstream.

“Estamos entrando en la década más emocionante para los tecnólogos”, dijo Gelsinger en una entrevista con el FT. También llamó a la computación cuántica la “santa trinidad” del mundo de la computación, junto con la computación clásica y la computación de IA.

Pero mientras Gelsinger también cree que un “avance cuántico” hará estallar la burbuja de IA, el CEO de Google, Sundar Pichai, lo ve como el próximo auge de IA en sí.

El CEO de la tercera empresa más grande del mundo por capitalización de mercado de $3.86 billones dijo en una entrevista reciente que la computación cuántica se acerca rápidamente a un momento de avance similar al que IA experimentó hace unos años.

“Diría que la computación cuántica está donde quizás IA estuvo hace cinco años. Así que creo que en cinco años a partir de ahora estaremos pasando por una fase muy emocionante en la computación cuántica”.

– Pichai

Y Google se está posicionando agresivamente para este cambio. Según Pichai:

“Tenemos los esfuerzos de computación cuántica de vanguardia en el mundo… construir sistemas cuánticos, creo que nos ayudará a simular y entender mejor la naturaleza y desbloquear muchos beneficios para la sociedad”.

Refuerzando esta trayectoria, hace apenas un mes, los investigadores de Google Quantum AI informaron sobre la implementación de un código de superficie utilizando tres circuitos dinámicos distintos.

Esto abre nuevas posibilidades para la aplicación en el mundo real de la bien conocida técnica de corrección de errores cuánticos (QEC) y también podría ayudar a desarrollar computadoras cuánticas más confiables.

La QEC es la forma de hacer que estas computadoras funcionen de manera confiable. También es esencial para construir computadoras cuánticas tolerantes a fallas, pero “implementar la QEC es un desafío significativo porque los circuitos de detección y corrección de errores son complejos y requieren operaciones extremadamente precisas”, dijo el coautor Matt McEwen.

El código de superficie en cuestión funciona organizando qubits en una cuadrícula 2D y luego verificando repetidamente los fallos.

Con anterioridad, McEwen trabajó en una propuesta teórica que demostró la factibilidad de implementaciones de código de superficie dinámico, en particular demostrando la viabilidad de tres implementaciones de circuitos dinámicos de superficie: hex, iSWAP y circuitos de caminata.

Basándose en eso, el equipo continuó trabajando en probar que funcionan en experimentos bajo condiciones del mundo real.

Al probar, encontraron que los circuitos iSWAP mejoraron la supresión de errores en 1,56 veces y el circuito de caminata en 1,69 veces, mientras que el circuito hex lo hizo en 2,15 veces.

“La mayor lección que se puede extraer de nuestro trabajo es confirmar que estas implementaciones de circuitos dinámicos funcionan en la realidad”.

– McEwen

Los avances en la estabilidad de los qubits también están acelerando. Los ingenieros de Princeton fueron capaces de extender la vida útil de los qubits en su investigación más reciente, que fue financiada en parte por Google Quantum AI.

Un gran paso hacia el desarrollo de computadoras cuánticas útiles, los ingenieros crearon un qubit superconductor que permaneció estable durante más de 1 milisegundo, lo que es tres veces más largo que las versiones más fuertes existentes.

“El verdadero desafío, la cosa que nos impide tener computadoras cuánticas útiles hoy en día, es que construyes un qubit y la información simplemente no dura mucho tiempo”, dijo el coautor Andrew Houck, quien es el decano de ingeniería de Princeton. “Este es el próximo gran salto adelante”.

Para confirmar su mejora de coherencia de qubit, los investigadores construyeron un chip cuántico funcional que utiliza la nueva arquitectura, que es similar a los sistemas desarrollados por Google y IBM (IBM ).

La opción de qubit transmon utilizada depende de circuitos superconductores que operan a temperaturas extremadamente frías y ofrecen una protección sólida contra el ruido ambiental. También funcionan bien con los procesos de fabricación actuales. Sin embargo, aumentar el tiempo de coherencia de estos qubits es extremadamente difícil.

Así que el equipo de Princeton rediseñó el qubit, utilizando el excepcionalmente robusto tantalio para prevenir la pérdida de energía y el silicio de alta calidad como sustrato. Esto no solo es más fácil de producir en masa, sino que también supera los diseños actuales.

Combinar estos dos, junto con la mejora de las técnicas de fabricación, llevó al equipo a lograr uno de los avances más significativos en la historia del transmon. Una computadora hipotética de 1.000 qubits puede funcionar aproximadamente un millón de veces mejor si el diseño actual mejor se reemplaza con el diseño de Princeton, debido a sus mejoras que escalan exponencialmente con el tamaño del sistema, dijo Houck.

Théau Peronnin, el CEO de Alice & Bob, una compañía que desarrolla un sistema de computación cuántica tolerante a fallas con Nvidia (NVDA ), recientemente dijo que aunque la tecnología cuántica aún no es lo suficientemente avanzada como para amenazar los sistemas criptográficos actuales, podría volverse lo suficientemente poderosa como para romperlos unos años después de 2030.

Esto plantea una amenaza no solo para Bitcoin (BTC ) y las criptomonedas, sino también para todo el cifrado bancario. Le dijo a Fortune en una entrevista:

“La promesa de la computación cuántica es una aceleración exponencial, pero si se amplía en una curva exponencial, es completamente plana, y luego es una pared vertical. Así que estamos justo al comienzo de la inflexión. Ahora, no es más poderoso que su smartphone en este momento. Pero déle un par de años, y será más poderoso que la computadora superordenadora más grande jamás construida”.

Las compañías, sin embargo, están trabajando en soluciones, mientras que los investigadores están expandiendo el alcance de las redes cuánticas. El mes pasado, los investigadores de la Escuela de Ingeniería Molecular de la Universidad de Chicago Pritzker (UChicago PME) aumentaron el alcance de las conexiones cuánticas de solo unos pocos kilómetros a 2.000 km.

“Por primera vez, la tecnología para construir una red cuántica a escala global está al alcance”.

– Profesor asistente Tian Zhong

En su estudio, el equipo aumentó el tiempo de coherencia de los átomos de erbio individuales de 0,1 milisegundos a más de 10 milisegundos, y en un caso, incluso alcanzaron 24 milisegundos.

La innovación aquí fue construir los cristales críticos para crear entrelazamiento cuántico de una manera diferente. Para ello, utilizaron la epitaxia de haz molecular (MBE), que es similar a la impresión 3D. “Comenzamos con nada y luego ensamblamos este dispositivo átomo por átomo”, agregó. “La calidad o pureza de este material es tan alta que las propiedades de coherencia cuántica de estos átomos se vuelven sobresalientes”.

Invertir en tecnología cuántica

IonQ, Inc. (IONQ ) es una compañía de tecnología cuántica de juego puro que está construyendo y comercializando computadoras cuánticas con un enfoque en qubits de iones atrapados. La compañía ofrece hardware cuántico a través de plataformas de nube principales. Hacer que la computación cuántica sea más accesible y posicionándola bien para la adopción comercial a medida que la computación cuántica se mueve hacia el uso en el mundo real.

El desempeño de las acciones de IonQ refleja esto, con sus acciones que actualmente cotizan a $48,10, bajando un 21% en el último mes pero subiendo más del 18% en lo que va del año y un 67,56% en los últimos tres años. Tiene un EPS (TTM) de -5,35 y un P/E (TTM) de -9,21.

(IONQ )

En cuanto a la fuerza financiera de la compañía, informó un ingreso de $39,9 millones para el tercer trimestre de 2025, un aumento del 222% interanual. Su pérdida neta fue de $1.100 millones, mientras que el EPS de GAAP fue ($3,58) y el EPS ajustado fue ($0,17).

IonQ tenía $1.500 millones en efectivo, equivalentes de efectivo y inversiones al final del trimestre.

“Entregamos nuestro hito técnico de 2025 de #AQ 64 tres meses antes, desbloqueando 36 cuatrillones de veces más espacio computacional que los sistemas superconductores comerciales líderes. Logramos un hito verdaderamente histórico al demostrar un rendimiento de puerta de dos qubits del 99,99%, subrayando nuestro camino hacia 2 millones de qubits y 80.000 qubits lógicos en 2030”.

– CEO Niccolo de Masi

Durante este trimestre, IonQ también completó la adquisición de Oxford Ionics y Vector Atomic, y fue galardonada con un nuevo contrato con el Laboratorio Nacional Oak Ridge para desarrollar flujos de trabajo cuántico-clásico acelerados y aplicaciones de energía avanzadas.

Haga clic aquí para obtener una lista de las cinco principales compañías de computación cuántica.

Últimas noticias de acciones de IonQ, Inc. (IONQ)

Conclusión de los inversores

-

La computación cuántica ha alcanzado un punto de inflexión. Las barreras reales ya no son sobre si la física funciona; son más sobre si podemos construir estas máquinas a escala. Cualquier avance que haga que los qubits sean más fáciles de enfriar o más estables nos acerca a un sistema que la gente realmente usará y pagará. De hecho, incluso ideas salvajes como lanzar computadoras cuánticas a la estratosfera comienzan a tener sentido si resuelven problemas de ingeniería reales.

-

Para los inversores que desean exposición sin elegir solo una compañía, la jugada inteligente sería centrarse en aquellas que están construyendo los cimientos. IBM ha estado en este espacio el tiempo suficiente como para tener conocimientos reales sobre el lado del hardware de las operaciones. IonQ, por otro lado, se está moviendo rápidamente con la tecnología de iones atrapados. Aunque Nvidia no está construyendo qubits por ahora, las computadoras cuánticas necesitan sistemas de control serios y potencia de cálculo alrededor de ellas, y esto es exactamente lo que Nvidia hace mejor.

-

En caso de que esté rastreando hacia dónde se dirige esto, tenga en cuenta algunos signos: qubits que permanecen estables durante más tiempo, una primera prueba de que la corrección de errores puede escalarse, pruebas exitosas de entrelazamiento a distancia y el surgimiento de configuraciones híbridas que combinan procesadores cuánticos con infraestructura de computación tradicional.

Conclusión: Cuando “la nube” se vuelve cuántica

La computación cuántica está evolucionando rápidamente desde una mera curiosidad de laboratorio hasta una carrera tecnológica global, donde gigantes de la industria como IBM, Google y Nvidia están empujando las capacidades del hardware a niveles sin precedentes. Mientras tanto, los avances en la coherencia de los qubits, la corrección de errores cuánticos y el entrelazamiento a distancia están resolviendo constantemente los desafíos de larga data del campo.

En medio de esto, la propuesta de KAUST está trabajando para hacer que la “informática en la nube” sea una realidad tangible, impulsada por temperaturas criogénicas naturales y luz solar perpetua.

Estos avances muestran que nos estamos acercando a un punto de inflexión histórico. Dentro de la próxima década, es una posibilidad muy real que la computación cuántica finalmente pase de la teoría a la practicidad, lo que reformará el cifrado, la ciencia y, eventualmente, tal vez incluso el significado de “la nube” en sí.

Haga clic aquí para obtener una lista de las principales acciones de computación en la nube.

Referencias

1. Abderrahim W., Amin O., & Shihada B. Green quantum computing in the sky. npj Wireless Technology 1, Article 5 (2025). https://doi.org/10.1038/s44459-025-00005-y

2. A. Eickbusch, M. McEwen, V. Sivak, A. Bourassa, J. Atalaya, J. Claes, D. Kafri, C. Gidney, C. Warren, J. Gross, A. Opremcak, N. Zobrist, K. C. Miao, G. Roberts, K. J. Satzinger, A. Bengtsson, M. Neeley, W. P. Livingston, A. Greene, R. Acharya, L. Aghababaie Beni, G. Aigeldinger, R. Alcaraz, T. I. Andersen, M. Ansmann, F. Arute, …, A. Morvan et al. Demonstration of dynamic surface codes. Nature Physics, 2025, Article published 17 October 2025. https://doi.org/10.1038/s41567-025-03070-w

3. Gupta, S., Huang, Y., Liu, S., Pei, Y., Gao, Q., Yang, S., Tomm, N., Warburton, R. J., & Zhong, T. (2025). Dual epitaxial telecom spin-photon interfaces with long-lived coherence. Nature Communications, 16, 9814. https://doi.org/10.1038/s41467-025-64780-6