Kunstig intelligens

Investering i AI-hardware: Fra CPU'er til XPU'er

Securities.io opretholder strenge redaktionelle standarder og kan modtage kompensation fra gennemgåede links. Vi er ikke en registreret investeringsrådgiver, og dette er ikke investeringsrådgivning. Se venligst vores tilknyttet videregivelse.

Investering i AI-hardware: En strategi med hakker og skovle

AI lover at blive den vigtigste forandring i vores økonomi, produktive systemer og samfund i de seneste årtier, og potentielt kan selv de radikale ændringer, som internettet har medført, blive trivielle i sammenligning.

Det kan få en hel jobkategori til at forsvinde, herunder chauffører, oversættere, kundesupport, webdesignere osv. Andre job kan opleve en radikal reduktion i efterspørgslen, såsom programmører, advokater på begynderniveau, diagnostikere osv.

Det burde også skabe en masse ekstra værdi og produktivitet for mange andre opgaver, hvor de dominerende AI-softwarevirksomheder sandsynligvis er de første til at nå en markedsværdi, der tidligere var utænkelig.

Af alle disse grunde er kapitalmarkeder og investorer blevet fascineret af AI og følger meget af de mange tech-giganters fremskridt inden for AI, såvel som den stærke konkurrence fra kinesiske tech-giganter som Alibaba og startups som DeepSeek.

En anden måde at udnytte AI-boomet på er at følge den strategi, der vides at virke i ethvert guldfeber: led ikke efter guld, men sælg hakker og skovle. Dette har helt sikkert virket for de virksomheder, der tilfældigvis var i den bedste position til at sælge AI-optimeret hardware, med Nvidia (NVDA -2.17%) efter at have forvandlet sine gaming-grafikkort til AI-træningschips, hvilket gør det til verdens mest værdifulde virksomhed, efter at have passeret den forbløffende markedsværdi på 4 billioner dollars (Følg linket for en fuld rapport om Nvidia).

Fordi AI kræver meget specifik hardware, der for det meste adskiller sig fra andre tidligere former for computeropgaver, og er en så massiv forretningsmulighed, er halvlederindustrien nu i et kapløb om at udvikle nye former for hardware, der er specielt designet til træning og kørsel af AI-programmer.

Selvom Nvidia sandsynligvis vil forblive en af de største virksomheder i sektoren, dukker der nu alternativer op, som kan give interessante muligheder for investorer, der er opmærksomme tidligt.

Hvorfor AI har brug for specialiseret hardware

Mange små beregninger

De første bestræbelser inden for AI brugte den samme computerkapacitet som andre programmer, med hovedsageligt fokus på processorer (Central Processing Unit – CPU'er). CPU'er er stadig vigtige, men det viste sig hurtigt, at de ikke er optimale for de fleste af de metoder, der i øjeblikket anvendes til at udvikle AI'er.

Neurale netværk og andre lignende metoder kræver mange relativt simple beregninger i stedet for én meget kompleks beregning. Så mange mindre chips, der arbejder parallelt, er generelt bedre end på massive og kraftfulde CPU'er.

Dette er i høj grad grunden til, at GPU'er hurtigt blev mere populære, da grafikkort i sagens natur er designet til at udføre tusindvis af mindre beregninger parallelt.

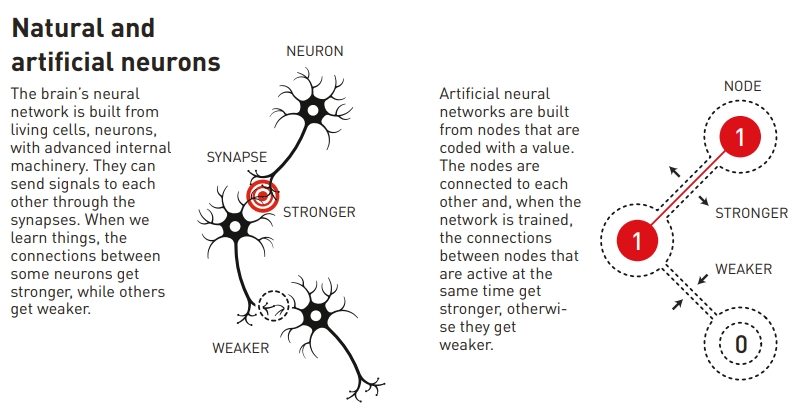

Dagens AI-træning er i høj grad baseret på neurale netværk, et koncept, der vandt Nobelprisen i fysik i 2024, en belønning vi dækkede i detaljer i en dedikeret artikel dengang..

Kilde: Nobelprisen

En anden revolution inden for AI-teknologi kom med "transformere". De løser traditionelle neurale netværks problemer. manglende evne til effektivt at behandle lange datasekvenser, et fælles træk ved ethvert naturligt sprog.

Det blev først introduceret i 2017 af Google-forskere og er roden til den nuværende eksplosion i AI-kapacitet. Transformere er kernen i AI-produkter som LLM'er (store sprogmodeller), herunder ChatGPT.

Forskellige krav

En vigtig forskel i AI-arbejdsgange er forskellen mellem finjustering og inferens, som begge har forskellige hardwarekrav.

- Finjustering involverer træning af en model på domænespecifikke data, hvilket kræver betydelig computerkraft og hukommelse. Det er en meget teknisk opgave, ofte på kanten af AI-videnskab.

- Inferens fokuserer på at bruge en allerede trænet model til at generere output, hvilket kræver mindre computerkraft, men et højere fokus på lav latenstid og omkostningseffektivitet.

- Dette gøres mere rutinemæssigt af AI-eksperter, der anvender allerede eksisterende modeller til at løse problemer i det virkelige liv.

Så selvom omkostninger naturligvis er en bekymring for både finjustering/træning og inferens/brug af AI, vil træning ofte kræve den bedst mulige hardware, mens brugsopgaver vil fokusere mere på omkostningerne ved hardware og energiforbrug, når den bedste hardwaremulighed skal vælges.

CPU'er vs. GPU'er

Centrale processorer (CPU'er):

CPU'er er universelle og ikke specifikt AI-hardware. De er dog stadig essentielle for at udføre instruktioner og grundlæggende beregninger i AI-systemer.

Det meste af den software, der håndterer grænsefladen med slutbrugerne af et AI-system, vil også være CPU-centrisk, hvad enten det er individuelle computere eller cloudbaseret software.

Kilde: AnandTech

CPU'er kan også bruges til meget simple AI'er, hvor dedikeret hardware ikke rigtig er påkrævet. Dette gælder især, når outputtet ikke er særlig presserende, og CPU'ernes relativt langsommere AI-behandling ikke er et problem.

Så små modeller med små data- og beregningsbatcher kan fungere godt på CPU'er. Den allestedsnærværende tilstedeværelse af CPU'er i almindelige computere gør det også til en god mulighed for en gennemsnitlig bruger, der ikke er villig til at investere i AI-specifik hardware.

CPU'er er også meget pålidelige og stabile, hvilket gør dem til et godt valg til kritiske opgaver, hvor ingen fejl er et vigtigt kriterium.

Endelig er CPU'er nyttige til nogle af opgaverne i AI-træning, generelt i samarbejde med andre typer hardware, såsom dataindlæsning, formatering, filtrering og visualisering.

Grafikprocessorer (GPU'er):

GPU'er, der oprindeligt var designet til grafikgengivelse, er designet til parallel behandling, hvilket gør dem ideelle til træning af AI-modeller, der kræver håndtering af store datasæt. Skiftet fra CPU'er til GPU'er har reduceret træningstiderne fra uger til timer.

På grund af deres udbredte tilgængelighed og IT-specialisters erfaring med at arbejde med dem, var GPU'er den første type computerhardware, der blev installeret i serie for at opskalere AI-forskning.

Kilde: Aorus

Nvidias udvikling af CUDA, en generel programmeringsgrænseflade til NVIDIAs GPU'er, var også afgørende for GPU'ernes succes, hvilket åbnede døren for andre anvendelser end spil. Dette blev gjort, fordi nogle forskere allerede brugte GPU'er til at udføre beregninger i stedet for de sædvanlige supercomputere.

"Forskerne indså, at ved at købe dette gamingkort kaldet GeForce, tilføjer du det til din computer, du har i bund og grund en personlig supercomputer."

Molekylær dynamik, seismisk behandling, CT-rekonstruktion, billedbehandling – en hel masse forskellige ting.”

I dag er GPU'er stadig blandt de mest eftertragtede typer AI-hardware, hvor Nvidia knap nok formår at producere nok til at tilfredsstille efterspørgslen fra tech-giganter, der bygger AI-datacentre i gigawatt-skala.

Det er også begyndelsen på "super-GPU-æraen" med Nvidias nylige udgivelse af GB200 NVL72.

Denne hardware er designet til at fungere som en enkelt massiv GPU direkte fra fabrikken, i stedet for at skulle netværke mange små. Det gør den meget mere kraftfuld end selv den tidligere rekordbrydende H100-model.

Kilde: Nvidia

Dette burde også være langt mere energieffektivt, et afgørende punkt, da AI-industrien måske kommer til at mangle energi før de kommer til at mangle chips med den hastighed, hvormed AI-datacentre bygges. Og mere databehandling og energieffektivitet betyder mindre spildvarme, hvilket midlertidigt også løser problemet med overophedning.

| Hardware type | Bedste brugssag | Speed | Energieffektivitet | Fleksibilitet |

|---|---|---|---|---|

| CPU | Generelle opgaver | Lav | Høj | Meget Høj |

| GPU | AI-træning og parallelle opgaver | Høj | Medium | Medium |

| TPU | Tensoroperationer og transformere | Meget Høj | Høj | Lav |

| ASIC | Acceleration af enkeltopgaver | Meget Høj | Meget Høj | Meget lav |

| FPGA | Omkonfigurerbare AI-arbejdsbelastninger | Medium | Medium | Høj |

Fremkomsten af ASIC'er og AI-hardware

Applikationsspecifikke integrerede kredsløb (ASIC'er) er computerhardware designet specifikt til en given computeropgave, hvilket gør dem endnu mere specialiserede end stadig relativt generelle GPU'er.

Så de er mindre fleksible og programmerbare end hardware til generel brug.

Som regel er de mere komplekse. De er også generelt dyrere, både på grund af manglende stordriftsfordele i deres produktion og omkostningerne ved specialdesignede løsninger.

De er dog meget mere effektive til deres givne opgave og producerer normalt et output hurtigere med meget mindre spildt computerkraft og energi.

ASIC'er og anden AI-specifik hardware bliver mere og mere anvendt, da feltet i stigende grad bemærker, at nogle beregninger ikke ideelt set udføres på GPU'er, men kræver mere specialiseret udstyr.

Tensor Processing Units (TPU'er)

TPU'er blev udviklet af Google (GOOGL -2.34%) specifikt til udførelse af tensorberegninger (forbundet med transformerbaseret kalkulus). De er optimeret til aritmetik med høj kapacitet og lav præcision.

Kilde: C# Corner

Dette giver TPU'er høj ydeevne, effektivitet og skalerbarhed til træning af store neurale netværk.

TPU'er besidder specialiserede funktioner, såsom matrixmultiplikationsenheden (MXU) og proprietær sammenkoblingstopologi, der gør dem ideelle til at accelerere AI-træning og inferens.

TPU'er driver Gemini og alle Googles AI-drevne applikationer som Søgning, Fotos og Kort, der betjener over 1 milliard brugere.

Denne hardwaretype kan fremskynde udviklingen og funktionen af neurale netværk betydeligt, hvor lejlighedsvise fejl er mindre signifikante, da disse modeller er meget afhængige af statistik og et stort antal beregninger til at begynde med.

Blandt de slutbrugeropgaver, der er bedst egnede til TPU'er, er deep learning, talegenkendelse og billedklassificering.

Neurale netværksprocessorer (NNP'er):

NPP'er, der også er forbundet med neurale processorer (NPU'er) og kaldes neuromorfiske chips, er specialiserede i beregning af neurale netværk, designet til at efterligne de neurale forbindelser i den menneskelige hjerne. De kaldes også undertiden en AI-accelerator, selvom dette udtryk er mindre veldefineret.

En NPU integrerer også lagring og beregning gennem synaptiske vægte. Så den kan justere eller "lære" over tid, hvilket fører til forbedret driftseffektivitet.

En NPU indeholder specifikke moduler til multiplikation og addition, aktiveringsfunktioner, 2D-dataoperationer og dekompression.

Det specialiserede multiplikations- og additionsmodul bruges til at udføre operationer, der er relevante for behandling af neurale netværksapplikationer, såsom beregning af matrixmultiplikation og -addition, konvolution, punktprodukt og andre funktioner.

Specialiseringen kan hjælpe en NPU med at fuldføre en operation med blot én beregning i stedet for flere tusinde med generel hardware. For eksempel, IBM hævder, at NPU'er radikalt kan forbedre effektiviteten af AI-beregninger sammenlignet med GPU'er.

"Test har vist, at nogle NPU'er yder mere end 100 gange bedre end en sammenlignelig GPU med samme strømforbrug."

På grund af denne energieffektivitet er NPU'er populære blandt producenter til installation i brugerenheder, hvor de kan hjælpe med at udføre lokale opgaver for generative AI-apps, et eksempel på "edge computing". (se nedenfor for mere om dette emne).

Mange metoder bliver i øjeblikket undersøgt i, hvordan man kan skabe neuromorfe chips:

- Udnyt begyndende ferroelektricitet, et stadig dårligt forstået fænomen.

- Aktivt substrat ved hjælp af vanadium eller titanium.

- Brug af memristorer, en ny type elektronisk komponent, som kan udføre AI-opgaver ved 1/800thaf det normale strømforbrug.

Ahjælpende Processing Unit (XPU'er)

En XPU samler CPU (processor), GPU (grafikkort/parallelle processorer) og hukommelse i den samme elektroniske enhed.

Kilde: Broadcom

XPU'er er et bredt begreb, der omfatter mange variationer af dette koncept med at samle al hardware i selvstændige enheder, herunder Databehandlingsenheder (DPU'er), Infrastrukturbehandlingsenheder (IPU'er)og Funktionsacceleratorkort (FAC'er).

XPU'er ses som en løsning på et voksende problem for AI-datacentre, nemlig det voksende behov for forbindelse mellem underenhederne, i en sådan grad, at dataforsinkelser bliver en vigtig faktor for at bremse databehandlingen, mere end den tilgængelige computerkraft.

I bund og grund venter chipsene (GPU'er, TPU'er, NPP'er osv.) lige så meget på dataene, som de rent faktisk arbejder.

En førende inden for denne teknologi er Broadcom (AVGO -2.82%), Hvilket vi diskuterede det i detaljer i en dedikeret investeringsrapport.

Feltprogrammerbare gate arrays (FPGA'er):

FPGA'er er programmerbare processorer, hvilket gør dem betydeligt mere fleksible og rekonfigurerbare end de mere rigide ASIC'er. FPGA'er kan tilpasses til specifikke AI-algoritmer, hvilket potentielt kan tilbyde højere ydeevne og energieffektivitet.

Kilde: Mikrocontrollere Labs

Fleksibiliteten kommer med en pris, da FPGA'er generelt er mere komplekse, dyre og bruger mere strøm. De kan dog stadig være mere effektive end generel hardware.

Dette gør dem til et nicheprodukt, hvor deres fleksibilitet kompenserer for ulemperne. For eksempel kan maskinlæring, computervision og naturlig sprogbehandling drage fordel af FPGA'ers alsidighed.

Hukommelse med høj båndbredde (HBM):

De vigtigste udviklinger inden for brugerdefineret AI-centreret hardware har været inden for computerkraft, som i lang tid har været dilemmaet med at opbygge mere computerkapacitet til at træne nye AI'er.

Disse systemer har dog også brug for højeffektive supportsystemer, hvoraf hukommelse er en vigtig del. HBM giver, som navnet antyder, højere båndbredde end traditionel DRAM.

Det opnås ved at stable flere DRAM-chips lodret og forbinde dem med through-silicium vias (TSV'er). Den første generation af HBM blev udviklet i 2013.

Den lodrette stabling sparer plads og reducerer den fysiske afstand, dataene skal tilbagelægge, hvilket fremskynder dataoverførslen, et must inden for AI-computing.

HBM'er er mere komplekse at fremstille og dyrere end DRAM, men fordelene ved ydeevne og energieffektivitet retfærdiggør ofte de højere omkostninger for AI-applikationer.

AI-datacenterinfrastruktur: Strøm, køling og tilslutning

Udover hukommelse og computerkraft er hjælpesystemerne i AI-datacentre også vigtige. Uden dem kan dataene ikke cirkulere hurtigt nok, chipsene ville blive overophedede, eller den tilgængelige strøm ville være utilstrækkelig.

Det betyder, at for eksempel Broadcom-forbindelseshardware også drager stor fordel af opbygningen af AI-datacentre, ligesom specialiserede løsninger som leverandører af køleudstyr, for eksempel Vertiv, også gør. (VRT -0.53%) eller Schneider Electric (SU.PA).

Strømforsyning kan også blive et problem, og flere tech-giganter forsøger at løse problemet ved at satse på atomenergi. med Microsofts første træk i 2024, efterfulgt af mange andre siden.

Kombineret med en forpligtelse til at reducere AI's CO2-aftryk fra teknologivirksomheder, bør dette være til stor gavn for virksomheder inden for atomkraft eller vedvarende energisektoren, som f.eks. Cameco (CCJ -0.72%), GE Vernova (GEV -2.29%), Første Solar (FSLR + 2.4%), Næste æra (NEE + 0.26%) eller Brookfield Energy Partners (BEP + 1.02%) (følg linkene for en rapport om hver virksomhed).

Nye AI-computerteknologier

Quantum Computing

Fordi AI er så sulten efter computerkraft, er det muligt, at fremtiden for feltets hardware ikke engang ligger i de i øjeblikket tilgængelige siliciumløsninger.

En mulighed er, at kvantecomputere kan bruges til at detektere mønstre langt mere effektivt end klassisk databehandling nogensinde kunne. noget, som forskere allerede har udforsket.

Kvanteberegninger som helhed kunne bruges til at løse specifikke beregninger, der er næsten umulige med binær beregning. Dette vil sandsynligvis i sidste ende blive anvendt på kunstig intelligens, men de første kommercielle kvantecomputere er stadig et par år væk, og et stort kvantenetværk endnu længere væk.

Fotonik

Ved at bruge lys i stedet for elektroner til at transportere data kan fotonik være meget hurtigere end elektroniske enheder.

Fordi kvantecomputere normalt bærer kvantedata med sammenfiltrede fotoner, er der også en stor overlapning mellem kvanteberegning og fotonik, og Den første dobbelte kvantefotoniske chip er allerede blevet annonceret.

Organoider

Da det meste kunstig intelligens i computere replikerer funktionen af hjernens neurale netværk, spekulerer nogle forskere på, om vi ikke i stedet kunne bruge ... faktiske hjerneceller.

Det er en spændende idé, især fordi Noget forskning kunne tyde på, at hjernen faktisk er en organisk kvantecomputer.

Denne type "computer" kaldes organoider og består i bund og grund af neuroner, der dyrkes i et laboratorium på en computerchip. Neuronerne selvorganiserer derefter deres dendritter og forbindelser som reaktion på chippens stimulus.

Denne teknologi er stadig ny og er afhængig af bio-3D-printning.

Andre

Vi udforskede andre alternativer til silicium computing i “Top 10 ikke-silicium computing virksomheder", såsom vanadiumdioxid, grafen, redox-gating eller organiske materialer.

Hver især lover de enten at være meget hurtigere eller meget mindre energikrævende end klassisk siliciumbaseret databehandling. De er dog stadig relativt nye og sandsynligvis ikke til at revolutionere AI-feltet i kommerciel skala, i hvert fald ikke i de næste 5-10 år.

Cloud AI og Edge AI: Tilgængelighedstendenser

Cloud AI

Da de mest kraftfulde AI-systemer er lavet af store teknologivirksomheder, er de for det meste tilgængelige via skyen. Det samme er ved at blive tilfældet for adgang til selve AI-specialiseret hardware.

Lederen af denne tendens er Coreweave (CRCW -23.08%), en virksomhed der gik fra at være cloud-udbyder til kryptovaluta-mining ved hjælp af GPU'er, til i dag at levere on-demand AI-beregning.

Dette gjorde CoreWeave til en nøglepartner for kommende AI-startups, der forsøger at konkurrere med tech-giganter, som f.eks. Bøjning AI og GPU-klynge på 1.3 mia. dollars, finansieret af en ny finansieringsrunde.

"For to måneder siden eksisterede en virksomhed måske ikke, og nu har de måske venturekapital til en værdi af 500 millioner dollars.

Og det vigtigste for dem er at sikre adgang til computere; de kan ikke lancere deres produkt eller deres forretning, før de har det.”

Efterhånden som den rene aktør inden for AI-hardware bliver skeptisk over for store teknologivirksomheder, der producerer deres egne GPU'er, TPU'er, XPU'er osv. og udvikler sig fra at være klienter til at blive konkurrenter, er det sandsynligt, at virksomheder som CoreWeave vil få prioriteret adgang til den seneste hardwareudgivelse fra Nvidia og andre.

Denne forretningsmodel vil sandsynligvis være særligt vigtig for AI-træning, som er langt mere krævende i forhold til computerkapacitet end blot at bruge de allerede trænede AI'er.

Edge Computing og AI-pc'er

Et andet eksempel på AI-computing, der udvikler sig hurtigt, er behovet for at få beregningen af AI-systemer udført på stedet, så tæt som muligt på virkelige situationer.

Dette er et must for systemer, der muligvis ikke kan tåle at blive frakoblet AI, hvis forbindelsen fejler, eller når latensen frem og tilbage med skyen er for langsom.

Et godt eksempel er selvkørende biler, som forventes at kunne forstå deres omgivelser offline.

Denne type beregning kaldes edge computing og drager stor fordel af mere effektiv og mindre strømkrævende hardware.

Det kan øge AI-pålideligheden, og efterhånden som modeller bliver mere effektive, illustreret af DeepSeeks fremskridt, kan det blive en mere udbredt model for AI-implementering i fremtiden.

Af samme grund, AI-pc'er ligesom den, som Nvidia for nylig lancerede, kan i det lange løb være nok til at køre mange AI-applikationer lokalt, hvilket øger privatlivets fred og sikkerhed sammenlignet med altid at være forbundet til cloud-AI'er.

Konklusion

AI-hardware har i et stykke tid været synonymt med GPU'er, da grafikkort var meget mere effektive til AI-træning end andre typer hardware som CPU'er. Dette skabte Nvidia og mange af dets tidlige aktionærer en formue.

GPU'er, især AI-fokuserede "super-GPU'er", vil sandsynligvis fortsat være vigtige i opbygningen af AI-datacentre. Men de vil udvikle sig til blot én af komponenterne i stadig mere komplekse og specialiserede systemer.

Transformeroperationer vil blive sendt til TPU'er, neurale netværk, der er tildelt NPP, og gentagne opgaver til dedikerede ASIC'er eller omkonfigurerede FPGA'er.

I mellemtiden vil hukommelse med høj båndbredde, avancerede telekommunikationsstik og ultraeffektiv køling holde alle hjælpefunktionerne omkring computerkernen kørende.

Til edge computing og mindre AI'er end de massive LLM'er vil lokal computing, måske drevet af alt-i-en XPU'er, sandsynligvis blive brugt af forskere, selvkørende biler og brugere, der er bekymrede over privatliv eller censur, potentielt med open source AI-modeller.

Det er sikkert, at profitten fra salget af "hakker og skovle" af AI-hardware i AI-guldfeberen langt fra er ovre.

Efter en periode med Nvidias dominans vil investorer måske diversificere risiciene ved at sprede deres IA-hardwareportefølje til andre designs, og måske endda de elselskaber, der vil levere de dyrebare gigawatt til at drive de stadig større og talrige AI-datacentre i verden.