Kecerdasan Buatan

Berinvestasi dalam Perangkat Keras AI: Dari CPU hingga XPU

Securities.io mempertahankan standar editorial yang ketat dan dapat menerima kompensasi dari tautan yang ditinjau. Kami bukan penasihat investasi terdaftar dan ini bukan nasihat investasi. Silakan lihat pengungkapan afiliasi.

Berinvestasi dalam Perangkat Keras AI: Pendekatan Pilihan dan Sekop

AI menjanjikan akan menjadi perubahan terpenting dalam ekonomi, sistem produksi, dan masyarakat kita dalam beberapa dekade terakhir, bahkan berpotensi membuat perubahan radikal yang dibawa oleh Internet menjadi hal yang remeh jika dibandingkan.

Hal ini mungkin akan mengakibatkan hilangnya seluruh kategori pekerjaan, termasuk pengemudi, penerjemah, layanan pelanggan, desainer web, dan sebagainya. Pekerjaan lain mungkin akan mengalami penurunan permintaan yang drastis, seperti programmer, pengacara tingkat pemula, ahli diagnosa, dan sebagainya.

Ini juga akan menciptakan banyak nilai tambah dan produktivitas untuk banyak tugas lainnya, dengan perusahaan perangkat lunak AI yang dominan kemungkinan menjadi yang pertama mencapai kapitalisasi pasar yang sebelumnya tidak terbayangkan.

Karena semua alasan ini, pasar modal dan investor telah terpesona oleh AI dan memberikan banyak perhatian pada kemajuan banyak raksasa teknologi di bidang AI, serta persaingan ketat yang muncul dari raksasa teknologi Tiongkok seperti Alibaba dan startup seperti Pencarian Mendalam.

Cara lain untuk memanfaatkan ledakan AI adalah dengan mengikuti strategi yang terbukti berhasil di setiap demam emas: jangan mencari emas, tetapi jual beliung dan sekop. Strategi ini tentu saja berhasil bagi perusahaan-perusahaan yang kebetulan berada di posisi terbaik untuk menjual perangkat keras yang dioptimalkan untuk AI, dengan Nvidia (NVDA -2.17%) setelah mengubah kartu grafis game menjadi chip pelatihan AI, menjadikannya perusahaan paling berharga di dunia, setelah melampaui kapitalisasi pasar $4T yang mencengangkan (ikuti tautan untuk laporan lengkap tentang Nvidia).

Karena AI membutuhkan perangkat keras yang sangat spesifik, sebagian besar berbeda dari bentuk tugas komputasi sebelumnya, dan merupakan peluang bisnis yang sangat besar, industri semikonduktor kini berlomba untuk mengembangkan bentuk perangkat keras baru yang dirancang khusus untuk melatih dan menjalankan program AI.

Meskipun Nvidia kemungkinan akan tetap menjadi salah satu perusahaan teratas di sektor ini, alternatif kini mulai bermunculan dan dapat memberikan peluang menarik bagi investor yang memperhatikannya sejak dini.

Mengapa AI Membutuhkan Perangkat Keras Khusus

Banyak Perhitungan Kecil

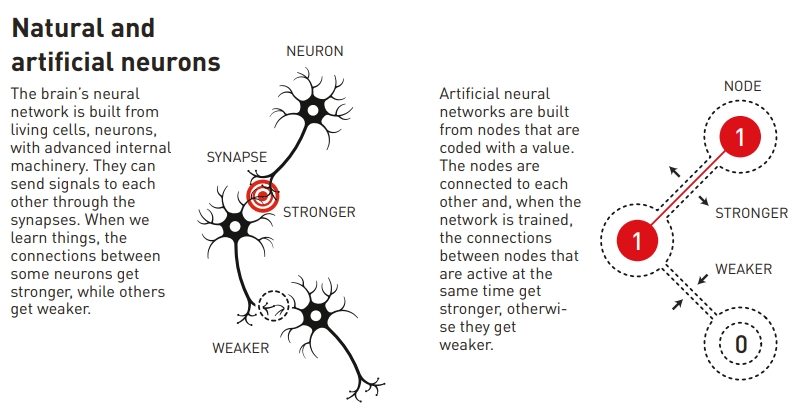

Upaya awal dalam AI menggunakan kapasitas komputasi yang sama dengan program lain, terutama berfokus pada prosesor (Unit Pemrosesan Pusat – CPU). CPU masih penting, tetapi segera terlihat bahwa CPU tidak optimal untuk sebagian besar metode yang saat ini digunakan untuk mengembangkan AI.

Jaringan saraf tiruan dan metode serupa lainnya membutuhkan banyak perhitungan yang relatif sederhana, alih-alih satu perhitungan yang sangat rumit. Oleh karena itu, banyak chip kecil yang bekerja secara paralel umumnya lebih baik daripada menggunakan CPU yang besar dan bertenaga.

Hal ini sebagian besar menjadi alasan mengapa GPU dengan cepat menjadi semakin populer, karena kartu grafis secara inheren dirancang untuk melakukan ribuan perhitungan kecil secara paralel.

Pelatihan AI saat ini sebagian besar didasarkan pada jaringan saraf, sebuah konsep yang memenangkan Hadiah Nobel Fisika pada tahun 2024, sebuah penghargaan yang kami bahas secara rinci dalam artikel khusus pada saat itu.

Sumber: Penghargaan Nobel

Revolusi kedua dalam teknologi AI hadir dengan “transformator”. Mereka memecahkan masalah jaringan saraf tradisional. ketidakmampuan untuk memproses rangkaian data yang panjang secara efisien, sebuah karakteristik umum dari bahasa alami apa pun.

Pertama kali diperkenalkan pada tahun 2017 oleh para peneliti Google, teknologi ini merupakan akar penyebab ledakan kapasitas AI saat ini. Transformer merupakan inti dari produk AI seperti LLM (Large Language Models), termasuk ChatGPT.

Persyaratan yang berbeda

Salah satu perbedaan penting dalam alur kerja AI adalah perbedaan antara mencari setelan dan inferensi, yang keduanya memiliki persyaratan perangkat keras yang berbeda.

- Mencari setelan Melibatkan pelatihan model pada data spesifik domain, yang membutuhkan daya komputasi dan memori yang signifikan. Tugas ini sangat teknis, seringkali berada di ujung tombak ilmu AI.

- Kesimpulan berfokus pada penggunaan model yang sudah terlatih untuk menghasilkan keluaran, membutuhkan daya komputasi yang lebih sedikit tetapi lebih fokus pada latensi rendah dan efisiensi biaya.

- Hal ini lebih rutin dilakukan oleh para ahli AI yang menggunakan model yang telah ada sebelumnya untuk memecahkan masalah kehidupan nyata.

Jadi, meskipun biaya jelas menjadi perhatian untuk penyempurnaan/pelatihan dan inferensi/penggunaan AI, pelatihan sering kali memerlukan perangkat keras terbaik yang memungkinkan, sementara tugas penggunaan akan lebih berfokus pada biaya perangkat keras dan konsumsi energi saat memilih opsi perangkat keras terbaik.

CPU vs GPU

Unit Pemrosesan Pusat (CPU):

CPU bersifat umum dan bukan perangkat keras khusus AI. Namun, CPU tetap penting untuk menjalankan instruksi dan melakukan komputasi dasar dalam sistem AI.

Sebagian besar perangkat lunak yang menangani antarmuka dengan pengguna akhir sistem AI juga akan berpusat pada CPU, baik itu komputer individual atau perangkat lunak berbasis cloud.

Sumber: AnandTech

CPU juga dapat digunakan untuk AI yang sangat sederhana, yang tidak terlalu membutuhkan perangkat keras khusus. Hal ini terutama berlaku ketika output tidak terlalu mendesak, dan pemrosesan AI oleh CPU yang relatif lambat bukanlah masalah.

Jadi, model kecil dengan kumpulan data dan perhitungan kecil dapat bekerja dengan baik di CPU. Keberadaan CPU di mana-mana pada komputer biasa juga menjadikannya pilihan yang baik bagi pengguna rata-rata yang tidak ingin berinvestasi pada perangkat keras khusus AI.

CPU juga sangat andal dan stabil, menjadikannya pilihan yang baik untuk tugas-tugas kritis di mana tidak adanya kesalahan merupakan kriteria penting.

Terakhir, CPU berguna untuk beberapa tugas dalam pelatihan AI, umumnya bekerja sama dengan jenis perangkat keras lain, seperti pemuatan data, pemformatan, pemfilteran, dan visualisasi.

Unit Pemrosesan Grafis (GPU):

Awalnya dirancang untuk rendering grafis, GPU dirancang untuk pemrosesan paralel, sehingga ideal untuk melatih model AI yang memerlukan penanganan set data besar. Peralihan dari CPU ke GPU telah mengurangi waktu pelatihan dari hitungan minggu menjadi hitungan jam.

Karena ketersediaannya yang luas dan pengalaman spesialis TI untuk bekerja dengannya, GPU adalah jenis perangkat keras komputasi pertama yang dipasang secara seri untuk meningkatkan penelitian AI.

Sumber: Aorus

Keberhasilan GPU juga didasari oleh pengembangan CUDA oleh Nvidia, sebuah antarmuka pemrograman serbaguna untuk GPU NVIDIA, yang membuka peluang bagi penggunaan lain selain bermain game. Hal ini terjadi karena beberapa peneliti telah menggunakan GPU untuk melakukan kalkulasi, alih-alih superkomputer yang umum.

Para peneliti menyadari bahwa dengan membeli kartu permainan bernama GeForce, Anda menambahkannya ke komputer Anda, pada dasarnya Anda memiliki superkomputer pribadi.

Dinamika molekuler, pemrosesan seismik, rekonstruksi CT, pemrosesan gambar—sejumlah besar hal yang berbeda.”

Saat ini, GPU masih menjadi salah satu jenis perangkat keras AI yang paling banyak dicari, sementara Nvidia hampir tidak mampu memproduksi cukup banyak untuk memenuhi permintaan raksasa teknologi yang membangun pusat data AI berskala gigawatt.

Ini juga merupakan awal dari “era GPU super”, dengan rilis terbaru oleh Nvidia GB200 NVL72.

Perangkat keras ini dirancang untuk bertindak sebagai satu GPU besar langsung dari pabrik, alih-alih harus menghubungkan banyak GPU kecil. Hal ini menjadikannya jauh lebih bertenaga daripada model H100 yang sebelumnya memecahkan rekor.

Sumber: Nvidia

Ini juga seharusnya jauh lebih hemat energi, sebuah poin krusial karena industri AI mungkin akan kekurangan energi sebelum kekurangan chip mengingat kecepatan pembangunan pusat data AI. Dan peningkatan komputasi & efisiensi energi berarti lebih sedikit panas terbuang, yang juga untuk sementara waktu mengatasi masalah panas berlebih.

| Jenis Perangkat Keras | Kasus Penggunaan Terbaik | Kecepatan | Efisiensi energi | keluwesan |

|---|---|---|---|---|

| CPU | Tugas-tugas umum | Rendah | High | Sangat tinggi |

| GPU | Pelatihan AI & tugas paralel | High | Medium | Medium |

| TPU | Operasi tensor & transformator | Sangat tinggi | High | Rendah |

| ASIC | Akselerasi tugas tunggal | Sangat tinggi | Sangat tinggi | Sangat rendah |

| FPGA | Beban kerja AI yang dapat dikonfigurasi ulang | Medium | Medium | High |

Kebangkitan ASIC dan Perangkat Keras AI

Sirkuit Terpadu Khusus Aplikasi (ASIC) adalah perangkat keras komputasi yang dirancang khusus untuk tugas komputasi tertentu, yang membuatnya lebih terspesialisasi daripada GPU yang masih relatif umum.

Jadi, mereka kurang fleksibel dan kurang dapat diprogram dibandingkan perangkat keras serbaguna.

Umumnya, produk-produk tersebut cenderung lebih kompleks. Harganya pun umumnya lebih mahal, baik karena kurangnya skala ekonomis untuk produksinya maupun karena biaya desain khusus.

Akan tetapi, mereka jauh lebih efisien dalam mengerjakan tugas yang diberikan, biasanya menghasilkan output lebih cepat dengan daya komputasi dan energi yang terbuang jauh lebih sedikit.

ASIC dan perangkat keras khusus AI lainnya semakin banyak digunakan, karena bidang ini semakin menyadari bahwa beberapa perhitungan tidak idealnya dilakukan pada GPU tetapi memerlukan peralatan yang lebih khusus.

Unit Pemrosesan Tensor (TPU)

TPU dikembangkan oleh Google (GOOGL -2.34%) Khususnya untuk melakukan kalkulasi tensor (terkait dengan kalkulus berbasis transformator). Mereka dioptimalkan untuk aritmatika berthroughput tinggi dan presisi rendah.

Sumber: Sudut C#

Hal ini memberikan TPU kinerja, efisiensi, dan skalabilitas tinggi untuk pelatihan jaringan saraf besar.

TPU memiliki fitur khusus, seperti unit perkalian matriks (MXU) dan topologi interkoneksi khusus, yang menjadikannya ideal untuk mempercepat pelatihan dan inferensi AI.

TPU memberi daya pada Gemini, dan semua aplikasi bertenaga AI milik Google seperti Penelusuran, Foto, dan Maps, yang melayani lebih dari 1 miliar pengguna.

Jenis perangkat keras ini dapat mempercepat pengembangan dan kerja jaringan saraf secara signifikan, di mana kesalahan yang kadang terjadi tidak terlalu signifikan, karena model ini sangat bergantung pada statistik dan sejumlah besar perhitungan untuk memulai.

Di antara tugas pengguna akhir yang paling cocok untuk TPU adalah pembelajaran mendalam, pengenalan suara, dan klasifikasi gambar.

Prosesor Jaringan Saraf (NNP):

Juga terhubung dengan Unit Pemrosesan Saraf (NPU) dan disebut chip neuromorfik, NPP merupakan spesialis dalam komputasi jaringan saraf, yang dirancang untuk meniru koneksi saraf di otak manusia. NPP juga terkadang disebut akselerator AI, meskipun istilah ini kurang terdefinisi dengan baik.

NPU juga akan mengintegrasikan penyimpanan dan komputasi melalui bobot sinaptik. Dengan demikian, NPU dapat menyesuaikan atau "belajar" seiring waktu, yang menghasilkan peningkatan efisiensi operasional.

NPU mencakup modul khusus untuk perkalian dan penjumlahan, fungsi aktivasi, operasi data 2D, dan dekompresi.

Modul perkalian dan penjumlahan khusus digunakan untuk melakukan operasi yang relevan dengan pemrosesan aplikasi jaringan saraf, seperti menghitung perkalian dan penjumlahan matriks, konvolusi, produk titik, dan fungsi lainnya.

Spesialisasi ini dapat membantu NPU menyelesaikan operasi hanya dengan satu perhitungan, alih-alih ribuan perhitungan dengan perangkat keras umum. Misalnya, IBM mengklaim bahwa NPU dapat secara radikal meningkatkan efisiensi perhitungan AI dibandingkan dengan GPU.

“Pengujian menunjukkan kinerja beberapa NPU lebih dari 100 kali lebih baik daripada GPU yang sebanding, dengan konsumsi daya yang sama.”

Karena efisiensi energi ini, NPU populer di kalangan produsen untuk dipasang di perangkat pengguna, yang dapat membantu menjalankan tugas-tugas lokal untuk aplikasi AI generatif, sebuah contoh "komputasi tepi" (edge computing). (lihat di bawah untuk informasi lebih lanjut tentang topik tersebut).

Banyak metode yang saat ini sedang dieksplorasi dalam cara membuat chip neuromorfik:

- Memanfaatkan feroelektrik yang baru jadi, sebuah fenomena yang masih kurang dipahami.

- Substrat aktif menggunakan vanadium atau titanium.

- Menggunakan memristor, jenis komponen elektronik baru, yang dapat melakukan tugas AI pada 1/800thdari konsumsi daya normal.

Apembantu Processing Unit ((XPU)

XPU menggabungkan CPU (prosesor), GPU (kartu grafis/prosesor paralel), dan memori menjadi perangkat elektronik yang sama.

Sumber: Broadcom

XPU adalah istilah yang luas, mencakup banyak variasi dari konsep ini untuk membawa semua perangkat keras ke dalam unit mandiri, termasuk Unit Pemrosesan Data (DPU), Unit Pemrosesan Infrastruktur (IPU), dan Kartu Akselerator Fungsi (FAC).

XPU dipandang sebagai solusi atas masalah yang berkembang pada pusat data AI, yakni meningkatnya kebutuhan konektivitas antara sub-unit, sampai pada titik di mana kelambatan data menjadi faktor penting yang memperlambat komputasi, melebihi daya komputasi yang tersedia.

Pada dasarnya, chip (GPU, TPU, NPP, dsb.) menunggu data sebanyak mereka benar-benar bekerja.

Salah satu pemimpin teknologi ini adalah Broadcom (AVGO -2.82%), yang kami bahas secara rinci dalam laporan investasi khusus.

Field-Programmable Gate Array (FPGA):

FPGA adalah prosesor yang dapat diprogram, sehingga jauh lebih fleksibel dan dapat dikonfigurasi ulang dibandingkan ASIC yang lebih kaku. FPGA dapat dikustomisasi untuk algoritma AI tertentu, sehingga berpotensi menawarkan kinerja dan efisiensi energi yang lebih tinggi.

Sumber: Laboratorium Mikrokontroler

Fleksibilitas ini tentu saja ada harganya, karena FPGA umumnya lebih kompleks, mahal, dan mengonsumsi lebih banyak listrik. Namun, FPGA tetap bisa lebih efisien daripada perangkat keras umum.

Hal ini menjadikannya produk yang agak niche, di mana fleksibilitasnya mengimbangi kekurangannya. Misalnya, pembelajaran mesin, visi komputer, dan pemrosesan bahasa alami dapat memperoleh manfaat dari fleksibilitas FPGA.

Memori Bandwidth Tinggi (HBM):

Perkembangan paling penting dalam perangkat keras khusus yang berpusat pada AI telah terjadi di bidang daya komputasi, yang sejak lama menjadi titik kritis dalam membangun lebih banyak kapasitas komputasi untuk melatih AI baru.

Namun, sistem ini juga membutuhkan sistem pendukung berefisiensi tinggi, dan memori merupakan salah satu komponen penting. HBM, sesuai namanya, menyediakan bandwidth yang lebih tinggi daripada DRAM tradisional.

Hal ini dicapai dengan menumpuk beberapa keping DRAM secara vertikal dan menghubungkannya dengan vias silikon tembus (TSV). Generasi pertama HBM dikembangkan pada tahun 2013.

Penumpukan vertikal menghemat ruang dan mengurangi jarak fisik yang harus ditempuh data, mempercepat transfer data, suatu keharusan dalam komputasi AI.

HBM lebih rumit untuk diproduksi dan mahal daripada DRAM, tetapi manfaat kinerja dan efisiensi daya sering kali membenarkan biaya yang lebih tinggi untuk aplikasi AI.

Infrastruktur Pusat Data AI: Daya, Pendinginan & Konektivitas

Selain memori dan daya komputasi, sistem pendukung pusat data AI juga penting. Tanpanya, data tidak dapat bersirkulasi dengan cukup cepat, chip akan terlalu panas, atau daya yang tersedia tidak akan mencukupi.

Artinya, misalnya, perangkat keras konektivitas Broadcom juga mendapat manfaat besar dari pembangunan pusat data AI, begitu pula solusi khusus seperti pemasok peralatan pendingin, misalnya, Vertiv (VRT -0.53%) atau Schneider Electric (SU.PA).

Pasokan listrik juga bisa menjadi masalah, dan beberapa raksasa teknologi mencoba mengatasi masalah ini dengan mengandalkan energi nuklir, dengan langkah pertama Microsoft pada tahun 2024, diikuti oleh banyak lainnya sejak itu.

Dikombinasikan dengan komitmen untuk menurunkan jejak karbon AI oleh perusahaan teknologi, hal ini akan sangat menguntungkan perusahaan di sektor energi nuklir atau energi terbarukan, seperti cameco (CCJ -0.72%), GE Vernova (GEV -2.29%), Surya pertama (FSLR + 2.4%), BerikutnyaEra (NEE + 0.26%), atau Mitra Energi Brookfield (BEP + 1.02%) (ikuti tautan untuk laporan masing-masing perusahaan).

Teknologi Komputasi AI yang Berkembang

Quantum Computing

Karena AI sangat membutuhkan daya komputasi, ada kemungkinan bahwa masa depan perangkat keras di bidang ini bahkan tidak ada dengan solusi silikon yang tersedia saat ini.

Salah satu kemungkinan adalah bahwa komputasi kuantum dapat digunakan untuk mendeteksi pola jauh lebih efisien dibandingkan komputasi klasik, sesuatu yang sudah dieksplorasi oleh para peneliti.

Komputasi kuantum secara keseluruhan dapat digunakan untuk menyelesaikan beberapa perhitungan spesifik yang hampir mustahil dilakukan dengan komputasi biner. Hal ini kemungkinan besar pada akhirnya akan diterapkan pada AI, tetapi komputer kuantum komersial pertama masih beberapa tahun lagi, dan jaringan kuantum yang besar bahkan lebih jauh lagi.

Photonics

Dengan menggunakan cahaya, bukan elektron, untuk membawa data, fotonik dapat berjalan jauh lebih cepat daripada perangkat elektronik.

Karena komputer kuantum biasanya membawa data kuantum dengan foton yang terjerat, terdapat pula banyak tumpang tindih antara komputasi kuantum dan fotonik, dan chip fotonik kuantum ganda pertama telah diumumkan.

Organoid

Karena sebagian besar AI mereplikasi fungsi jaringan saraf otak di komputer, sejumlah peneliti bertanya-tanya apakah kita tidak bisa menggunakan … sel otak yang sebenarnya.

Ini adalah ide yang menarik, terutama karena beberapa penelitian dapat menunjukkan bahwa otak sebenarnya adalah komputer kuantum organik.

Jenis "komputer" ini disebut organoid, dan pada dasarnya terdiri dari neuron-neuron yang ditumbuhkan di laboratorium pada sebuah chip komputer. Neuron-neuron tersebut kemudian mengorganisir sendiri dendrit dan koneksinya sebagai respons terhadap stimulus chip.

Teknologi ini masih baru dan mengandalkan pencetakan bio-3D.

Lainnya

Kami mengeksplorasi alternatif lain untuk komputasi silikon di “10 Perusahaan Komputasi Non-Silikon Teratas”, seperti vanadium dioksida, grafena, gerbang redoks, atau bahan organik.

Masing-masing menjanjikan kecepatan yang jauh lebih tinggi atau konsumsi energi yang jauh lebih rendah dibandingkan komputasi berbasis silikon klasik. Namun, keduanya masih relatif baru dan kemungkinan besar tidak akan merevolusi bidang AI dalam skala komersial, setidaknya dalam 5-10 tahun ke depan.

AI Cloud dan AI Edge: Tren Aksesibilitas

AI awan

Karena sistem AI yang paling canggih dibuat oleh perusahaan teknologi besar, sebagian besar sistem tersebut dapat diakses melalui cloud. Hal yang sama juga berlaku untuk akses ke perangkat keras khusus AI itu sendiri.

Pemimpin tren ini adalah tenunan inti (CRCW -23.08%), sebuah perusahaan yang beralih dari penyedia cloud ke penambangan mata uang kripto menggunakan GPU, hingga kini menyediakan komputasi AI sesuai permintaan.

Hal ini menjadikan CoreWeave sebagai mitra utama bagi startup AI yang akan datang yang mencoba bersaing dengan raksasa teknologi, seperti Infleksi AI dan perusahaan Klaster GPU senilai $1.3 miliar, didanai oleh putaran pendanaan baru.

“Dua bulan yang lalu, sebuah perusahaan mungkin belum ada, dan sekarang mereka mungkin memiliki pendanaan modal ventura sebesar $500 juta.

Dan hal terpenting yang harus mereka lakukan adalah mengamankan akses komputasi; mereka tidak dapat meluncurkan produk atau meluncurkan bisnis mereka sampai mereka mendapatkannya,”

Karena pemain murni dalam perangkat keras AI menjadi waspada terhadap teknologi besar yang memproduksi GPU, TPU, XPU, dll. mereka sendiri dan berevolusi dari klien menjadi pesaing, kemungkinan besar perusahaan seperti CoreWeave akan mendapatkan akses prioritas ke rilis perangkat keras terbaru oleh Nvidia dan lainnya.

Model bisnis ini kemungkinan besar akan sangat penting untuk pelatihan AI, yang jauh lebih menuntut kapasitas komputasi daripada sekadar menggunakan AI yang sudah terlatih.

Komputasi Tepi & PC AI

Kasus lain dari komputasi AI yang berkembang pesat adalah kebutuhan untuk melakukan komputasi sistem AI di tempat, sedekat mungkin dengan situasi kehidupan nyata.

Hal ini wajib dilakukan bagi sistem yang mungkin tidak dapat mentolerir pemutusan sambungan dari AI jika koneksi gagal, atau ketika latensi bolak-balik dengan cloud terlalu lambat.

Contoh yang bagus adalah mobil tanpa pengemudi, yang diharapkan dapat memahami lingkungannya secara offline.

Jenis perhitungan ini disebut komputasi tepi, dan mendapat banyak manfaat dari perangkat keras yang lebih efisien dan lebih hemat daya.

Hal ini dapat meningkatkan keandalan AI, dan seiring model menjadi lebih efisien, seperti yang diilustrasikan oleh lompatan maju DeepSeek, hal ini mungkin menjadi model penerapan AI yang lebih umum di masa mendatang.

Untuk alasan yang sama, PC AI seperti yang baru-baru ini diluncurkan oleh Nvidia, mungkin dalam jangka panjang cukup untuk menjalankan banyak aplikasi AI secara lokal, meningkatkan privasi dan keamanan dibandingkan dengan AI yang selalu terhubung ke cloud.

Kesimpulan

Perangkat keras AI, untuk sementara waktu, identik dengan GPU, karena kartu grafis jauh lebih efisien dalam pelatihan AI dibandingkan jenis perangkat keras lain seperti CPU. Hal ini menguntungkan Nvidia dan banyak pemegang saham awalnya.

GPU, terutama "super GPU" yang berfokus pada AI, kemungkinan akan tetap penting dalam pembangunan pusat data AI. Namun, GPU akan berkembang menjadi salah satu komponen sistem yang semakin kompleks dan terspesialisasi.

Operasi transformator akan dikirim ke TPU, jaringan saraf yang ditugaskan ke NPP, mengulangi tugas ke ASIC khusus atau FPGA yang dikonfigurasi ulang.

Sementara itu, memori bandwidth tinggi, konektor telekomunikasi canggih, dan pendinginan yang sangat efisien akan menjaga semua fungsi tambahan di sekitar inti komputasi tetap berjalan.

Untuk komputasi tepi dan AI yang lebih kecil daripada LLM besar, komputasi lokal, mungkin didukung oleh XPU all-in-one, kemungkinan besar akan digunakan oleh ilmuwan, mobil tanpa pengemudi, dan pengguna yang peduli dengan privasi atau penyensoran, berpotensi dengan model AI sumber terbuka.

Yang pasti, keuntungan dari penjualan perangkat keras AI dalam demam emas AI masih jauh dari selesai.

Setelah periode dominasi Nvidia, investor mungkin ingin mendiversifikasi risiko dengan menyebarkan portofolio perangkat keras IA mereka ke desain lain, dan mungkin bahkan perusahaan utilitas listrik yang akan menyediakan gigawatt berharga untuk menjalankan pusat data AI yang semakin besar dan banyak di dunia.