Computing

Quantencomputing erreicht bedingungslosen exponentiellen Geschwindigkeitsvorteil

Was zuvor nur auf dem Papier ausgedrückt wurde, wurde nun in der Praxis demonstriert. Das Versprechen des Quantencomputings wurde in der Realität verwirklicht, da sie klassische Computer exponentiell und bedingungslos übertroffen1.

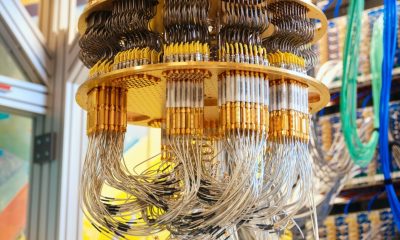

Für dieses Projekt nutzte ein Forscherteam, geleitet von Daniel Lidar, Professor für Electrical & Computing Engineering an der USC Viterbi School of Engineering, clevere Fehlertkorrektur und die leistungsstarken 127‑Qubit‑Prozessoren von IBM, die es ihnen ermöglichten, zu bewältigen einer Variante von Simons Problem, was demonstriert, dass Quantenmaschinen jetzt von klassischen Beschränkungen befreit sind.

Wie Quantencomputing klassische Grenzen und Rauschen überwindet

Jahrzehntelang war klassisches Computing die Norm. In den letzten Jahren hat das Quantencomputing jedoch bedeutende Fortschritte gemacht.

Ein aufstrebender Bereich der Informatik, Quantencomputing nutzt die Prinzipien der Quantentheorie (die die Natur und das Verhalten von Materie und Energie auf atomarer und subatomarer Ebene erklärt), um die Rechengeschwindigkeit dramatisch zu erhöhen.

Durch die Anwendung der Quantenphysik zielt Quantencomputing darauf ab, Probleme zu lösen, die für die klassischen Computer, die wir täglich verwenden, zu komplex sind. Tatsächlich kann Quantencomputing bestimmte komplexe Simulationsprobleme lösen, für die ein herkömmlicher Supercomputer Hunderte von Tausenden Jahren benötigen würde.

Ein echter algorithmischer Vorteil gegenüber klassischen Computern ist eines der Hauptziele des Quantencomputings, um zukünftige Durchbrüche in Chemie, Kryptografie, Optimierung und anderen Bereichen zu ermöglichen.

Dies erfordert jedoch spezialisierte Quantenhardware und Algorithmen, die Quantenphänomene wie Superposition und Verschränkung ausnutzen. Außerdem ist Rauschen ein großes Problem für Quantencomputer.

Den algorithmischen Vorteil gegenüber klassischen Computern auf der heutigen unvollkommenen und rauschbehafteten Quantenhardware zu beweisen, bleibt zudem eine Herausforderung.

Entwickler haben begonnen, neue Lösungen wie NISQ‑Maschinen zu erforschen, doch diese noisy intermediate‑scale quantum (NISQ) Geräte funktionieren nur auf einer relativ kleinen Skala von mehreren hundert Qubits.

Zudem neigen sie dazu, aufgrund von Dekohärenz (dem Verlust der Quantenkohärenz, der einen Informationsverlust des Systems an seine Umgebung bedeutet) und Steuerungsfehlern eine verschlechterte Leistung zu zeigen.

Daher liegt der Fokus darauf, die algorithmische Quantenleistung auf diesen Geräten zu beschleunigen, was einfach ein Skalierungsvorteil ist. Während mehrere solcher Demonstrationen durchgeführt wurden, beruhte die Komplexität der gewählten Probleme entweder auf der Schwierigkeit eines eingeschränkten Satzes klassischer Algorithmen oder auf Annahmen zur Rechenkomplexität.

Kürzlich wurde ein algorithmischer Quanten‑Geschwindigkeitsvorteil gezeigt, der nicht auf unbewiesenen Annahmen im Orakel‑Modell beruht. Dies wurde für einen Bernstein‑Vazirani‑Algorithmus demonstriert, der auf einem IBM‑Quantum‑Prozessor beobachtet wurde, wobei unerwünschtes Rauschen durch dynamisches Entkoppeln (DD), eine gängige Fehlersuppressionstechnik für NISQ‑Geräte, eliminiert wurde.

Jetzt geht das Forschungsteam der University of Southern California das Rauschproblem an, indem es eine Variante von Simons Problem implementiert. Dies ist ein bekanntes Beispiel, bei dem Quantenalgorithmen theoretisch eine Aufgabe exponentiell schneller als ihre klassischen Gegenstücke lösen können, und das bedingungslos.

Simons Problem ist ein Vorgänger des Shor‑Algorithmus, der das Feld des Quantencomputings einläutete.

Es gehört zudem zu den ursprünglichen Problemen, für die ein exponentieller Quanten‑Geschwindigkeitsvorteil im Orakel‑Modell bewiesen wurde. Das Problem erfordert exponentielle Zeit auf einem klassischen Computer, während es auf einem rauschfreien Quantencomputer nur lineare Zeit benötigt, sofern Orakel‑Abfragen gezählt werden, jedoch ohne die Ressourcen zu berücksichtigen, die für die Ausführung aufgewendet werden.

In diesem Problem beinhaltet die abelsche versteckte Untergruppe die Identität und eine geheime Zeichenkette b, wobei das Ziel darin besteht, b zu bestimmen – im Grunde also ein verborgenes wiederholtes Muster in einer mathematischen Funktion zu finden.

Einfacher ausgedrückt ist es ein Ratespiel, bei dem die Spieler versuchen, eine geheime Zahl zu erraten, die niemand außer dem Spielleiter, also dem „Orakel“, kennt.

Die geheime Zahl wird enthüllt, sobald ein Spieler zwei Zahlen findet, für die die Antworten des Orakels identisch sind, und dieser Spieler gewinnt. Im Vergleich zu klassischen Spielern können Quanten‑Spieler dieses Spiel exponentiell schneller gewinnen.

Erreichen eines bedingungslosen Quanten‑Geschwindigkeitsvorteils

Um wirklich neue Materialien zu entdecken, Codes zu knacken und neue Medikamente mit Hilfe von Quantencomputern zu entwerfen, müssen diese funktionstüchtig sein.

Aber wie oben erwähnt, stehen Rauschen oder Fehler im Weg. Fehler, die während Berechnungen auf einer Quantenmaschine entstehen, machen Quantencomputer sogar weniger leistungsfähig als klassische Computer. Das war bis jetzt so.

Lidar von der USC arbeitet an Quanten‑Fehlerkorrektur und hat einen exponentiellen Skalierungsvorteil über die Cloud gezeigt.

Dies wurde in dem Papier „Demonstration of Algorithmic Quantum Speedup for an Abelian Hidden Subgroup Problem“ detailliert beschrieben, in dem Lidar mit Mitarbeitern der USC und Johns Hopkins zusammenarbeitete.

„Früher gab es Demonstrationen bescheidenerer Geschwindigkeitsvorteile wie eines polynomialen Vorteils. Aber ein exponentieller Geschwindigkeitsvorteil ist die dramatischste Art von Beschleunigung, die wir von Quantencomputern erwarten.“

– Lidar

Der Hauptdurchbruch für das Quantencomputing liegt laut Lidar darin, dass wir tatsächlich ganze Algorithmen mit einem Skalierungsvorteil gegenüber unseren allgemeinen Computern ausführen können. Das bedeutet jedoch nicht, dass man Dinge 100‑mal schneller erledigen kann.

Ein Skalierungsvorteil bedeutet, dass „wenn man die Problemgröße erhöht, indem man mehr Variablen einbezieht, die Lücke zwischen der Quanten‑ und der klassischen Leistung weiter wächst. Und ein exponentieller Geschwindigkeitsvorteil bedeutet, dass die Leistungslücke etwa für jede zusätzliche Variable verdoppelt wird“, erklärte Lidar.

Er stellte dann fest, dass der von dem Team gezeigte Geschwindigkeitsvorteil „bedingungslos“ sei. Das bedeutet, dass der Geschwindigkeitsvorteil nicht von irgendwelchen unbewiesenen Annahmen abhängt.

Frühere Geschwindigkeitsvorteils‑Behauptungen benötigten die Annahme, dass es keinen besseren klassischen Algorithmus gibt, gegen den man den Quantenalgorithmus benchmarken könnte.

Das Team hier nutzte einen Algorithmus, den sie für den Quantencomputer modifizierten, um eine Variante von „Simons Problem“ zu lösen.

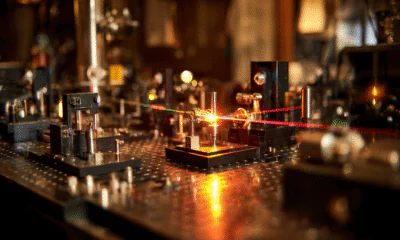

Um den exponentiellen Geschwindigkeitsvorteil zu erreichen, „ist der Schlüssel, jede Unze Leistung aus der Hardware herauszuholen: kürzere Schaltkreise, intelligentere Pulssequenzen und statistische Fehlerminderung“, bemerkte die Erstautorin Phattharaporn Singkanipa, eine Doktorandin der USC.

Das Team erreichte dies auf vier verschiedene Arten. Die Forscher begrenzten zunächst die Dateneingabe, indem sie die Anzahl erlaubter geheimer Zahlen einschränkten. Technisch geschieht das, indem die Anzahl der Einsen in der Binärdarstellung der Menge geheimer Zahlen begrenzt wird. Das führte zu weniger Quantenlogik‑Operationen als sonst nötig, wodurch die Wahrscheinlichkeit von Fehlermengen reduziert wurde.

Dann komprimierten sie die erforderlichen Quantenlogik‑Operationen durch Transpilierung, einen Prozess, bei dem ein gegebener Input so umgeschrieben wird, dass er zur Topologie eines bestimmten Quanten‑Geräts passt.

Als Nächstes wurde eine Methode namens „dynamisches Entkoppeln“ angewendet, die den größten Einfluss auf die Fähigkeit der Forscher hatte, einen Quanten‑Geschwindigkeitsvorteil zu demonstrieren. Diese Methode besteht darin, Sequenzen sorgfältig entworfener Pulse anzuwenden, um das Verhalten eines Qubits von seiner rauschhaften Umgebung zu trennen und die Quantenverarbeitung auf Kurs zu halten.

Zuletzt wendeten die Forscher Measurement Error Mitigation (MEM) an, um bestimmte Fehler zu finden und zu korrigieren. Ziel dieses Schrittes ist es, Fehler zu beheben, die nach dem dynamischen Entkoppeln aufgrund von Unvollkommenheiten bei der Messung des Qubit‑Zustands am Ende des Algorithmus zurückblieben.

Den Weg zur praktischen Nutzung von Quantencomputern ebnen

Da Quantencomputing in Bereichen wie Logistik, Materialwissenschaft, Finanzmodellierung, KI und Cybersicherheit erhebliche Vorteile bietet, indem es quantenmechanische Phänomene nutzt, um komplexe Probleme zu lösen, verzeichnet der Markt bedeutende Beiträge und Wachstum.

Die Gemeinschaft hat zudem begonnen zu zeigen, wie Quantenprozessoren ihre klassischen Gegenstücke bei gezielten Aufgaben übertreffen können.

„Unser Ergebnis zeigt, dass die heutigen Quantencomputer bereits fest auf der Seite eines skalierenden Quanten‑Vorteils stehen“, sagte Lidar, der zudem Professor für Chemie und Physik am USC Dornsife College of Letters, Arts and Science ist und Mitbegründer von Quantum Elements, einem Unternehmen, das den Weg zur Quanten‑Nutzung im großen Maßstab ebnet und Nutzer mit Quantencomputern verbindet.

Vor ein paar Monaten berichtete das Quantum‑Elements‑Team über2 einen Durchbruch. Ihre neuartige Technik, logisches dynamisches Entkoppeln, geht logische Fehler an, eine ständige Herausforderung im Quantencomputing.

Das Team zeigte, wie dieser spezielle Ansatz Fehler verhindert, die traditionelle Fehlerkorrektur‑Codes nicht adressieren können, und das bei gleichzeitig begrenztem Qubit‑Fußabdruck.

Sie kombinierten Fehlerkorrektur mit logischem dynamischem Entkoppeln, wodurch sie die Treue verschränkter logischer Qubits signifikant verbesserten und praktische Quantenanwendungen damit ein Stück näher an die Realität brachten.

Mit der neuesten Forschung sagte Lidar, „der Quanten‑Leistungs‑Vorteil wird zunehmend schwer zu bestreiten sein“, da die Leistungstrennung nicht umkehrbar ist, weil der demonstrierte exponentielle Geschwindigkeitsvorteil „bedingungslos“ sei.

Die Studie zeigt einen eindeutigen algorithmischen Quanten‑Geschwindigkeitsvorteil für eine eingeschränkte Hamming‑Weight‑(HW‑)Version des Problems unter Verwendung zweier verschiedener IBM‑Quantum‑Prozessoren. Die Forscher fanden einen verstärkten Quanten‑Geschwindigkeitsvorteil, wenn die Berechnung durch DD geschützt war. Der Einsatz von MEM verstärkte den Skalierungsvorteil weiter.

MEM und dynamisches Entkoppeln wurden zur Fehlersuppression eingesetzt und modifiziert, um das Problem für reale Quanten‑Geräte anzupassen. Sie halfen, die Quanten‑Kohärenz zu erhalten und die Genauigkeit trotz Hardware‑Beschränkungen zu verbessern.

Durch ihre Experimente haben die Forscher NISQ‑Algorithmen dem Nachweis eines Quanten‑Geschwindigkeitsvorteils mittels Shor‑Algorithmus nähergebracht und die Schlüsselrolle von Quanten‑Fehlersuppressionstechniken bei einem solchen Nachweis hervorgehoben.

Die Demonstration eines exponentiellen Geschwindigkeitsvorteils bei der Lösung des Problems auf echter Quanten‑Hardware ist laut den Forschern „ein wichtiger Meilenstein für das Feld“. Neben der Überbrückung der Lücke zwischen Theorie und Praxis betonen ihre Ergebnisse auch die wachsenden Fähigkeiten aktueller Quantenprozessoren. Die Studie bemerkte:

„Während die Hardware weiter verbessert, ebnet unser Ansatz den Weg für noch leistungsfähigere Demonstrationen von Quanten‑Vorteilen in naher Zukunft.“

Trotz alledem gibt es noch keine praktischen Anwendungen der Technologie über das Gewinnen von Ratespielen hinaus. Das war bei anderen Fortschritten im Feld ebenfalls der Fall.

„Wir brauchen einen ChatGPT‑Moment für Quanten“, sagte Francesco Ricciuti, ein Associate bei der VC‑Firma Runa Capital, im Gespräch mit CNBC im Dezember, als Google den neuen Chip vorstellte, den es als bedeutenden Durchbruch im Quantencomputing bezeichnete.

Der Quanten‑Chip von Google heißt Willow, verfügt über 105 Qubits und kann angeblich Fehler „exponentiell“ reduzieren, wenn die Anzahl der Qubits skaliert wird. Dieser Durchbruch „knackt eine zentrale Herausforderung der Quanten‑Fehlerkorrektur, an der das Feld fast 30 Jahre arbeitet“, sagte Hartmut Neven, Gründer von Google Quantum AI.

Willow führte eine Berechnung durch, die die heutigen schnellsten Supercomputer 10 Septillionen Jahre kosten würde, und das in weniger als fünf Minuten.

„Sie versuchen, ein wirklich schwieriges Problem für normale Computer zu definieren, das sie mit Quantencomputern lösen können. Es ist erstaunlich, dass sie das können, aber das bedeutet nicht unbedingt, dass es nützlich ist“, sagte Ricciuti damals.

Selbst Google gab zu, dass sein RCS‑Benchmark „keine bekannten realen Anwendungen“ hat und dass die „wissenschaftlich interessanten Simulationen von Quantensystemen“, die sie durchgeführt haben und zu neuen wissenschaftlichen Entdeckungen führten, ebenfalls „nach wie vor im Bereich klassischer Computer liegen“.

Der Technologieriese arbeitet jedoch daran, Algorithmen zu entwickeln, die nicht nur außerhalb der Reichweite klassischer Computer liegen, sondern auch „für reale, kommerziell relevante Probleme nützlich“ sind.

Anfang dieses Jahres sagte Julian Kelly, Direktor für Hardware bei Google Quantum AI, dass wir vielleicht „etwa fünf Jahre von einem echten Durchbruch entfernt sind, einer Art praktischer Anwendung, die nur auf einem Quantencomputer lösbar ist.“

Nvidia‑CEO Jensen Huang glaubt ebenfalls, dass Quantencomputing „außergewöhnliche Auswirkungen liefern“ kann, merkt jedoch an, dass die Technologie „verrückt kompliziert“ sei.

Laut Lidar „steht noch viel Arbeit an, bevor Quantencomputer behaupten können, ein praktisches reales Problem gelöst zu haben.“ Und das würde Geschwindigkeitsvorteile erfordern, die nicht von Orakeln abhängen, die die Antwort im Voraus kennen. Darüber hinaus müssten wir bedeutende Fortschritte bei Methoden zur weiteren Reduktion von Dekohärenz und Rauschen erzielen.

Dennoch haben Forscher durch die Demonstration exponentieller Geschwindigkeitsvorteile – die zuvor nur ein „Papier‑Versprechen“ der Quantencomputer waren – einen wichtigen Meilenstein erreicht, der gefeiert werden sollte.

Investitionen in Quantentechnologie

Da Quantencomputer einen bedeutenden Sprung in der Rechenleistung darstellen, entwickeln zahlreiche Labore, Universitäten, Unternehmen und Regierungsbehörden weltweit Quantentechnologie.

Wenn es um Investitionsmöglichkeiten geht, haben wir Amazon (AMZN ), Intel (INTC ), und Microsoft (MSFT ) unter anderem, die den Raum aktiv erkunden. Heute schauen wir uns das Investitionspotenzial von IBM (IBM ), einem Pionier in der Quanten‑Hardware, an.

International Business Machines Corporation (IBM )

IBMs 127‑Qubit‑Prozessoren wurden im USC‑Experiment selbst verwendet. Ende November 2021 stellte IBM diesen Prozessor, genannt Eagle, vor, der auf dem 65‑Qubit‑„Hummingbird“-Prozessor von 2020 und dem 27‑Qubit‑„Falcon“-Prozessor ein Jahr zuvor folgte.

USC ist tatsächlich ein IBM Quantum Innovation Center, während Quantum Elements ein Startup im IBM Quantum Network ist.

Für fokussierte Anstrengungen in diesem Feld verfügt das Unternehmen über die dedizierte Plattform IBM Quantum, die das Ziel hat, den ersten groß‑skaligen fehlertoleranten Quantencomputer zu bauen. Der Technologieriese plant, ein System bereitzustellen, das bis 2029 exakt 100 Millionen Gatter auf 200 logischen Qubits ausführt. Mit diesem System wird IBM „den ersten praktikablen Weg freischalten, die volle Leistungsfähigkeit des Quantencomputings zu realisieren.“

IBM baut diesen Quantencomputer namens „Starling“ an seinem Campus in New York und er soll einen tiefen, fehlerkorrigierten Schaltkreis unterstützen. Laut Fahrplan plant das Unternehmen zudem, später in diesem Jahr einen neuen IBM Quantum Nighthawk‑Prozessor zu veröffentlichen.

Im letzten Monat stellte es ein Quantum System Two in einem Forschungszentrum in Japan bereit. Und diese Woche nahm der Technologieriese an der Finanzierungsrunde von Startup Qedma über 26 Millionen $ teil, wobei der CEO erwartete, dieses Jahr „mit Zuversicht zu demonstrieren, dass der Quanten‑Vorteil hier ist.“ Qedma ist bereits über das IBM‑Qiskit‑Functions‑Catalog verfügbar, das Quanten für Endnutzer zugänglich macht.

Während das Unternehmen führend in der Quantentechnologie ist, ist es hauptsächlich für seine Cloud‑, KI‑ und Beratungs‑Expertise bekannt, die es über die Segmente Software, Consulting und Infrastructure anbietet.

Betrachtet man IBMs Marktperformance, so werden die Aktien des Unternehmens mit einer Marktkapitalisierung von 268,6 Mrd. $ zum Zeitpunkt des Schreibens zu 289 $ gehandelt, ein Anstieg von 30,85 % im Jahresverlauf. IBM‑Aktien haben in den letzten drei Jahren um 145 % zugelegt, während das Unternehmen sich als Anbieter von Next‑Gen‑Enterprise‑Technologie positioniert.

Es hat ein EPS (TTM) von 5,85, ein KGV (TTM) von 49,81 und eine Eigenkapitalrendite (ROE, TTM) von 21,95 %. Die für Aktionäre verfügbare Dividendenrendite liegt attraktiv bei 2,31 %.

(IBM )

Bezüglich seiner finanziellen Leistung meldete IBM einen Umsatzanstieg von 1 % auf 14,5 Mrd. $ im ersten Quartal 2025. Die GAAP‑Bruttogewinnmarge betrug 55,2 % und die non‑GAAP‑Bruttogewinnmarge 56,6 %. Der Netto‑Cash‑Flow aus operativer Tätigkeit lag bei 4,4 Mrd. $, während der freie Cash‑Flow 2 Mrd. $ betrug.

CEO Arvind Krishna führte den Umsatz, die Profitabilität und den freien Cash‑Flow, die die Erwartungen übertrafen, auf „starke Nachfrage nach generativer KI“ zurück und bleibt „optimistisch hinsichtlich der langfristigen Wachstumschancen für Technologie und die globale Wirtschaft.“

Neueste IBM‑Aktiennachrichten und Entwicklungen

Fazit

Die Demonstration eines algorithmischen Quanten‑Geschwindigkeitsvorteils, der mit der Größe des Problems skaliert, ist entscheidend, um die Nutzbarkeit von Quantencomputern zu etablieren. Somit markiert die Demonstration eines bedingungslosen, exponentiellen Geschwindigkeitsvorteils einen Wendepunkt im Quantencomputing und beweist, dass heutige Geräte von klassischen Beschränkungen befreit sind.

Dieser Durchbruch der Forscher erweitert das Spektrum der Quanten‑Geschwindigkeitsvorteile für Orakel‑Algorithmen, erweitert die Grenze empirischer Quanten‑Vorteils‑Ergebnisse und weist darauf hin, dass praktisch relevante Algorithmen endlich in Reichweite sind.

Insgesamt ist die Reise der Quantencomputer zu praktischen, alltäglichen Anwendungen noch im Gange, mit fortlaufenden Verbesserungen, um die volle Leistungsfähigkeit der Quantentechnologie freizuschalten!

Klicken Sie hier für eine Liste der führenden Quantencomputing‑Unternehmen.

Studienreferenzen:

1. Singkanipa, P.; Kasatkin, V.; Zhou, Z.; Quiroz, G.; Lidar, D. A. Demonstration eines algorithmischen Quanten‑Geschwindigkeitsvorteils für ein abelisches verborgenes Untergruppenproblem. Phys. Rev. X 2025, 15 (2), 021082. https://doi.org/10.1103/PhysRevX.15.021082

2. Vezvaee, A.; Tripathi, V.; Morford-Oberst, M.; Butt, F.; Kasatkin, V.; Lidar, D. A. Demonstration hochfidelitärer verschränkter logischer Qubits mittels Transmons. arXiv 2025, arXiv:2503.14472. https://doi.org/10.48550/arXiv.2503.14472