Computing

Il Computing Quantistico Raggiunge un Acceleration Esponenziale Incondizionato

Ciò che prima era espresso solo sulla carta è ora stato dimostrato in azione. La promessa del computing quantistico è stata realizzata nella realtà, poiché hanno battuto i computer classici in modo esponenziale e incondizionato1.

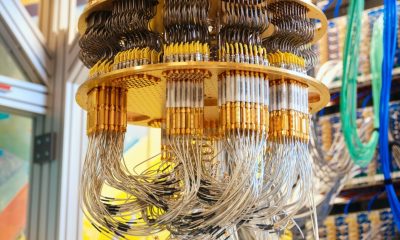

Per questo, un team di ricercatori, guidato da Daniel Lidar, professore di Electrical & Computing Engineering alla USC Viterbi School of Engineering, ha utilizzato una correzione degli errori intelligente e i potenti processori da 127 qubit di IBM che hanno permesso loro di tackle una variazione del problema di Simon, dimostrando che le macchine quantistiche stanno ora liberandosi dalle limitazioni classiche.

Come il Computing Quantistico Supera i Limiti Classici e il Rumore

Per decenni, il computing classico è stato la norma. Tuttavia, negli ultimi anni, il computing quantistico ha subito uno sviluppo significativo.

Un’area emergente dell’informatica, il computing quantistico utilizza i principi della teoria quantistica (che spiega la natura e il comportamento della materia e dell’energia a livello atomico e subatomico) per aumentare drasticamente le velocità di calcolo.

Utilizzando la fisica quantistica, il computing quantistico mira a risolvere problemi troppo complessi per i computer classici che usiamo quotidianamente. In effetti, il computing quantistico può risolvere alcuni problemi di simulazione complessi che richiederebbero persino a un supercomputer tradizionale centinaia di migliaia di anni.

Raggiungere un vero vantaggio algoritmico rispetto ai computer classici è uno degli obiettivi chiave del computing quantistico per consentire future scoperte in chimica, crittografia, ottimizzazione e altri campi.

Questo, tuttavia, richiede hardware e algoritmi di computing quantistico specializzati che sfruttino proprietà quantistiche come la sovrapposizione e l’entanglement. Inoltre, il rumore è un problema importante per i computer quantistici.

Dimostrare un vantaggio algoritmico rispetto ai computer classici sull’hardware quantistico imperfetto e rumoroso di oggi, inoltre, rimane una sfida.

I progettisti hanno iniziato a esplorare nuove soluzioni come le macchine NISQ, ma questi dispositivi quantistici intermedi rumorosi (NISQ) sono funzionali su una scala relativamente piccola di diverse centinaia di qubit.

Inoltre, sono soggetti a prestazioni degradate a causa della decoerenza (la perdita di coerenza quantistica, che comporta una perdita di informazione di un sistema verso l’ambiente) e degli errori di controllo.

Quindi, l’attenzione è rivolta all’accelerare l’algoritmo quantistico su questi dispositivi, che è semplicemente un vantaggio di scalabilità. Sebbene siano state realizzate diverse dimostrazioni di questo tipo, la complessità dei problemi scelti dipendeva sia dalla difficoltà di un insieme ristretto di algoritmi classici sia da congetture sulla complessità computazionale.

Recentemente, è stato mostrato un vantaggio di velocità quantistica algoritmica che non si basa su assunzioni non provate nel modello oracle. Ciò è stato dimostrato per un algoritmo di Bernstein-Vazirani, osservato quando è stato eseguito su un processore IBM Quantum con rumore indesiderato eliminato tramite decoupling dinamico (DD), una comune tecnica di soppressione degli errori per i dispositivi NISQ.

Ora, il team di ricerca dell’Università della Southern California sta affrontando il problema del rumore implementando una variazione del problema di Simon. Questo è un esempio noto in cui, in teoria, gli algoritmi quantistici possono risolvere un compito esponenzialmente più velocemente dei loro equivalenti classici, incondizionatamente.

Il problema di Simon è un predecessore dell’algoritmo di Shor, che può essere utilizzato per avviare il campo del computing quantistico.

È anche tra i problemi originali per cui è stato dimostrato un vantaggio di velocità quantistica esponenziale, sebbene nel modello Oracle. Il problema richiede tempo esponenziale per essere risolto su un computer classico, ma su un computer quantistico privo di rumore richiede solo tempo lineare, assumendo che le query Oracle siano contate, ma non consideriamo le risorse spese per eseguirle.

In questo problema, il sottogruppo nascosto abeliano coinvolge l’identità e una stringa segreta b con l’obiettivo di determinare b, quindi fondamentalmente trovare un modello ripetuto nascosto in una funzione matematica.

In termini più semplici, è come un gioco di indovinelli, in cui i giocatori cercano di indovinare un numero segreto, che non è noto a nessuno tranne all’host del gioco, ovvero l'”oracle”.

Il numero sacro viene rivelato una volta che un giocatore indovina due numeri per i quali le risposte fornite dall’oracle sono identiche, e quel giocatore vince. Rispetto ai giocatori classici, i giocatori quantistici possono vincere questo gioco esponenzialmente più velocemente.

Raggiungere un Vantaggio di Velocità Quantistica Incondizionato

Per scoprire veramente nuovi materiali, decifrare codici e progettare nuovi farmaci con l’aiuto dei computer quantistici accelerando i calcoli, è necessario che siano funzionali.

Ma, come abbiamo notato sopra, il rumore o gli errori ostacolano. Gli errori prodotti durante i calcoli su una macchina quantistica finiscono per rendere i computer quantistici ancora meno potenti dei computer classici. Questo era vero fino a poco tempo fa.

Lidar dell’USC ha lavorato sulla correzione degli errori quantistici e ha mostrato un vantaggio di scalatura esponenziale quantistica sul cloud.

Questo è stato dettagliato nel documento “Demonstration of Algorithmic Quantum Speedup for an Abelian Hidden Subgroup Problem”, in cui Lidar ha collaborato con ricercatori dell’USC e della Johns Hopkins.

“In passato ci sono state dimostrazioni di tipi di vantaggi più modesti, come un vantaggio polinomiale. Ma un vantaggio esponenziale è il tipo più drammatico di accelerazione che ci aspettiamo di vedere dai computer quantistici.”

– Lidar

La principale svolta per il computing quantistico, secondo Lidar, è dimostrare che possiamo effettivamente eseguire interi algoritmi con un vantaggio di scalatura rispetto ai nostri computer generali. Ma, come ha precisato, ciò non significa che si possa fare le cose 100 volte più velocemente.

Ma ciò che significa un vantaggio di scalatura è che “man mano che aumenti la dimensione di un problema includendo più variabili, il divario tra le prestazioni quantistiche e quelle classiche continua a crescere. E un vantaggio esponenziale significa che il divario di prestazioni raddoppia approssimativamente per ogni variabile aggiuntiva,” ha spiegato Lidar.

Ha poi affermato che il vantaggio mostrato dal team è “incondizionato.” Ora, questo significa che il vantaggio non dipende da alcuna assunzione non provata.

Le precedenti affermazioni di vantaggio richiedevano l’assunzione che non esistesse un algoritmo classico migliore contro cui confrontare l’algoritmo quantistico.

Il team qui ha usato un algoritmo che hanno modificato per il computer quantistico per risolvere una variazione del “problema di Simon”.

Ora, per ottenere il vantaggio esponenziale, “la chiave è spremere ogni goccia di prestazione dall’hardware: circuiti più brevi, sequenze di impulsi più intelligenti e mitigazione statistica degli errori,” ha osservato la prima autrice Phattharaporn Singkanipa, ricercatrice dottoranda alla USC.

Il team ha raggiunto questo in quattro modi diversi. I ricercatori hanno prima limitato l’input dei dati restringendo il numero di numeri segreti consentiti. Tecnicamente, ciò avviene limitando il numero di 1 nella rappresentazione binaria dell’insieme dei numeri segreti. Questo ha portato a meno operazioni logiche quantistiche rispetto a quanto altrimenti necessario, riducendo così le probabilità di accumulo di errori.

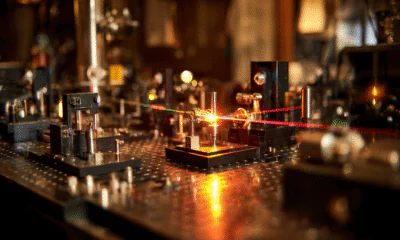

Poi hanno compresso le operazioni logiche quantistiche richieste tramite transpilation, un processo di riscrittura di un dato input per adattarlo alla topologia di un particolare dispositivo quantistico.

Successivamente, è stato applicato un metodo chiamato “decoupling dinamico” che ha avuto l’impatto maggiore sulla capacità dei ricercatori di dimostrare un vantaggio di velocità quantistica. Questo metodo consiste nell’applicare sequenze di impulsi accuratamente progettati per separare il comportamento di un qubit dal suo ambiente rumoroso e mantenere il processo quantistico sulla giusta rotta.

Infine, i ricercatori hanno applicato la mitigazione degli errori di misura (MEM) per individuare e correggere alcuni errori. Lo scopo di questo passaggio è rettificare gli errori lasciati dal decoupling dinamico a causa di imperfezioni nella misurazione dello stato dei qubit alla fine dell’algoritmo.

Aprire la Strada verso l’Utilità Quantistica

Con il computing quantistico che offre vantaggi significativi in settori come la logistica, la scienza dei materiali, la modellazione finanziaria, l’IA e la cybersicurezza sfruttando fenomeni meccanici quantistici per risolvere problemi complessi, il mercato sta registrando contributi e crescita notevoli.

La comunità ha anche iniziato a mostrare come i processori quantistici possano superare i loro equivalenti classici in compiti mirati.

“Il nostro risultato dimostra che i computer quantistici di oggi si trovano già fermamente dal lato di un vantaggio quantistico scalabile.” ha affermato Lidar, che è anche professore di Chimica e Fisica al USC Dornsife College of Letters, Arts and Science e cofondatore di Quantum Elements, una società che apre la strada all’utilità quantistica su larga scala collegando gli utenti ai computer quantistici.

Qualche mese fa, il team di Quantum Elements ha riportato2 un’importante scoperta. La loro nuova tecnica, il decoupling dinamico logico, affronta gli errori logici, una sfida costante nel computing quantistico.

Il team ha dimostrato come questo percorso impedisca errori che i codici di correzione degli errori tradizionali non possono affrontare, mantenendo al contempo un’impronta di qubit limitata.

Hanno combinato la correzione degli errori con il decoupling dinamico logico, consentendo al team di migliorare significativamente la fedeltà dei qubit logici entangled, avvicinando le applicazioni quantistiche pratiche molto più alla realtà.

Con le ricerche più recenti, Lidar ha detto, “il vantaggio di prestazione quantistica sta diventando sempre più difficile da contestare,” poiché la separazione di prestazioni non può essere invertita poiché il vantaggio di velocità esponenziale dimostrato è “incondizionato.”

Lo studio mostra un vantaggio algoritmico quantistico inequivocabile per una versione a peso di Hamming (HW) limitata del problema usando due diversi processori IBM Quantum. I ricercatori hanno riscontrato un miglioramento del vantaggio quantistico quando il calcolo è protetto dal DD. L’uso del MEM ha ulteriormente potenziato il vantaggio di scalatura.

MEM e il decoupling dinamico sono stati usati per la soppressione degli errori e modificati per adattare il problema ai dispositivi quantistici reali. Hanno aiutato a mantenere la coerenza quantistica e a migliorare l’accuratezza nonostante le limitazioni hardware.

Con i loro esperimenti, i ricercatori hanno avvicinato gli algoritmi NISQ a una dimostrazione di vantaggio quantistico tramite l’algoritmo di Shor e hanno evidenziato il ruolo chiave delle tecniche di soppressione degli errori quantistici in tale dimostrazione.

Dimostrare un vantaggio esponenziale nella risoluzione del problema su hardware quantistico reale, secondo i ricercatori, è “un traguardo importante per il campo.” Oltre a colmare il divario tra teoria e pratica, i loro risultati sottolineano anche le crescenti capacità dei processori quantistici attuali. Lo studio ha osservato:

“Man mano che l’hardware continua a migliorare, il nostro approccio apre la strada a dimostrazioni ancora più potenti del vantaggio quantistico nel prossimo futuro.”

Nonostante tutto ciò, non esistono ancora applicazioni pratiche della tecnologia oltre a vincere giochi di indovinelli. Questo è stato vero anche per altri progressi nel campo.

“Abbiamo bisogno di un momento ChatGPT per il quantistico,” ha detto Francesco Ricciuti, associato presso la VC Runa Capital, a CNBC a dicembre, quando Google ha presentato il nuovo chip che, secondo loro, segna una svolta importante nel computing quantistico.

Il chip quantistico di Google si chiama Willow, ha 105 qubit e può ridurre gli errori “esponenzialmente” man mano che il numero di qubit viene aumentato. Questo “risolve una sfida chiave nella correzione degli errori quantistici che il campo ha perseguito per quasi 30 anni,” ha affermato Hartmut Neven, fondatore di Google Quantum AI.

Willow ha eseguito un calcolo che richiederebbe ai supercomputer più veloci di oggi 10 septilioni di anni, in meno di cinque minuti.

“Stanno cercando di definire un problema davvero grande per i computer normali che possono risolvere con i computer quantistici. È sorprendente che possano farlo, ma non significa necessariamente che sia utile,” ha detto all’epoca Ricciuti.

Perfino Google ha affermato che il suo benchmark RCS non ha “applicazioni reali conosciute” e le “simulazioni scientificamente interessanti di sistemi quantistici” che hanno realizzato e che hanno portato a nuove scoperte scientifiche sono anche “ancora alla portata dei computer classici.”

Il colosso tecnologico, tuttavia, sta lavorando per entrare nel regno degli algoritmi che non solo sono fuori dalla portata dei computer classici ma sono anche “utili per problemi reali, commercialmente rilevanti.”

All’inizio di quest’anno, Julian Kelly, direttore dell’hardware presso Google Quantum AI, ha detto che potremmo essere “circa cinque anni lontani da una vera svolta, una sorta di applicazione pratica che si può risolvere solo su un computer quantistico.”

Il CEO di Nvidia, Jensen Huang, crede anche che il computing quantistico possa “offrire un impatto straordinario,” ma ha osservato che la tecnologia è “insanamente complicata.”

Secondo Lidar, “c’è ancora molto lavoro da fare prima che i computer quantistici possano affermare di aver risolto un problema pratico del mondo reale.” E ciò richiederebbe vantaggi di velocità che non dipendono da oracoli che conoscono la risposta in anticipo. Inoltre, dovremmo fare progressi significativi nei metodi per ridurre ulteriormente la decoerenza e il rumore.

Tuttavia, dimostrando vantaggi di velocità esponenziali, che prima erano solo una “promessa su carta” dei computer quantistici, i ricercatori hanno raggiunto una pietra miliare importante, degna di celebrazione.

Investire nella Tecnologia Quantistica

Con i computer quantistici che segnano un salto importante nella capacità di calcolo, numerosi laboratori, università, aziende e agenzie governative in tutto il mondo stanno sviluppando la tecnologia del computing quantistico.

Quindi, quando si tratta di opportunità di investimento, abbiamo Amazon (AMZN ), Intel (INTC ), e Microsoft (MSFT ) tra gli altri che esplorano attivamente lo spazio. Ma oggi, daremo un’occhiata al potenziale di investimento di IBM (IBM ), un pioniere nell’hardware quantistico.

International Business Machines Corporation (IBM )

I processori da 127 qubit di IBM sono stati usati nell’esperimento della USC stesso. È stato a fine novembre 2021 che IBM ha presentato per la prima volta questo processore, chiamato Eagle, che ha seguito il processore da 65 qubit “Hummingbird” lanciato nel 2020 e il processore da 27 qubit “Falcon” un anno prima.

USC è in realtà un IBM Quantum Innovation Center, mentre Quantum Elements è una startup nella IBM Quantum Network.

Per sforzi mirati nel campo, l’azienda ha una piattaforma dedicata, IBM Quantum, che mira a costruire il primo grande computer quantistico fault-tolerant. Il colosso tecnologico punta a fornire un sistema che esegua accuratamente 100 milioni di porte su 200 qubit logici entro il 2029. Con questo sistema, IBM “sbloccherà il primo percorso praticabile per realizzare la piena potenza del computing quantistico.”

IBM sta costruendo questo computer quantistico chiamato “Starling” nel suo campus di New York, e supporterà un circuito profondo, corretto dagli errori. Secondo la sua roadmap, l’azienda sta anche pianificando un nuovo processore IBM Quantum Nighthawk da rilasciare più tardi quest’anno.

Il mese scorso, ha distribuito un Quantum System Two in un centro di ricerca in Giappone. E questa settimana, il colosso tecnologico ha partecipato al round di finanziamento da 26 milioni di dollari della startup Qedma, con il suo CEO che si aspetta di dimostrare quest’anno “con la fiducia che il vantaggio quantistico è qui.” Qedma è già disponibile tramite il Qiskit Functions Catalog di IBM, che rende il quantistico accessibile agli utenti finali.

Pur guidando la tecnologia quantistica, l’azienda è principalmente nota per la sua esperienza nel cloud, IA e consulenza, che fornisce attraverso i segmenti Software, Consulting e Infrastructure.

Se guardiamo alle performance di mercato di IBM, l’azienda con una capitalizzazione di mercato di 268,6 miliardi di dollari ha azioni che al momento della scrittura sono scambiate a 289 $, in crescita del 30,85 % YTD. Le azioni IBM hanno avuto una buona performance con prezzi in aumento del 145 % negli ultimi tre anni, raggiungendo nuovi massimi mentre l’azienda si presenta come fornitore di tecnologia enterprise di nuova generazione.

Ha un EPS (TTM) di 5,85, un P/E (TTM) di 49,81 e un ROE (TTM) del 21,95 %. Il rendimento da dividendo disponibile per gli azionisti, nel frattempo, è un attraente 2,31 %.

(IBM )

Per quanto riguarda le sue performance finanziarie, IBM ha registrato un aumento dell’1 % dei ricavi a 14,5 miliardi di dollari nel primo trimestre del 2025. Il suo margine di profitto lordo GAAP è stato del 55,2 % e il margine di profitto lordo non GAAP del 56,6 %. Il flusso di cassa netto dalle attività operative è stato di 4,4 miliardi di dollari, mentre il free cash flow è stato di 2 miliardi di dollari.

Il CEO Arvind Krishna ha attribuito l’aumento di ricavi, redditività e free cash flow alle “forti richieste per l’IA generativa,” con IBM che rimane “ottimista sulle opportunità di crescita a lungo termine per la tecnologia e l’economia globale.”

Ultime Notizie e Sviluppi sulle Azioni IBM

Conclusione

Dimostrare un vantaggio di velocità quantistica algoritmica, che scala con la dimensione del problema, è fondamentale per stabilire l’utilità dei computer quantistici. Pertanto, la dimostrazione di un vantaggio esponenziale incondizionato segna un momento cruciale nel computing quantistico, provando che i dispositivi di oggi possono liberarsi dai limiti classici.

Questo risultato dei ricercatori estende significativamente la portata dei vantaggi di velocità quantistica per gli algoritmi oracolari, amplia il fronte dei risultati empirici di vantaggio quantistico e indica che algoritmi praticamente rilevanti sono finalmente a portata di mano.

Nel complesso, il percorso dei computer quantistici verso applicazioni pratiche quotidiane è ancora in evoluzione, con continui miglioramenti per sbloccare la piena potenza della tecnologia quantistica!

Clicca qui per un elenco delle principali aziende di computing quantistico.

Studi citati:

1. Singkanipa, P.; Kasatkin, V.; Zhou, Z.; Quiroz, G.; Lidar, D. A. Demonstration of Algorithmic Quantum Speedup for an Abelian Hidden Subgroup Problem. Phys. Rev. X 2025, 15 (2), 021082. https://doi.org/10.1103/PhysRevX.15.021082

2. Vezvaee, A.; Tripathi, V.; Morford-Oberst, M.; Butt, F.; Kasatkin, V.; Lidar, D. A. Demonstration of High-Fidelity Entangled Logical Qubits using Transmons. arXiv 2025, arXiv:2503.14472. https://doi.org/10.48550/arXiv.2503.14472