Artificiell intelligens

CoreWeave: Cloud AI Hyperscaler

Securities.io har rigorösa redaktionella standarder och kan få ersättning från granskade länkar. Vi är inte en registrerad investeringsrådgivare och detta är inte investeringsrådgivning. Vänligen se vår anknytning till anknytning.

AI Computing As A Service

AI blir allt viktigare i nästan alla företag, med progressivt kraftfullare modeller, inklusive mycket effektiva, billiga och öppen källkod som DeepSeek.

Detta behov av beräkningar kopplade till AI kan dock vara mycket varierande, vilket gör det rationellt för de flesta användare att vara beroende av molntjänster för att tillhandahålla det istället för att direkt äga de nödvändiga chipsen och datacentren. Detsamma kan vara sant för andra datortunga uppgifter, som specialeffektgenerationer.

En lösning för att komma åt sådana molntjänster är att förlita sig på de stora molnleverantörerna, som Amazons AWS (AMZN ), Google Cloud (GOOGL ), eller Microsofts Azure(MSFT ).

Ett annat alternativ är att gå direkt till en AI-fokuserad molnleverantör, med infrastrukturen helt dedikerad till den typ av datorhårdvara som krävs av AI-beräkningar.

En av de största leverantörerna av detta slag är CoreWeave, som har samlat på sig GPU:er sedan 2017. CoreWeave tittar nu på att ansöka om en börsnotering som höjer $4 miljarder, vilket skulle bringa dess värdering till $35 miljarder.

Så investerare kanske vill veta mer om företaget och hur det är positionerat för att dra nytta av AI-boomen, även medan osäkerheten hopar sig om branschens framtid när det gäller den beräkningskraft som verkligen behövs.

CoreWeaves historia

CoreWeave är en nykomling i molndatorbranschen, som grundades 2017. Man specialiserade sig initialt på datoranvändning för kryptovalutaindustrin med GPU:er (Graphics Processing Unit).

GPU:er är initialt chips designade för grafisk beräkning, ofta för 3D-videospel. De är dedikerade till att utföra tusentals enkla beräkningar parallellt, istället för några komplexa åt gången, som processorer (CPU).

Som det visade sig var GPU:er en perfekt design för den typ av beräkning som krävs för cryptocurrency mining, och även för AI som använder neurala nätverk, vilket resulterade i explosiv tillväxt och ledarskap inom AI-hårdvara för GPU-specialisten Nvidia (NVDA ).

(Du kan läsa mer om investeringscase för Nvidia i vår dedikerade rapportt).

Sedan, 2019, gick det vidare till ett mer generaliserat molnerbjudande, fortfarande specialiserat på GPU-baserade beräkningar.

CoreWeaves tidiga förvärv av en enorm mängd grafikprocessorer gjorde det till en nyckelpartner för AI-startups som letade efter extra datorkraft.

"Folk kunde fortfarande komma åt GPU:er förra året, men när det blev extremt snävt var det plötsligt som, var får vi tag i dessa saker?

AI-företag som använde CoreWeave spred ordet till VCs, tillade han, som plötsligt såg en guldgruva: "De sa, 'Varför pratar vi inte med de här killarna'?"

Att vara på rätt plats vid den tiden gav tillgång till massor av kapital för tillväxt till CoreWeave, med flera insamlingsrundor, upp till 1.1 miljarder dollar 2024.

”Vi anser att CoreWeave har framstått som en viktig ledare i att bygga den verksamhetskritiska infrastrukturgrund som krävs för att tillgodose samhällets nuvarande och framtida behov av högpresterande beräkningsteknik i stor skala för att driva den generativa AI-revolutionen.”

Philippe Laffont, grundare och portföljförvaltare av CoreWeave.

Översikt över CoreWeave

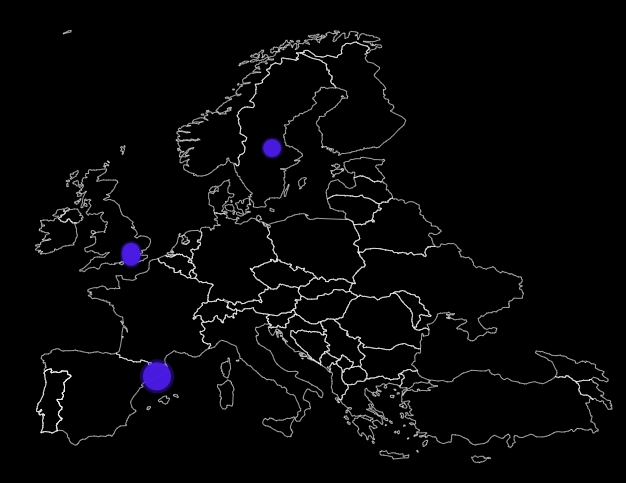

Hittills har företaget mestadels byggt sin infrastruktur i USA, med Nordamerika som värd för de flesta av sina servrar och 3 installerade i Europa.

Källa: CoreWeave

Källa: CoreWeave

CoreWeave övervakar ständigt "hälsan" för sin utrustning, identifierar potentiella problem proaktivt och minskar risken för driftstopp eller underpresterande av sina servrar.

Utöver datorkapaciteten ger CoreWeave en hög säkerhetsnivå till sina servrar, en kritisk fråga med tanke på frågan om datasekretess och säkerhet som omger AI, såväl som den intensiva konkurrensen från amerikanska och utländska företag.

Även om CoreWeave tekniskt sett är en konkurrent till stora teknikföretag, kan de också ses som en värdefull partner, där Microsoft bland annat är företagets största kund.

År 2024 skapade CoreWeave runt 2 miljarder dollar i intäkter och har ett mycket aggressivt tillväxtmål på 8 miljarder dollar för 2025.

Källa: CoreWeave

Ett centralt centrum för AI-molntjänster från CoreWeave är flexibilitet. Det kan snabbt öka den tillgängliga datorkraften för ett företag som växer snabbt eller alternativt avveckla den om ett projekt är över. Genom att ha hundratals olika klienter kan CoreWeave optimera till maximalt utnyttjande av sina värdefulla GPU:er.

”För två månader sedan kanske ett företag inte existerade, och nu kan de ha 500 miljoner dollar i riskkapitalfinansiering. Och det viktigaste för dem att göra är att säkra tillgången till datorer; de kan inte lansera sin produkt eller starta sitt företag förrän de har det.”

CoreWeave-fördelar

Kostnadsfördelar

I de flesta branscher brukar det löna sig att vara något specialiserad. Detta ger företaget lite extra kompetens och hjälper det att erbjuda sina produkter eller tjänster till det billigaste priset.

Detta verkar vara fallet för CoreWeave, som det påstår sig tillhandahålla dess tjänst upp till 35 gånger snabbare och 80 % billigare än äldre leverantörer.

Även om dessa siffror kan återspegla ett urval av konkurrenterna som det jämförs med, verkar det överlag vara sant att CoreWeave är billigare än de flesta i branschen.

Till exempel den omfattande databasen för molnleverantör Digital Ocean indikerar att den billigaste GPU-leverantören är CoreWeave, med ett pris på $0.35/h för åtkomst till Quadro RTX 4000 GPU:er.

Källa: CoreWeave

Det verkar också som att CoreWeave kan konkurrera på pris med gigantiska Oracle (ORCL ), som har försökte aggressivt minska priserna på moln-GPU för att ta marknadsandelar med nystartade företag.

(Läs mer om detta i vår dedikerade rapport "Oracle (ORCL): Database Giant, Stargate och DeepSeek")

Detta engagemang för att tillhandahålla GPU och inget annat ger CoreWeave en stark expertis i att maximera utnyttjandet av chipsen, vilket minskar kostnaden per användning.

När de tre stora bygger en molnregion, bygger de för att betjäna hundratusentals eller miljoner av vad jag skulle kalla generiska användningsområden för deras användarbas, och i dessa regioner kanske de bara har en liten del av kapaciteten avsedd för GPU-beräkning.

Kostnadsfördelar uppnås också genom att ha en tidig leverantör av moln-GPU-tjänster, vilket gav företaget den skala som krävs för att minska kostnaden per beräkningsenhet av overhead, FoU, etc.

Teknisk expertis

Som specialist kan CoreWeave också tillhandahålla skräddarsydda datacenter för AI-företag. Så när ett AI-företag funderar på att bygga en mycket specifik typ av modell, kan CoreWeave också bygga en skräddarsydd infrastruktur som specifikt matchar detta behov.

Denna expertis förmedlas också i hur man bygger generalistiska GPU-fokuserade datacenter, vilket leder till optimering av arbetskraft som krävs, energiförbrukning, kylsystem, etc.

Detta tar också bort från klienterna behovet av att optimera hårdvarugränssnittet, GPU:ernas hälsa etc., och istället koncentrera sig på sin kärnkompetens.

Det är därför de bästa AI-företagen samarbetar med CoreWeave, som Inflection AI med ett $1.3B GPU-kluster betalas av en ny finansieringsrunda.

"De ringde oss och sa," Killar, vi behöver er för att bygga en av de mest högpresterande superdatorerna på planeten för att stödja vårt AI-företag.

De ringer oss och de säger: 'Det här är vad vi letar efter, kan du göra det?' — och jag tror att vi har två av de fem bästa superdatorerna som vi bygger just nu när det gäller FLOPPAR. "

Brannin McBee- CoreWeave medgrundare och chief strategi officer

Symbios med Nvidia

Samtidigt som de tillhandahåller några andra marker, är det mesta av CoreWeave-beräkningskraften baserad på Nvidia-chips. GPU:er har varit en bristvara sedan kryptoboomen och sedan AI-boomen, med halvledargjuterier som kämpar för att hänga med efterfrågan.

Detta har lett till en situation där företag som Nvidia i viss mån kan välja AI-vinnaren genom att helt enkelt leverera snabbare eller långsammare till några av sina kunder.

Nvidia har varit ganska generös med CoreWeave, vilket ofta har gett den en ledande plats i GPU-leverans över molnledare som AWS. Detta beror på AWS, liksom de flesta av de andra stora molnleverantörerna, vill minska sitt beroende av Nvidia genom att utveckla sina egna AI-chips.

I längden kan detta bli ett problem för Nvidia, eftersom många av deras nuvarande kunder tittar på företagets höga marginaler och tror att de istället skulle kunna behålla pengarna genom vertikal integration. Detta blir dock en fördel för CoreWeave, eftersom det innebär att företaget fokuserar på att enbart bygga ett datacenter, vilket gör det till en perfekt partner för Nvidia.

"Det är verkligen ingen nackdel att inte bygga våra egna chip. Jag kan tänka mig att det verkligen hjälper oss i vår ständiga strävan att få fler grafikkort från Nvidia på bekostnad av våra konkurrenter."

Brannin McBee- CoreWeave medgrundare och chief strategi officer

Detta skapar en bild av CoreWeave som ett företag som kan leverera på sina löften och den beräkningsförmåga som behövs när större molnleverantörer kämpar för att hålla jämna steg, samtidigt som CoreWeave har tillgång till många av Nvidias senaste GPU:er, inklusive H100 och H200.

Källa: CoreWeave

Super GPU-eran

Nyligen, CoreWeave blev den första molnleverantören med allmänt tillgängliga Nvidia gb200 nvl72-instanser. Nvidia GB200 NVL72 är designad för att fungera som en enda massiv GPU, vilket gör den mycket kraftfullare än till och med den tidigare rekordhöga H100-modellen. Detta borde också vara mycket mer energieffektivt, en avgörande punkt eftersom AI-industrin kan sakna energi innan den saknar chips i den hastighet med vilken AI-datacenter byggs.

Källa: Nvidia

Detta är viktigt, eftersom designen att bara stapla fler GPU:er ovanpå varandra för att bygga ett AI-datacenter håller på att bli föråldrad.

CoreWeave Future

Hur mycket beräkna?

Den öppna frågan om flera biljoner dollar inom teknikindustrin är AI:s framtid.

Å ena sidan är det tydligt att tekniken går snabbare än de flesta förväntat sig. Detta borde i teorin vara idealiskt för företag som CoreWeave, som naturligtvis kommer att växa minst lika snabbt som hela AI-branschen. Och sannolikt snabbare, eftersom hyperskalare och molnleverantörer kommer att vara bland de största förmånstagarna av AI, som kommer att bli tillräckligt närvarande för att varje företag ska kunna använda det i en eller annan form.

Å andra sidan är det inte klart vad den faktiska datorkraften är som krävs för AI-applikationer på lång sikt. Branschen försöker fortfarande ta hänsyn till avslöjandet att Kinas DeepSeek kan erbjuda liknande resultat för 1/25.th av priset på American OpenAI.

Fram till nu har antagandet varit att bättre modeller alltid skulle vara mer giriga på datorkraft, till den grad att tillgången på rå elektrisk kraft har blivit ett problem och att stora teknikföretag skyndade sig att slåss om kärnkraftverkens framtida leverans.

DeepSeek har allvarligt skakat denna idé. Tänk om framtiden för AI är många små, ultraeffektiva AI:er med öppen källkod istället för centraliserade applikationer i gigawatt-datacenter?

Om detta är framtiden för AI skulle det vara ett allvarligt hot mot företag som OpenAI, byggt på antagandet att deras datorfördelar skulle vara tillräckliga för att skapa en affärsvallgrav.

Detta kan dock knappast skada CoreWeaves långsiktiga utsikter. Om AI blir så billigt att träna och använda betyder det att praktiskt taget alla företag kommer att vilja ha sina egna AI-modeller för sina kundtjänster, underhållshantering, HR, försäljning, marknadsföring etc. De flesta av dessa företag kommer inte att vilja hantera sin egen hårdvara för att driva dessa AI:er. En modellagnostisk lågkostnadsleverantör som CoreWeave kommer sannolikt att vinna över Big Tech molnleverantörer som mer sannolikt kommer att misstänkas för att driva på deras lösningar och AI.

Vilka GPU:er?

Hittills har CoreWeave mestadels förlitat sig på chips från branschledaren Nvidia. Med antagandet av GB200 kommer detta inte att ändras inom kort.

På lång sikt kan det dock vara så att vissa företag lyckas kopiera Nvidias skicklighet inom parallell databehandling och GPU-liknande teknik. Om så är fallet kommer CoreWeave att sakta kunna gå över till en sådan ny leverantör om det behövs.

Detsamma kan sägas om ett nytt radikalt sätt att utföra AI-beräkningar dyker upp. CoreWeaves skala och nätverk av AI-fokuserade kunder skulle göra dem till en utmärkt partner för utbyggnaden av denna nya teknik.

Detta är särskilt sant av samma anledning som gjorde det till en nyckelpartner till Nvidia: CoreWeave kommer aldrig att försöka replikera ett sådant AI-chip internt (till skillnad från Google, Microsoft, Meta, AWS, etc.), och kan istället hjälpa det att distribueras så snabbt som möjligt.

(Du kan läsa mer om de potentiella framtida GPU:er för AI-applikationer i denna artikel från DigitalOcean)

Kryptovalutor

En annan potential för CoreWeave i framtiden är cryptocurrency. Även om företaget i stor utsträckning har svängt till den ännu större AI-marknaden, är detta fortfarande en aktivitet som kräver mycket beräkningskraft.

As Donald Trump planerar en nationell cryptocurrency-reserv med Bitcoin, eter, XRP, Solana och Cardano, är det tydligt att kryptor kan bli en viktig del av det finansiella och betalningsmässiga ekosystemet i USA.

Och ju fler officiella kryptovalutor blir, desto mer sannolikt är det att de förlitar sig på säkra och kända infrastrukturleverantörer som CoreWeave.

Så vi kunde förvänta oss att detta kommer att vara en icke obetydlig del av företagets verksamhet även i framtiden.

Slutsats

CoreWeave är egentligen inte så mycket en AI som det är en tjänsteleverantör till en industri som växer explosivt. Detta innebär att det är mycket mindre utsatt för nyckfullheten att behöva välja rätt typ av neurala nätverksteknik, träningsmetod etc, än de flesta AI-företag.

Istället, så länge den säkrar tillgången till den senaste och mest kraftfulla GPU:n, kommer den sannolikt att förbli en favoritpartner för varje startup som arbetar med AI.

Ankomsten av kraftfulla modeller med öppen källkod som DeepSeek kan potentiellt ge CoreWeaves verksamhet ett starkt lyft, även om det minskar branschens beräkningsintensitet som helhet. Detta beror på att det öppnar vägen för många fler konkurrenter till OpenAI genom att minska riskkapitalintäkterna som krävs för att starta.

Sådana mindre och smidigare startups kommer inte att bygga sitt eget AI-datacenter och infrastruktur utan kommer att förlita sig på molnleverantörer. Detsamma kommer att gälla för större företag som vill utveckla sina egna proprietära AI: er och ovilliga att ha det på servern för företag som kan vara intresserade av deras hemliga data.

Så, med en börsnotering framför sig, kan CoreWeave vara ett sätt för investerare att satsa på hela AI-branschen utan att behöva förstå finesserna i olika AI-modeller och teknik.