Luftfart

Rumbaseret AI: Den næste grænse for cloud-skalering

Securities.io opretholder strenge redaktionelle standarder og kan modtage kompensation fra gennemgåede links. Vi er ikke en registreret investeringsrådgiver, og dette er ikke investeringsrådgivning. Se venligst vores tilknyttet videregivelse.

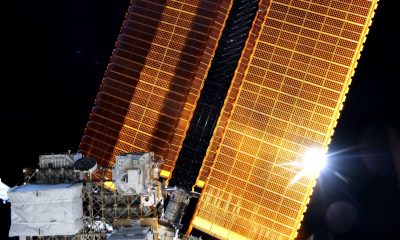

Hvorfor AI-infrastruktur flytter ud i kredsløb

I takt med at AI boomer, er der opstået adskillige forsyningsbegrænsninger. Den første var GPU'er, hvor specialiseret hardware gik fra at være en niche i spilbrug til masseadoption i AI-datacentre. Som et resultat heraf har Nvidia (NVDA -2.17%), sektorens leder, har vokset sig til verdens største virksomhed.

Men en anden begrænsning er ved at blive hovedproblemet: energiforsyning.

Dette skyldes, at AI-datacentre nu måles ikke så meget på deres beregningskraft, men på deres strømforbrug. Det er derfor AI-virksomheder kæmper for at genstarte atomkraftværker, sikre de første SMR-prototyper eller Statslige tilsynsmyndigheder sætter nye gasdrevne kraftværker på en hurtig godkendelsesbane.

I takt med at kapløbet om at finde energi til datacentre intensiveres, vendes øjnene mod en anden mulighed: rumbaseret AI, hvilket giver "cloud computing" en helt ny fysisk betydning.

Muligheden for ubegrænset energiforsyning fra satellitter i orbital bane er noget, vi allerede har analyseret grundigt i “Rumbaserede energiløsninger til endeløs ren energi".

Men dette koncept er altid noget begrænset af behovet for at omdanne solenergi til strøm, omdanne denne elektricitet til mikrobølger for at stråle den tilbage ned til Jorden og derefter omdanne den tilbage til strøm.

Dette øger kompleksiteten af kraftsatellitterne, kræver mere jordbaseret infrastruktur og reducerer generelt procedurens effektivitet drastisk, da hver omdannelse til en anden form for energi fører til tab. Dette vil sandsynligvis kun kunne fungere med meget billige opsendelser i orbitalrummet.

Alternativt, hvis strømmen blev brugt direkte i kredsløb, ville dette være meget mere effektivt og blive økonomisk rentabelt hurtigere – især hvis det endelige "produkt" nemt kan sendes tilbage til Jorden.

I teorien kunne datacentre i rummet være den ideelle løsning: de kræver meget strøm, men at sende resultaterne af beregningerne tilbage til Jorden er trivielt, kræver ingen ny infrastruktur og forårsager ikke energitab.

Ideen er ikke kun teoretisk; for eksempel har Alphabet/Google netop annonceret “Projekt Suncatcher", en prototype af et orbitalt AI-beregningssystem, som vi dækkede i "Googles projekt Suncatcher og fremkomsten af orbital kunstig intelligens".

Så, kunne det virke, og hvorfor kunne det være det næste skridt i opbygningen af AI-infrastruktur?

Kollisionen mellem to tendenser

Løsning af den jordbaserede strømbegrænsning

Der er behov for mere energi end nogensinde før til at drive den menneskelige civilisation, og kommercialiseringen af LLM'er har kun øget behovet for nye kraftværker. Indtil videre er det meste af den nyinstallerede elproduktion solenergi.

Kilde: ARK Invest

Men dette udgør et problem for jordbaserede elnet, da solenergi kun producerer strøm, når solen skinner, hvilket resulterer i lavere produktion på overskyede dage, om vinteren eller om aftenen. I modsætning hertil kræver strømkrævende kilder som AI-datacentre en kontinuerlig energiforsyning, hvor spidsbelastning ofte forekommer om aftenen og om vinteren.

I teorien kan dette løses med billig energilagring, som f.eks. batteriparker i stor skala. Men i praksis ophæver dette mange af fordelene ved solenergi som en grøn og billigere energikilde.

Kilde: ARK Invest

ARK Invest anslår, at kapitaludgifter til elproduktion skal skaleres mellem ~2 og ~10 billioner dollars inden 2030 for at imødekomme den globale efterspørgsel efter elektricitet. Heraf skal udrulningen af stationær energilagring skal skaleres 19 gange.

Kilde: ARK Invest

Dette vil også kræve massive investeringer i elnettet, hvilket yderligere øger omkostningerne. Ethvert alternativ, der springer batteri- og netomkostninger over, kan være konkurrencedygtigt, selv med sine egne unikke infrastrukturomkostninger, såsom opsendelsen af rumbaserede AI-datacentre i orbital bane.

Starships deflationscyklus

Det er ingen hemmelighed, at SpaceX er den mest succesfulde rumfokuserede virksomhed nogensinde. Ved at frigøre pålidelige genanvendelige løfteraketter har virksomheden dramatisk reduceret omkostningerne ved at løfte nyttige nyttelaster til Jordens kredsløb. Omkostningerne er faldet med ~95%, fra ~$15,600/kg til under ~$1,000/kg i de 17 år siden 2008.

Den nye supertunge løfteraket, Starship, vil sandsynligvis fortsætte denne tendens og i sidste ende bringe opsendelsesomkostningerne op i området ~$100/kg.

Kilde: ARK Invest

Hvad der endnu ikke er fuldt ud forstået, er, at dette ikke blot gør satellitter eller rummissioner billigere; det ændrer radikalt det kan gøres i rummet.

Når det kun koster 100 dollars at sende et kilo materiale ud i rummet, bliver det økonomisk rentabelt at sende noget nyttigt eller let nok i kredsløb. Dette gælder for tyndfilms-solceller, som kan være meget lette, når de ikke behøver at blive beskyttet af glas eller stive metalrammer mod vejret på jorden.

Dette gælder også for materialer, der er meget rentable pr. kilo, såsom computerchips.

For eksempel koster et komplet GB300 NVL72 rack/kabinet fra NVIDIA så meget som $4 millioner, men vejer kun omkring 1.8 tons (4,000 lbs). Omkostningerne ved at sende sådant materiale i kredsløb med $100/kg er kun $180,000 - næsten en afrundingsfejl i forhold til hardwareomkostningerne.

Den samlede pris ville selvfølgelig være højere, når man tager højde for understøttende udstyr (afskærmning, køling, strømproduktion osv.), men det betyder, at det ikke vil øge omkostningerne voldsomt foreløbigt at få et AI-computersystem i kredsløb. Det er sandsynligt, at vendepunktet ligger omkring $500/kg af opsendelsesomkostninger.

Kilde: ARK Invest

Som en ekstra bonus kan fremkomsten af orbital AI yderligere forbedre økonomien ved genanvendelige raketter ved at skabe et massivt marked at servicere. Mens færdiggørelsen af Starlink-konstellationen muligvis kræver 11 gange den kumulative opmasse, som SpaceX løfter indtil 2025, vil 100 GW AI-beregning øge efterspørgslen efter orbital løfteevne med yderligere 60 gange. Til gengæld vil denne mængde reducere opsendelsesomkostningerne yderligere.

Kilde: ARK Invest

Hvorfor orbital AI har strukturelle fordele

Stryg for at scrolle →

| Chauffør | Terrestriske AI-datacentre | Orbital AI-datacentre | Hvorfor det drejer sig om |

|---|---|---|---|

| Strømtilgængelighed | Begrænset af netkapacitet, brændstofforsyning og tidsfrister for tilladelser | Næsten kontinuerligt solpotentiale i den rigtige bane; ingen netforbindelse | Orbital beregning omgår den langsomste del af AI-skalering: strøm + tilladelser |

| Kapacitetsfaktor | Solenergi er intermitterende; sikring kræver lagring eller regulerbar produktion | Høj soltilgængelighed med reduceret intermittensitet vs. jordbaseret solenergi | Reducerer eller eliminerer lagerinvesteringer til opstramning |

| Køling over hovedet | Høje HVAC/varmeafvisningsbelastninger; vandmangel i mange regioner | Radiativ køling via store varmeradiatorer; intet vandbehov | Mere beregningskraft pr. watt, når køleenergien er lavere (men radiatormassen betyder noget) |

| Latens og båndbredde | Fremragende til interaktive arbejdsbyrder; fiberbackbones er tætte | Bedst egnet til batch/HPC, træning eller asynkron inferens; er afhængig af satcom-links | Orbital AI starter sandsynligvis med ikke-latensfølsom arbejdsbyrder |

| Implementeringshastighed | Jord, tilladelser, netopgraderinger og byggeri tager år | Startkadens bliver den afgørende faktor, hvis der findes standardiserede platforme. | En "produktion + lancering"-model kan komprimere tid til kapacitet |

| Hårde risici | Tilladelser, netbelastning, lokale vand-/termiske grænser | Stråling, affald/kollision, service og bortskaffelse ved udtjent levetid | Orbitaløkonomi afhænger af afbødning rumspecifikke fejltilstande |

| Økonomisk hængsel | Kapitaludgifter for strøm + sammenkobling + køling dominerer skalering | Opsendelse + platformmasse + oppetid i kredsløb dominerer skalering | Crossoveren ankommer, når $/kg og standardiserede platforme reducerer den samlede leverede datakraft |

Perfekt til solcelleanlæg

Solenergi er rigeligt tilgængelig i rummet – op til 4 gange så stor som den samme nominelle kapacitet takket være direkte sollys uden atmosfærisk tab. I den rigtige bane er den også meget mere pålidelig og skinner konstant døgnet rundt.

Dette fjerner de begrænsninger, som landbaseret solenergi har. I teorien kunne dette være den endelige form for solenergiproduktion. Men på grund af vanskeligheden ved at bringe denne energi tilbage til Jorden, vil det kræve ultra-billige opsendelsesomkostninger eller produktion i kredsløb for at være økonomisk rentabelt.

Alternativt kan enklere orbitale spejle, der skinner på landbaserede solcelleparker, som forsvaret af Reflektere Orbital, springer muligvis tabene ved konvertering fra lys til mikrobølge over.

Hvis der derimod bruges strøm i kredsløb, er ingen af disse trin nødvendige. Når beregningen er færdig, kan de resulterende data sendes tilbage til Jorden ved hjælp af standard telekommunikationsmetoder, hvor satellitbåndbredden forbedres hurtigt.

Naturkøling

En anden unik fordel ved rumbaserede AI-datacentre er køling. Når rummet ikke udsættes for solens stråling, er det ekstremt koldt og ligger på -100 °C for et rumfartøj i skyggen af Jorden eller dets egne rumfartøjer.

En betydelig del af energiforbruget i jordbaserede datacentre kommer fra køling. Placering af dem i Arktis eller selv stratosfæren er blevet foreslået, så rummet tilbyder en naturlig fordel. Dette vil sandsynligvis kræve massive passive kølesystemer til at udstråle varme, men det er teknisk muligt.

Allestedsnærværende satellitintelligens

SpaceX og dets bredbåndssatellitnetværk har fuldstændig ændret det orbitale landskab, hvor Starlink-satellitter udgør omtrent halvdelen af alle satellitter i kredsløb.

Kilde: ARK Invest

Dette har forårsaget et eksponentielt fald i omkostningerne til satellitbåndbredde, der er faldet næsten 100 gange mellem 2020-2024, med yderligere gevinster forventet fra Starship-flyvninger.

Kilde: ARK Invest

Telekommunikation i rummet bliver så allestedsnærværende og billig, at orbitale datacentre kan bruge eksisterende netværk til at kommunikere med Jorden uden behov for at opbygge dedikeret kapacitet. Desuden kan et tæt satellitnetværk føre til yderligere vedligeholdelsestjenester, såsom optankning eller "bugsering", hvilket ville øge levetiden for disse aktiver.

Adskillelse af rum- og landinfrastruktur

Fordi orbitale AI-datacentre ikke er forbundet til det almindelige elnet, vil de ikke påvirke elpriserne på Jorden. Hvis noget, vil den ekstra efterspørgsel efter solteknologi bidrage til at gøre solenergi billigere globalt.

Derudover behøver disse centre ikke at vente på opgraderinger af det jordbaserede elnet, hvilket kan tage år. Processen undgår også brug af jord og værdifulde vandressourcer, hvilket forbedrer den samlede økonomi.

Investering i orbital kunstig intelligens

Broadcom

Broadcom Inc. (AVGO -2.82%)

Udover GPU-producenter og AI-modeludviklere er virksomheder, der producerer konnektivitet og specialiseret IT-udstyr til datacentre, de store vindere af AI-boomet. En stor virksomhed i denne kategori er Broadcom, en tech-gigant med rødder tilbage til dot-com-æraen.

Efter fusionen af Broadcom og Avago i 2016 er virksomhedens aktiviteter opdelt mellem infrastruktursoftware og tilslutningshardware (trådløs, servere, AI-netværk osv.).

Kilde: Broadcom

En anden voksende AI-relateret aktivitet er design og fremstilling af XPU'er, som samler CPU, GPU og hukommelse i én elektronisk enhed. Broadcom bruger sin erfaring med at producere ASIC'er (applikationsspecifikke integrerede kredsløb) til at skabe chips designet specifikt til AI-databehandling.

Kilde: Broadcom

Disse typer kompakte, energieffektive computerenheder er et perfekt match til orbital AI, som kræver en optimeret balance mellem ydeevne og vægt. ASIC'ernes højere energieffektivitet er også et plus, da lavere strømforbrug reducerer massen af solpaneler, der er nødvendige i kredsløb.

Investor Takeaways:

- Kerneafhandling: AI's bindingsbegrænsning skifter fra beregning til strømtilgængelighed og tilladelsesfrister; orbital beregning er en potentiel strukturel løsning.

- Økonomisk udløser: Lanceringsomkostningerne nærmer sig ~500 USD/kg væsentligt udvide den mulige nyttelastmix (solenergi, radiatorer, afskærmning) til rentable implementeringer af orbitale databehandlingssystemer.

- Tidlige vindere: "Hakke-og-skovle"-aktivere—ASIC/XPU-designere, fotonik/sampakket optikog varmestyring—fordel før der findes nogen "ren orbital sky" offentligt.

- Vigtigste risici: Strålingshærdning, logistik for service i kredsløb og risiko for affald/kollisioner kan undergrave økonomien, selvom opsendelsespriserne falder.

- Tidshorisont: Behandl orbital AI som en infrarødt tema med lang varighedfokus på virksomheder, der tjener penge på jordbaseret AI-skalering i dag, samtidig med at de skaber mulighed for at udnytte arbejdsbyrder i rummet.