Computing

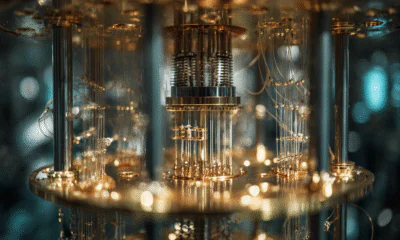

Stratosferyczne centra danych kwantowych: następna chmura

Securities.io utrzymuje rygorystyczne standardy redakcyjne i może otrzymywać wynagrodzenie z przeglądanych linków. Nie jesteśmy zarejestrowanym doradcą inwestycyjnym i nie jest to porada inwestycyjna. Zapoznaj się z naszymi ujawnienie informacji o stowarzyszeniu.

Co jeśli „chmura obliczeniowa” stanie się dosłowna? Naukowcy badają wdrażanie zaawansowanych komputerów w stratosferze, które mają rozwiązać jeden z podstawowych problemów komputerów kwantowych.

Jeśli zostanie wdrożony, ten wyjątkowy droga do rozwiązać problem może zaoszczędzić na kosztach chłodzenia i całkowicie się zmienić droga we wiedzieć i pomyśl of „przetwarzanie w chmurze”.

TL; DR

-

-

Komputery kwantowe wymagają ekstremalnego chłodzenia, a obecne systemy kriogeniczne sprawiają, że centra danych kwantowych są drogie, energochłonne i trudne do skalowania.

-

Naukowcy z KAUST proponują umieszczenie procesorów kwantowych na sterowcach latających na dużych wysokościach. Dzięki temu mogliby wykorzystać naturalnie niskie temperatury stratosfery i zmniejszyć zapotrzebowanie na chłodzenie nawet o 21 procent.

-

-

Te powietrzne platformy korzystałyby z energii słonecznej, łączy optycznych w wolnej przestrzeni oraz balonów przekaźnikowych, aby łączyć się z naziemnymi centrami danych, oferując jednocześnie elastyczną, ruchomą moc obliczeniową.

-

Wstępne modelowanie wskazuje, że podejście to może obsługiwać większą liczbę kubitów przy niższym wskaźniku błędów, co wskazuje na przyszłość, w której obliczenia kwantowe i obliczenia w chmurze dosłownie połączą się w chmurach.

Rosnący koszt chłodzenia centrów danych kwantowych

Komputery kwantowe jest rodzaj komputera że wykorzystuje mechanika kwantowa umożliwia wykonywanie skomplikowanych obliczeń znacznie szybciej niż klasyczne komputery.

W przeciwieństwie do komputerów klasycznych, które przechowują i przetwarzają dane w bitach (czyli zerach lub jedynkach), komputery kwantowe wykorzystują kubity, które mogą występować w wielu stanach jednocześnie, co jest zjawiskiem zwanym superpozycją, a także mogą być ze sobą połączone, co jest zjawiskiem zwane splątaniem. Właściwości te pozwalają komputerom kwantowym badać wiele możliwości jednocześnie.

Komputery kwantowe, których podstawową jednostką danych są kubity, umożliwiają wykonywanie zaawansowanych obliczeń równoległych i charakteryzują się znacznie zwiększoną pojemnością pamięci. Kubity są jednak bardzo wrażliwe na szum środowiskowy, taki jak ciepło, wibracje i zakłócenia elektromagnetyczne.

Są po prostu bardzo delikatne i jako takie utrzymywane są w ekstremalnie niskich temperaturach, aby zapobiec błędom spowodowanym hałasem i zapewnić prawidłowe funkcjonowanie.

Większość układów kwantowych działa w temperaturach rzędu kilku mK do 10K.

Tak więc centra danych kwantowych (QDC) mieć potencjał wykonać zadanie dwa razy szybciej niż a tradycyjny pierwszej, oni konsumują dziesięć razy więcej energii dzięki Zastosowanie energochłonnych kriogenicznych układów chłodzenia.

W rezultacie tam is potrzeba do zbadać dotychczasowy QDC aspekty termodynamiczne w celu zmniejszenie dotychczasowy zużycie energii chłodzącej of te centra danych.

Niektóre z głównych technik chłodzenia stosowanych w centrach danych dla układów scalonych kwantowych obejmują chłodzenie laserowe, chłodzenie rozcieńczające i chłodzenie za pomocą lampy impulsowej, przy czym coraz większego znaczenia nabierają zaawansowane technologie, takie jak wykorzystanie efektu magnetokalorycznego (zjawiska, w którym materiały magnetyczne nagrzewają się po przyłożeniu pola magnetycznego i stygną po usunięciu pola) w ciałach superstałych.

Inna technika polega na zanurzaniu obwodów kwantowych w rzadkim płynie kriogenicznym helu-3, który staje się nadciekły w ekstremalnie niskich temperaturach i wykazuje wyjątkowe właściwości kwantowe.

Nadal osiągnięcie i utrzymanie środowiska kriogenicznego dla kubitów wymagania znaczne koszty i energię, co stanowi poważną barierę dla informatyka kwantowa adopcja i skalowanie up tej szybko rozwijającej się technologii.

Ten wzywa do innowacyjnych podejść inżynieryjnych, które umożliwią wysokowydajne obliczenia kwantowe.

Badanie przeprowadzone przez naukowców z KAUST właśnie to umożliwiło, proponując rozmieszczenie procesorów kwantowych na stratosferycznych platformach wysokościowych (HAP). Procesory będą umieszczone na sterowcach latających przez stratosferę na wysokości około 20 kilometrów (12.4 mili), gdzie temperatura otoczenia wynosi -50°C (około -58°F).

Wykorzystując te naturalnie zimne warunki, naukowcy zamierzają znacząco zmniejszyć zapotrzebowanie na chłodzenie centrów kwantowych (QDC) i umożliwić zrównoważone, wysoko wydajne obliczenia kwantowe.

Przekształcanie sterowców w zasilane energią słoneczną kriogeniczne centra danych

Nowa propozycja badaczy z Arabii Saudyjskiej Uniwersytet Nauki i Technologii im. Króla Abdullaha (KAUST)), opublikowano w czasopiśmie npj Wireless Technology1, przedstawia nowe ramy wdrażania komputerów kwantowych w stratosferze przy użyciu sterowców.

Pokazuje to również, że ich unikalne podejście do ekologicznych, elastycznie wdrażanych obliczeń kwantowych w górnych warstwach atmosfery oferuje wyższa efektywność energetyczna. Co więcej, system ten działa lepiej pod względem obliczeniowym niż tradycyjne naziemne centra danych.

„Dzięki operowaniu ponad chmurami i systemami pogodowymi sterowiec ma dostęp do przewidywalnego i nieograniczonego promieniowania słonecznego”.

– Wiodący autor, Basem Shihada z KAUST

W celu wykorzystać zimne warunki of stratosfery, zespół proponuje platformy wysokościowe obsługujące obliczenia kwantowe (QC-HAP). Te stratosferyczne sterowce będą mieścić urządzenia kwantowe zamknięte w kriostatach, które będą utrzymywać wymaganą kriogeniczną temperaturę.

Owszem, kriostaty są nadal potrzebne do podtrzymywania stanów kwantowych, ale na takiej wysokości naturalnie niskie temperatury otoczenia drastycznie zmniejszają ilość energii niezbędnej do chłodzenia kriogenicznego.

Przesuń, aby przewijać →

| Parametr | Naziemne Centrum Danych Kwantowych | Stratosferyczny sterowiec QC-HAP |

|---|---|---|

| Temperatura otoczenia | ~20–25 °C na poziomie gruntu, wymaga głębokich stosów kriogenicznych | ≈ −50 °C na wysokości ~20 km, co łagodzi obciążenie kriogeniczne |

| Zapotrzebowanie na energię chłodniczą | Wysoki, zdominowany przez chłodziarki rozcieńczające i chłodnice rurowe pulsacyjne | Modelowanie sugeruje, że zapotrzebowanie na chłodzenie jest nawet o ~21% niższe w porównaniu z gruntowymi QDC |

| Podstawowe źródło zasilania | Energia elektryczna z sieci, często pochodząca ze źródeł kopalnych i odnawialnych | Akumulatory solarne o dużej mocy i litowo-siarkowe do użytku nocnego |

| Pojemność kubitów i błędy | Ograniczone przez moc chłodzenia i hałas; wyższy wskaźnik błędów w przypadku dużej skali | Modele wskazują na około 30% więcej kubitów przy niższym współczynniku błędów w niektórych architekturach |

| Łączność | Sieci światłowodowe i klasyczne; łącza kwantowe wciąż w fazie eksperymentalnej | Łącza optyczne w wolnej przestrzeni z zapasowym sygnałem RF i przekaźnikami balonowymi zapewniającymi dostęp na duże odległości |

| Elastyczność wdrażania | Stałe lokalizacje, wieloletnie cykle budowy i nakłady inwestycyjne | Mobilna flota, która może przesuwać moce przerobowe w kierunku punktów o dużym zapotrzebowaniu lub odległych regionów |

Ponadto sterowce zostaną wyposażone w panele słoneczne przetwarzające światło słoneczne na energię elektryczną oraz akumulatory litowo-siarkowe, które zapewnią płynną pracę sterowców w nocy i przy niesprzyjającej pogodzie.

Zgodnie z artykułem, promieniowanie kosmiczne, czyli wysokoenergetyczne cząstki wytwarzane przez słońce, będzie miało znikomy wpływ na niezawodność stratosferycznych systemów komputerowych wykorzystujących kwantowe technologie obliczeniowe, co potwierdza zdolność platformy do pracy w stratosferze.

QC-HAP-y umieszczone na niebie będą być połączonym do naziemnych centrów danych kwantowych.

W tym celu HAP-y wysyłałyby informacje zakodowane w falach świetlnych przez Komunikacja optyczna w wolnej przestrzeni (FSO). W warunkach zachmurzenia łącza radiowe będą służyć jako zapasowe.

Aby zapobiec degradacji sygnału i dekoherencji podczas przesyłania danych przez atmosferę, zespół sugeruje korzystanie z pośrednich platform przenoszonych przez balony na niższych wysokościach jako stacje przekaźnikowe.

Największą zaletą QC-HAP jest możliwość ich przenoszenia w dowolne miejsce, niezależnie od tego, czy chodzi o wymagające punkty dostępowe, czy o odległe regiony. To elastyczne wdrożenie rozszerza zasięg obliczeń kwantowych, eliminuje wąskie gardła obliczeniowe i redukuje opóźnienia.

Ponadto można je ze sobą łączyć, zwiększając ogólną moc obliczeniową i tworząc „dynamiczną flotę zdolną do świadczenia skalowalnych usług obliczeń kwantowych na żądanie na całym świecie” – powiedział współautor badania, Wiem Abderrahim, który obecnie jest pracownikiem naukowym Uniwersytetu w Kartaginie w Tunezji.

Taka skalowalna architektura konstelacji multi-HAP pozwala przezwyciężyć indywidualne ograniczenia energetyczne i zwiększyć zalety obliczeniowe.

Według obliczeń badaczy, ich rozwiązanie zasilane energią słoneczną może zmniejszyć zapotrzebowanie na chłodzenie o 21% w porównaniu z podobnymi centrami obliczeń kwantowych na ziemi.

Naukowcy wykorzystali podejście oparte na dwóch wiodących formach obliczeń kwantowych ze względu na ich dojrzałość, stabilność, skalowalność i czas koherencji. Zmniejszenie zapotrzebowania na chłodzenie różni się w zależności od architektury kubitowej, ponieważ każdy typ działa w inny zakres temperatur kriogenicznych.

Jedno z podejść wykorzystuje kubity oparte na uwięzionych jonach schłodzonych do temperatury około 4K (około –269°C). To podejście przyniosło największe korzyści z koncepcji QC-HAP. Drugie podejście wykorzystuje obwody nadprzewodzące działające w temperaturach od 10 do 20 mK.

Ich analiza pokazuje również, że te HAP-y oparte na kwantach obsługują o 30% więcej kubitów niż naziemne QDC, zachowując jednocześnie niższy wskaźnik błędów, zwłaszcza przy wykorzystaniu zaawansowane możliwości sprzętowe.

W badaniu zauważono, że oprócz kubitów, oszczędności energii uzyskane dzięki stratosferycznemu systemowi kwantowemu zależą również od architektury centrum danych.

Choć ta futurystyczna koncepcja jest potężna, jej praktyczne wdrożenie jest jeszcze dalekie. Wymaga znacznych postępów w dziedzinie sprzętu do obliczeń kwantowych, na przykład solidnych systemów identyfikacji i korygowania błędów, w szczególności podczas transmisji.

Istnieją również dotychczasowy unikalne cechy środowiska stratosferycznego, takie jak sezonowe wahania natężenia promieniowania słonecznego i warunki pogodowe, które wpływają na pozyskiwaną energię słoneczną, a w konsekwencji wpływają efektywności energetycznej proponowanej przez nich platformy, co wymaga starannego rozważenia.

W przyszłych badaniach nacisk powinien być położony na analizę wpływu czynników środowiskowych na układy kwantowe oraz opracowywanie solidnych projektów do wdrożenia QC-HAP w rzeczywistych warunkach.

„Naszym kolejnym krokiem będzie przejście od etapu koncepcyjnego i analitycznego do badań bardziej skoncentrowanych na wdrożeniu”.

– współautor badania, Osama Amin

Patrząc w przyszłość, naukowcy spodziewają się, że powietrzne rozwiązania kwantowe nie zastąpią konwencjonalnych naziemnych centrów danych, lecz będą funkcjonować obok nich w ramach hybrydowej infrastruktury przetwarzania w chmurze.

Globalny wyścig o urzeczywistnienie komputerów kwantowych

Podczas gdy naukowcy badają platformy kwantowe oparte na niebie, główni gracze branżowi nieustannie udoskonalają sprzęt niezbędny w erze kwantowej, którą te platformy mogą ostatecznie obsługiwać.

IBM (IBM ), na przykład, należy do grona osób mocno zaangażowanych w badania nad komputerami kwantowymi i ma nadzieję, że przed końcem dekady uda się stworzyć Starlinga, odporny na błędy komputer kwantowy na dużą skalę.

Niedawno firma ogłosiła opracowanie nowych jednostek przetwarzania kwantowego (QPU), które są oczekiwane aby pomóc im osiągnąć przewagę kwantową jak również komputer kwantowy w pełni odporny na błędy.

Z 120 kubitami IBM Quantum Nighthawk to jego pierwszy nowy procesor które mogą przetwarzać O 30% bardziej złożone obliczenia kwantowe niż w poprzednim procesorze QPU firmy IBM (R2 Heron). Każdy z tych kubitów może się połączyć z najbliższym cztery sąsiedzi dzięki sprzęgi strojone. Dzięki tym ramom naukowcy będą mogli badać problemy wymagające 5,000 bramek dwukubitowych, a IBM ma nadzieję, że mieć Przyszłe wersje Nighthawka dostarczanie do 10 000 bram do końca 2027 r.

IBM Loon to drugi mniejszy procesor, który ma 112 kubitów i wszystkie elementy sprzętowe wymagane do pełnej odporności na błędy, aby sprostać wysokiemu wskaźnikowi awaryjności w kubitach. Ten pomoże zespołowi w nauce przed Kookaburrą, kolejnym procesorem koncepcyjnym, który będzie pierwszym modułowo zaprojektowanym procesorem QPU do przechowywania i przetwarzania zakodowanych informacji. jest oczekiwany w przyszłym roku.

Ponadto IBM udostępniło informację, że ich nowych format produkcja procesorów kwantowych na waflu o średnicy 300 mm (12 cali) skraca o połowę czas potrzebny na zbudowanie każdego z nich, jednocześnie zwiększając dotychczasowy złożoność fizyczna z chipsów o 10x.

Podczas gdy sprzęt przyspiesza, harmonogramy rozwoju głównego nurtu technologii kwantowych różnią się znacząco w zależności od lidera branży.

Komputery kwantowe według Firmy Intel (INTC ) Były prezes, Pat Gelsinger, stanie się popularny znacznie szybciej, za około dwa lata, i będzie oznaczał koniec GPU. Tymczasem Nvidia (NVDA ), wiodący gracz na rynku procesorów graficznych, stwierdził, że miną dwie dekady, zanim technologie kwantowe staną się powszechne.

„Wkraczamy w najbardziej ekscytującą dekadę lub dwie dla technologów” – powiedział Gelsinger w wywiadzie dla FT. Nazywał również obliczenia kwantowe „świętą trójcą” dotychczasowy computing świat, obok obliczeń klasycznych i obliczeń opartych na sztucznej inteligencji.

Choć Gelsinger uważa, że „przełom kwantowy” pęknie bańka sztucznej inteligencji, Sundar Pichai z Google’a widzi w nim początek kolejnego boomu w dziedzinie sztucznej inteligencji.

Dyrektor generalny trzeciej co do wielkości firmy na świecie by kapitalizacja rynkowa na poziomie 3.86 biliona dolarów stwierdziła w niedawnym wywiadzie, że komputery kwantowe szybko zbliżają się do przełomowego momentu podobnego do tego, jaki miał miejsce w przypadku sztucznej inteligencji kilka lat temu.

„Powiedziałbym, że kwantowość jest tam, gdzie sztuczna inteligencja była może pięć lat temu. Myślę więc, że za pięć lat będziemy przechodzić przez bardzo ekscytującą fazę kwantowości”.

– Pichai

A Google aktywnie przygotowuje się do tej zmiany. Według Pichai:

„Mamy najnowocześniejsze osiągnięcia w dziedzinie komputerów kwantowych na świecie… myślę, że budowanie systemów kwantowych pomoże nam lepiej symulować i rozumieć naturę, a także przyniesie społeczeństwu wiele korzyści”.

Wzmacniając tę trajektorię, zaledwie w zeszłym miesiącu, badacze z Google Quantum AI zgłaszane Wdrożenie kod powierzchniowy2 wykorzystując trzy różne obwody dynamiczne. Ten otwiera nowe możliwości praktycznego zastosowania znanej techniki korekcji błędów kwantowych (QEC) i może również pomóc w opracowaniu bardziej niezawodnych komputery kwantowe.

QEC to sposób na zapewnienie niezawodnej pracy tych komputerów. Jest on również niezbędny do budowy komputerów kwantowych odpornych na błędy, ale „wdrożenie QEC stanowi poważne wyzwanie, ponieważ obwody wykrywania i korygowania błędów są złożone i wymagają niezwykle precyzyjnych operacji” – powiedział współautor Matt McEwen.

Kod powierzchniowy, o którym mowa, działa poprzez organizację kubitów na siatce 2D, a następnie wielokrotne sprawdzanie ich pod kątem błędów.

Wcześniej McEwen pracował nad propozycją teorii, która pokazywała, że istnieją liczne sposoby jej implementacji, w szczególności demonstrując wykonalność trzech odrębnych implementacji kodu powierzchni dynamicznej: hex, iSWAP i obwody kroczące.

Opierając się na tym, zespół kontynuował praca nad udowodnieniem że przeprowadzają eksperymenty w warunkach rzeczywistych.

Po przeprowadzeniu testów odkryli, że obwody iSWAP uległy poprawie dotychczasowy tłumienie błędów o 1.56 razy, a obwód spacerowy o 1.69 razy, podczas gdy obwód heksagonalny zrobił to 2.15 razy.

„Najważniejszym wnioskiem płynącym z naszej pracy jest potwierdzenie, że implementacje dynamicznych obwodów działają w rzeczywistości”.

– McEwen

Przyspieszają również przełomy w zakresie stabilności kubitów. Inżynierowie z Princeton były niedawno w stanie rozciągać się czas życia kubitów3 w ich najnowszych badaniach, które został częściowo sfinansowany przez Google Quantum AI.

Inżynierowie wykonali duży krok w kierunku opracowania użytecznych komputerów kwantowych. Stworzyli nadprzewodzący kubit, który pozostał stabilny przez ponad 1 milisekundę, czyli trzy razy dłużej niż najsilniejsze istniejące wersje.

„Prawdziwym wyzwaniem, tym, co uniemożliwia nam dziś stworzenie użytecznych komputerów kwantowych, jest to, że po zbudowaniu kubitu informacja po prostu nie jest zbyt trwała” – powiedział współautor Andrew Houck, dziekan wydziału inżynierii na Uniwersytecie Princeton. „To kolejny wielki krok naprzód”.

Aby potwierdzić poprawę spójności kubitów, naukowcy zbudowali działający układ kwantowy, wykorzystując nową architekturę, która jest podobna do systemów opracowanych przez Google i IBM (IBM ).

Opcja kubitu transmonowego opiera się na obwodach nadprzewodzących, które działają w ekstremalnie niskich temperaturach. zimno temperatury i oferować solidne ochrona od hałas środowiskowy. Dobrze sprawdzają się również we współczesnych procesach produkcyjnych. Wydłużenie czasu koherencji tych kubitów jest jednak niezwykle trudne.

Zespół Princeton przeprojektował więc kubit, używając dotychczasowy wyjątkowo wytrzymały tantal zapobiegający dotychczasowy strat energii i powszechnie dostępnego, wysokiej jakości krzemu jako podłoża. Taki układ scalony tantalowo-krzemowy jest nie tylko łatwiejszy w masowej produkcji, ale także przewyższa obecne konstrukcje pod względem parametrów.

Połączenie tych dwóch elementów, a także udoskonalenie technik produkcyjnych, pozwoliło zespołowi osiągnąć jedno z najbardziej znaczących udoskonaleń w historii transmonu. Hipotetyczny komputer o mocy 1,000 kubitów może pracować około miliard razy lepszy, jeśli weźmiemy pod uwagę obecny najlepszy projekt w branży is zamienione z Princeton design ze względu na swoje ulepszenia skalowaniem wykładniczo wraz z rozmiarem systemu – powiedział Houck.

Théau Peronnin, dyrektor generalny Alice & Bob, firmy opracowującej odporny na błędy system obliczeń kwantowych, Nvidia (NVDA ), niedawno stwierdził, że chociaż technologia kwantowa nie jest jeszcze na tyle zaawansowana, aby zagrozić obecnym systemom kryptograficznym, może stać się wystarczająco potężna, aby je złamać kilka lat po roku 2030.

Ten stanowi zagrożenie nie tylko dla Bitcoin (BTC ) i kryptowalut, ale także wszelkiego szyfrowania bankowego. W wywiadzie dla Fortune powiedział:

„Obietnica komputerów kwantowych to wykładniczy wzrost, ale jeśli oddalimy krzywą wykładniczą, jest ona idealnie płaska – a potem pionowa. Jesteśmy więc dopiero na początku przełomu. Obecnie nie jest ona potężniejsza niż twój smartfon. Ale daj jej kilka lat, a będzie potężniejsza niż największy superkomputer w historii."

Firmy pracują jednak nad rozwiązaniami, a naukowcy poszerzają zasięg sieci kwantowych. W zeszłym miesiącu naukowcy z Wydziału Inżynierii Molekularnej im. Pritzkera Uniwersytetu Chicagowskiego (UChicago PME) zwiększył zasięg połączeń kwantowych3 od kilku kilometrów do 2,000 km.

„Po raz pierwszy technologia budowy globalnego internetu kwantowego jest w zasięgu ręki."

– Asystent profesora Tian Zhong

W ramach swoich badań zespół wydłużył czas koherencji pojedynczych atomów erbu z 0.1 milisekundy do ponad 10 milisekund, a w jednym przypadku osiągnął nawet 24 milisekundy.

Innowacją tutaj było budynek kryształy krytyczne dla Stwórz splątanie kwantowe w inny sposób. W tym celu wykorzystany epitaksja wiązką molekularną (MBE), który jest podobne do drukowania 3D. „Zaczynamy od niczego, a następnie składamy to urządzenie atom po atomie," dodał: „Jakość i czystość tego materiału jest tak wysoka, że właściwości spójności kwantowej tych atomów stają się znakomite”.

Inwestowanie w technologię kwantową

IonQ, Inc. (IONQ ) to firma działająca wyłącznie w obszarze kwantowym, która buduje i komercjalizuje komputery kwantowe, koncentrując się na kubitach z uwięzionymi jonami. Firma oferuje sprzęt kwantowy za pośrednictwem głównych platform chmurowych. Zwiększa dostępność obliczeń kwantowych i przygotowuje je do komercyjnego wykorzystania w miarę, jak technologie kwantowe wkraczają do praktycznego użytku.

Wyniki giełdowe IonQ to odzwierciedlają – akcje spółki są obecnie wyceniane na 48.10 USD, co oznacza spadek o 21% w ciągu ostatniego miesiąca, ale wzrost o ponad 18% od początku roku i 67.56% w ciągu ostatnich trzech lat. Zysk na akcję (TTM) spółki wynosi -5.35, a wskaźnik P/E (TTM) -9.21.

(IONQ )

Jeśli chodzi o siłę finansową firmy, w trzecim kwartale 2025 roku odnotowała ona przychody w wysokości 39.9 mln USD, co stanowi wzrost o 222% rok do roku. Strata netto wyniosła 1.1 mld USD, a zysk na akcję (EPS) według GAAP wyniósł (3.58 USD), a skorygowany (EPS) (0.17 USD).

Na koniec kwartału IonQ dysponował kwotą 1.5 miliarda dolarów w gotówce, ekwiwalentach gotówki i inwestycjach.

„Osiągnęliśmy nasz techniczny kamień milowy na rok 2025, #AQ 64, trzy miesiące przed czasem, odblokowując 36 biliardów razy więcej przestrzeni obliczeniowej niż wiodące komercyjne systemy nadprzewodzące. Osiągnęliśmy prawdziwie historyczny kamień milowy, wykazując rekordową wydajność bramek dwukubitowych na poziomie 99.99%, co podkreśla naszą drogę do 2 milionów kubitów i 80 000 kubitów logicznych w 2030 roku."

– Dyrektor generalny Niccolo de Masi

W tym kwartale firma IonQ sfinalizowała również przejęcie Oxford Ionics i Vector Atomic oraz otrzymała nowy kontrakt z Oak Ridge National Laboratorium zajmujące się opracowywaniem przyspieszonych przepływów pracy w kwantowo-klasycznej technice i zaawansowanych zastosowań energetycznych.

Kliknij tutaj, aby zobaczyć listę pięciu największych firm zajmujących się komputerami kwantowymi.

Najnowsze wiadomości o akcjach spółki IonQ, Inc. (IONQ)

Inwestorzy na wynos

-

Komputery kwantowe osiągnęły punkt zwrotny. Prawdziwe bariery nie dotyczą teraz tego, czy fizyka działa, ale tego, czy faktycznie będziemy w stanie budować te maszyny na dużą skalę. Każdy przełom, który ułatwia chłodzenie kubitów lub zwiększa ich stabilność, przybliża nas do systemu, z którego ludzie będą faktycznie korzystać i za który będą płacić. W rzeczywistości nawet szalone pomysły, takie jak wystrzelenie komputerów kwantowych w stratosferę, zaczynają mieć sens, jeśli rozwiążą rzeczywiste problemy inżynieryjne.

-

Dla inwestorów, którzy chcą się zaangażować, nie wybierając tylko jednej firmy, rozsądnym posunięciem byłoby skupienie się na tych, którzy budują fundamenty. IBM działa w tej branży wystarczająco długo, aby posiadać realną wiedzę specjalistyczną w zakresie sprzętu. Z drugiej strony, IonQ dynamicznie rozwija technologię uwięzionych jonów. Chociaż Nvidia na razie nie buduje kubitów, komputery kwantowe potrzebują solidnych systemów sterowania i mocy obliczeniowej, a właśnie w tym Nvidia sprawdza się najlepiej.

-

Jeśli śledzisz rozwój sytuacji, zwróć uwagę na kilka oznak: kubity, które pozostają stabilne dłużej, wczesne dowody na to, że korekcja błędów może być skalowalna, udane testy splątania na odległość oraz rozwój hybrydowych konfiguracji łączących procesory kwantowe z tradycyjną infrastrukturą obliczeniową.

Wnioski: Kiedy „chmura” staje się kwantowa

Komputery kwantowe szybko ewoluują od zwykłej laboratoryjnej ciekawostki do globalnego wyścigu technologicznego, w którym giganci branży, tacy jak IBM, Google i Nvidia, zwiększają możliwości sprzętowe do niespotykanych dotąd poziomów. Tymczasem przełomy w koherencji kubitów,Korekcja błędów i splątanie na duże odległości systematycznie rozwiązują długotrwałe problemy w tej dziedzinie.

W tym kontekście propozycja KAUST dotyczy pracy nad „przetwarzaniem w chmurze”" namacalna rzeczywistość, zasilana naturalną kriogeniczną temperaturą i nieustannym światłem słonecznym.

Postępy te pokazują, że zbliżamy się do historycznego punktu zwrotnego. W ciągu następnej dekady istnieje bardzo realna możliwość, że obliczenia kwantowe w końcu przejdą z teorii do praktyczność, zmieniając szyfrowanie, naukę i ostatecznie może nawet znaczenie „chmury”" sama.

Kliknij tutaj, aby zobaczyć listę najlepszych akcji spółek zajmujących się przetwarzaniem w chmurze.

Referencje

1. Abderrahim W., Amin O. i Shihada B. Zielone obliczenia kwantowe na niebie. npj Technologia bezprzewodowa 1, Artykuł 5 (2025). https://doi.org/10.1038/s44459-025-00005-y

2. A. Eickbusch, M. McEwen, V. Sivak, A. Bourassa, J. Atalaya, J. Claes, D. Kafri, C. Gidney, C. Warren, J. Gross, A. Opremcak, N. Zobrist, KC Miao, G. Roberts, KJ Satzinger, A. Bengtsson, M. Neeley, WP Livingston, A. Greene, R. Acharya, L. Aghababaie Beni, G. Aigeldinger, R. Alcaraz, TI Andersen, M. Ansmann, F. Arute, …, A. Morvan i in. Demonstracja dynamicznych kodów powierzchniowych. Fizyka przyrody, 2025, Artykuł opublikowany 17 października 2025 r. https://doi.org/10.1038/s41567-025-03070-w

3. Gupta, S., Huang, Y., Liu, S., Pei, Y., Gao, Q., Yang, S., Tomm, N., Warburton, RJ i Zhong, T. (2025). Podwójne epitaksjalne interfejsy spinowo-fotonowe w telekomunikacji o długiej koherencji. Nature Communications, 16, 9814. https://doi.org/10.1038/s41467-025-64780-6