Artificial Intelligence

Inwestowanie w sprzęt AI: od procesorów do jednostek XPU

Securities.io utrzymuje rygorystyczne standardy redakcyjne i może otrzymywać wynagrodzenie z przeglądanych linków. Nie jesteśmy zarejestrowanym doradcą inwestycyjnym i nie jest to porada inwestycyjna. Zapoznaj się z naszymi ujawnienie informacji o stowarzyszeniu.

Inwestowanie w sprzęt AI: podejście oparte na kilofach i łopatach

Wszystko wskazuje na to, że sztuczna inteligencja będzie najważniejszą zmianą w naszej gospodarce, systemach produkcyjnych i społeczeństwie w ciągu ostatnich kilku dekad. W porównaniu z nią nawet radykalne zmiany wprowadzone przez Internet mogą wydawać się błahe.

Może to doprowadzić do zniknięcia całej kategorii zawodów, w tym kierowców, tłumaczy, pracowników obsługi klienta, projektantów stron internetowych itd. Na inne zawody, takie jak programiści, początkujący prawnicy, diagności itd., zapotrzebowanie może radykalnie spaść.

Powinno to również stworzyć dodatkową wartość i zwiększyć produktywność w przypadku wielu innych zadań, przy czym dominujące firmy zajmujące się oprogramowaniem AI prawdopodobnie jako pierwsze osiągną kapitalizację rynkową, która wcześniej była nie do pomyślenia.

Z tych wszystkich powodów rynki kapitałowe i inwestorzy są zafascynowani sztuczną inteligencją i zwracają dużą uwagę na postępy wielu gigantów technologicznych w dziedzinie sztucznej inteligencji, a także na silną konkurencję ze strony chińskich gigantów technologicznych, takich jak Alibaba i startupy takie jak DeepSeek.

Innym sposobem na wykorzystanie boomu na sztuczną inteligencję jest zastosowanie strategii, która sprawdza się w każdej gorączce złota: nie szukaj złota, ale sprzedawaj kilofy i łopaty. To z pewnością sprawdziło się w przypadku firm, które akurat miały najlepszą pozycję do sprzedaży sprzętu zoptymalizowanego pod kątem sztucznej inteligencji, z Nvidia (NVDA -2.17%) przekształcając swoje karty graficzne do gier w układy do trenowania sztucznej inteligencji, co uczyniło ją najcenniejszą firmą na świecie, przekraczając oszałamiającą kapitalizację rynkową wynoszącą 4 biliony dolarów (kliknij link, aby zapoznać się z pełnym raportem na temat firmy Nvidia).

Ponieważ sztuczna inteligencja wymaga bardzo specyficznego sprzętu, znacznie różniącego się od innych dotychczasowych form zadań obliczeniowych, i stanowi ogromną szansę biznesową, branża półprzewodników ściga się obecnie w opracowywaniu nowych rodzajów sprzętu przeznaczonego specjalnie do szkolenia i uruchamiania programów sztucznej inteligencji.

Chociaż Nvidia prawdopodobnie pozostanie jedną z czołowych firm w sektorze, pojawiają się już alternatywy, które mogą okazać się interesującymi okazjami dla inwestorów, którzy zwrócą na to uwagę wcześniej.

Dlaczego sztuczna inteligencja potrzebuje specjalistycznego sprzętu

Wiele małych obliczeń

Początkowe prace nad sztuczną inteligencją wykorzystywały tę samą moc obliczeniową, co inne programy, koncentrując się głównie na procesorach (jednostkach centralnych – CPU). Procesory nadal odgrywają ważną rolę, ale szybko okazało się, że nie są one optymalne dla większości metod stosowanych obecnie w rozwoju sztucznej inteligencji.

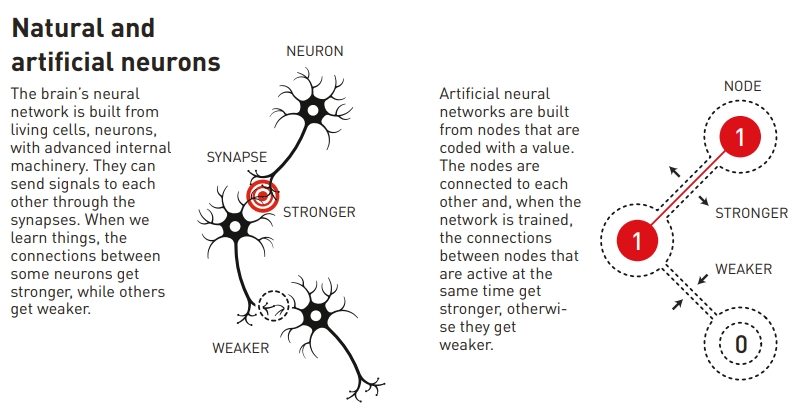

Sieci neuronowe i inne podobne metody wymagają wielu stosunkowo prostych obliczeń zamiast jednego bardzo złożonego. Tak wiele mniejszych układów scalonych pracujących równolegle jest generalnie lepsze niż na potężnych i wydajnych procesorach.

To właśnie w dużej mierze wyjaśnia, dlaczego procesory graficzne zyskały tak dużą popularność, ponieważ są one z założenia projektowane w celu wykonywania tysięcy mniejszych obliczeń równolegle.

Dzisiejsze szkolenia sztucznej inteligencji w dużej mierze opierają się na sieciach neuronowych, koncepcja, która w 2024 roku zdobyła Nagrodę Nobla w dziedzinie fizyki, o której szczegółowo pisaliśmy w poświęconym jej artykule.

Źródło: Nagroda Nobla

Druga rewolucja w technologii AI nadeszła wraz z „transformatorami”. Rozwiązują one problemy tradycyjnych sieci neuronowych. niezdolność do efektywnego przetwarzania długich sekwencji danych, co jest wspólną cechą każdego języka naturalnego.

Wprowadzony po raz pierwszy w 2017 roku przez badaczy Google, jest główną przyczyną obecnego gwałtownego wzrostu potencjału sztucznej inteligencji (AI). Transformatory stanowią rdzeń produktów AI, takich jak LLM (Large Language Models), w tym ChatGPT.

Różne wymagania

Jedną z ważnych różnic w przepływach pracy AI jest różnica między strojenie i wnioskowanie, z których każde ma inne wymagania sprzętowe.

- Strojenie Polega na trenowaniu modelu na danych specyficznych dla danej domeny, co wymaga znacznej mocy obliczeniowej i pamięci. Jest to zadanie bardzo techniczne, często na pograniczu nauki o sztucznej inteligencji.

- Wnioskowanie koncentruje się na wykorzystaniu już wytrenowanego modelu do generowania wyników, wymagając mniejszej mocy obliczeniowej, ale kładąc większy nacisk na niskie opóźnienia i opłacalność.

- Eksperci od sztucznej inteligencji częściej stosują w tym celu gotowe modele, aby rozwiązywać rzeczywiste problemy.

Tak więc, chociaż koszty są oczywistym problemem zarówno w przypadku dostrajania/szkolenia, jak i wnioskowania/użytkowania sztucznej inteligencji, szkolenie często będzie wymagało najlepszego możliwego sprzętu, podczas gdy zadania związane z użytkowaniem będą w większym stopniu koncentrować się na kosztach sprzętu i zużyciu energii przy wyborze najlepszej opcji sprzętowej.

Procesory kontra procesory graficzne

Jednostki centralne (CPU):

Procesory są urządzeniami ogólnego przeznaczenia, a nie sprzętem przeznaczonym specjalnie do sztucznej inteligencji. Są jednak nadal niezbędne do wykonywania instrukcji i wykonywania podstawowych obliczeń w systemach sztucznej inteligencji.

Większość oprogramowania obsługującego interfejs z użytkownikami końcowymi systemu AI również będzie oparta na procesorach, niezależnie od tego, czy będą to pojedyncze komputery, czy oprogramowanie w chmurze.

Źródło: AnandTech

Procesory można również wykorzystać w bardzo prostych systemach sztucznej inteligencji (AI), gdzie dedykowany sprzęt nie jest tak naprawdę wymagany. Jest to szczególnie ważne, gdy dane wyjściowe nie są szczególnie pilne, a stosunkowo wolniejsze przetwarzanie danych przez procesory nie stanowi problemu.

Zatem małe modele z niewielkimi zbiorami danych i obliczeń mogą działać dobrze na procesorach. Wszechobecność procesorów w zwykłych komputerach sprawia, że jest to również dobra opcja dla przeciętnego użytkownika, który nie chce inwestować w sprzęt przeznaczony specjalnie dla sztucznej inteligencji.

Procesory są również bardzo niezawodne i stabilne, co sprawia, że są dobrym wyborem do zadań krytycznych, w których brak błędów jest ważnym kryterium.

Wreszcie, procesory są przydatne do wykonywania niektórych zadań w ramach szkolenia sztucznej inteligencji, zazwyczaj we współpracy z innymi typami sprzętu, takimi jak ładowanie danych, formatowanie, filtrowanie i wizualizacja.

Jednostki przetwarzania grafiki (GPU):

Pierwotnie zaprojektowane do renderowania grafiki, procesory GPU są przeznaczone do przetwarzania równoległego, co czyni je idealnymi do trenowania modeli AI wymagających obsługi dużych zbiorów danych. Przejście z procesorów CPU na procesory GPU skróciło czas trenowania z tygodni do godzin.

Ze względu na powszechną dostępność i doświadczenie specjalistów IT w zakresie ich wykorzystywania, procesory graficzne (GPU) były pierwszym rodzajem sprzętu komputerowego instalowanego seryjnie w celu zwiększenia skali badań nad sztuczną inteligencją.

Źródło: Aorus

Do sukcesu procesorów graficznych przyczyniło się również opracowanie przez firmę Nvidia technologii CUDA, uniwersalnego interfejsu programistycznego dla procesorów graficznych NVIDIA, otwierającego drzwi do zastosowań innych niż gry. Stało się tak, ponieważ niektórzy badacze już wcześniej używali procesorów graficznych do wykonywania obliczeń zamiast typowych superkomputerów.

„Naukowcy zdali sobie sprawę, że kupując kartę do gier o nazwie GeForce, dodajesz ją do swojego komputera i w zasadzie zyskujesz osobisty superkomputer.

Dynamika molekularna, przetwarzanie sejsmiczne, rekonstrukcja tomografii komputerowej, przetwarzanie obrazów — cała masa różnych rzeczy.

Obecnie procesory graficzne nadal należą do najbardziej pożądanych typów sprzętu AI, a Nvidii ledwo udaje się wyprodukować ich wystarczającą ilość, aby zaspokoić popyt gigantów technologicznych budujących gigawatowe centra danych AI.

Jest to również początek „ery super GPU”, wraz z niedawnym wydaniem przez firmę Nvidia GB200 NVL72.

Ten sprzęt został zaprojektowany tak, aby działać jak pojedyncza, potężna karta graficzna prosto z fabryki, zamiast konieczności łączenia wielu mniejszych układów w sieć. Dzięki temu jest znacznie wydajniejszy niż nawet rekordowo szybki model H100.

Źródło: Nvidia

Powinno to również znacznie zwiększyć efektywność energetyczną, co jest kluczowe, ponieważ branża AI może nie mieć wystarczających zasobów energii, zanim zabraknie jej chipów przy tempie, w jakim powstają centra danych AI. Większa wydajność obliczeniowa i energetyczna oznaczają mniej ciepła odpadowego, co tymczasowo rozwiązuje również problem przegrzewania.

| Typ sprzętu | Najlepszy przypadek użycia | Prędkość | Efektywności energetycznej | Elastyczność |

|---|---|---|---|---|

| CPU | Zadania ogólnego przeznaczenia | Niski | Wysoki | Bardzo wysoki |

| GPU | Szkolenie AI i zadania równoległe | Wysoki | Średni | Średni |

| TPU | Operacje tensorowe i transformatory | Bardzo wysoki | Wysoki | Niski |

| ASIC | Przyspieszenie pojedynczego zadania | Bardzo wysoki | Bardzo wysoki | bardzo niska |

| FPGA | Rekonfigurowalne obciążenia AI | Średni | Średni | Wysoki |

Rozwój układów ASIC i sprzętu AI

Układy scalone ASIC (ang. Application-Specific Integrated Circuits) to sprzęt komputerowy zaprojektowany specjalnie do wykonywania określonego zadania obliczeniowego. Dzięki temu są one jeszcze bardziej wyspecjalizowane niż stosunkowo ogólne układy GPU.

Są więc mniej elastyczne i programowalne niż sprzęt ogólnego przeznaczenia.

Z reguły są one bardziej złożone. Są też zazwyczaj droższe, zarówno ze względu na brak oszczędności skali produkcji, jak i koszt projektów niestandardowych.

Są jednak o wiele bardziej wydajne w realizacji powierzonych im zadań, zazwyczaj generują wyniki szybciej, marnując znacznie mniej mocy obliczeniowej i energii.

Układy ASIC i inny sprzęt przeznaczony specjalnie do zastosowań w sztucznej inteligencji cieszą się coraz większym zainteresowaniem, ponieważ w tej dziedzinie coraz częściej zauważa się, że niektóre obliczenia nie są idealnie wykonywane na procesorach graficznych, ale wymagają bardziej specjalistycznego sprzętu.

Jednostki przetwarzające Tensor (TPU)

TPU zostały opracowane przez Google (GOOGL -2.34%) specjalnie do wykonywania obliczeń tensorowych (powiązanych z rachunkiem różniczkowym opartym na transformatorach). Są zoptymalizowane pod kątem arytmetyki o wysokiej przepustowości i niskiej precyzji.

Źródło: C#Corner

Zapewnia to układom TPU wysoką wydajność, efektywność i skalowalność niezbędną do szkolenia dużych sieci neuronowych.

Jednostki TPU posiadają specjalistyczne funkcje, takie jak jednostka mnożenia macierzy (MXU) i opatentowana topologia połączeń, dzięki którym idealnie nadają się do przyspieszania szkolenia i wnioskowania sztucznej inteligencji.

Układy TPU zasilają system Gemini oraz wszystkie aplikacje Google oparte na sztucznej inteligencji, takie jak wyszukiwarka, zdjęcia i mapy, z których korzysta ponad miliard użytkowników.

Ten typ sprzętu może znacznie przyspieszyć rozwój i działanie sieci neuronowych, w których sporadyczne błędy mają mniejsze znaczenie, ponieważ modele te w dużym stopniu opierają się na statystykach i dużej liczbie obliczeń.

Spośród zadań użytkownika końcowego, które najlepiej sprawdzają się w przypadku TPU, należy wymienić głębokie uczenie, rozpoznawanie mowy i klasyfikację obrazów.

Procesory sieci neuronowych (NNP):

Połączone również z jednostkami przetwarzania neuronowego (NPU) i nazywane chipami neuromorficznymi, NPP specjalizują się w obliczeniach sieci neuronowych, zaprojektowanych w celu naśladowania połączeń neuronowych w ludzkim mózgu. Czasami nazywa się je również akceleratorami sztucznej inteligencji (AI), choć termin ten jest mniej precyzyjnie zdefiniowany.

Jednostka NPU będzie również integrować pamięć masową i obliczenia za pomocą wag synaptycznych. Dzięki temu będzie mogła dostosowywać się lub „uczyć” z czasem, co przełoży się na poprawę wydajności operacyjnej.

NPU zawiera specjalne moduły do mnożenia i dodawania, funkcji aktywacji, operacji na danych 2D i dekompresji.

Specjalistyczny moduł mnożenia i dodawania służy do wykonywania operacji istotnych dla przetwarzania aplikacji sieci neuronowych, takich jak mnożenie i dodawanie macierzy, splot, iloczyn skalarny i inne funkcje.

Specjalizacja może pomóc jednostce NPU wykonać operację za pomocą jednego obliczenia zamiast kilku tysięcy w przypadku sprzętu ogólnego przeznaczenia. Na przykład, IBM twierdzi, że NPU może radykalnie poprawić wydajność obliczeń AI w porównaniu z GPU.

„Testy wykazały, że wydajność niektórych układów NPU jest ponad 100 razy lepsza niż porównywalnych układów GPU, przy takim samym zużyciu energii”.

Ze względu na tę energooszczędność, producenci chętnie instalują NPU w urządzeniach użytkowników, gdzie mogą one pomagać w lokalnym wykonywaniu zadań dla generatywnych aplikacji AI, co stanowi przykład „edge computing” (więcej na ten temat poniżej).

Obecnie bada się wiele metod mających na celu tworzenie neuromorficznych układów scalonych:

- Wykorzystaj rodzącą się ferroelektryczność, zjawisko wciąż słabo poznane.

- Aktywne podłoże z wykorzystaniem wanadu lub tytanu.

- Korzystanie z memrystorów, nowy typ komponentu elektronicznego, który może wykonuj zadania AI z szybkością 1/800thnormalnego zużycia energii.

Apomocniczy Pprzetwarzanie Ugnida ((jednostki XPU)

XPU łączy w jednym urządzeniu elektronicznym procesor CPU (CPU), procesor GPU (kartę graficzną/procesory równoległe) i pamięć.

Źródło: Broadcom

XPU to szerokie pojęcie obejmujące wiele wariantów tej koncepcji polegającej na umieszczeniu całego sprzętu w samodzielnych jednostkach, w tym Jednostki przetwarzania danych (DPU), Jednostki przetwarzania infrastruktury (IPU), i Karty akceleratora funkcji (FAC).

XPU są postrzegane jako rozwiązanie rosnącego problemu centrów danych AI, jakim jest rosnące zapotrzebowanie na łączność między podjednostkami, do tego stopnia, że opóźnienia w przesyłaniu danych stają się istotnym czynnikiem spowalniającym obliczenia, większym niż dostępna moc obliczeniowa.

Zasadniczo układy scalone (GPU, TPU, NPP itp.) czekają na dane tak samo, jak faktycznie pracują.

Liderem tej technologii jest Broadcom (AVGO -2.82%), który omówiliśmy szczegółowo w dedykowanym raporcie inwestycyjnym.

Programowalne w terenie układy bramkowe (FPGA):

Układy FPGA to programowalne procesory, co czyni je znacznie bardziej elastycznymi i rekonfigurowalnymi niż bardziej sztywne układy ASIC. Układy FPGA można dostosować do konkretnych algorytmów sztucznej inteligencji (AI), co potencjalnie zapewnia wyższą wydajność i energooszczędność.

Źródło: Laboratoria mikrokontrolerów

Elastyczność ma swoją cenę, ponieważ układy FPGA są zazwyczaj bardziej złożone, droższe i zużywają więcej energii elektrycznej. Mimo to mogą być wydajniejsze niż sprzęt ogólny.

To sprawia, że są one w pewnym sensie produktem niszowym, gdzie ich elastyczność rekompensuje wady. Na przykład, uczenie maszynowe, widzenie komputerowe i przetwarzanie języka naturalnego mogą skorzystać z wszechstronności układów FPGA.

Pamięć o dużej przepustowości (HBM):

Najważniejsze osiągnięcia w dziedzinie sprzętu ukierunkowanego na sztuczną inteligencję dotyczą mocy obliczeniowej, która przez długi czas stanowiła punkt krytyczny w budowaniu większej mocy obliczeniowej do szkolenia nowych sztuczek sztucznej inteligencji.

Jednak systemy te wymagają również wydajnych systemów wspomagających, a pamięć odgrywa w tym ważną rolę. HBM, jak sama nazwa wskazuje, zapewnia większą przepustowość niż tradycyjna pamięć DRAM.

Osiąga się to poprzez pionowe ułożenie wielu kości DRAM i połączenie ich przelotkami krzemowymi (TSV). Pierwsza generacja HBM została opracowana w 2013 roku.

Układanie w pionie oszczędza miejsce i zmniejsza fizyczną odległość, jaką muszą pokonać dane, przyspieszając ich transfer, co jest koniecznością w obliczeniach opartych na sztucznej inteligencji.

Produkcja pamięci HBM jest trudniejsza i droższa niż produkcja pamięci DRAM, jednak korzyści w zakresie wydajności i energooszczędności często uzasadniają wyższy koszt w przypadku zastosowań AI.

Infrastruktura centrum danych AI: zasilanie, chłodzenie i łączność

Oprócz pamięci i mocy obliczeniowej, ważne są również systemy pomocnicze centrów danych AI. Bez nich dane nie mogłyby krążyć wystarczająco szybko, układy scalone przegrzewałyby się, a dostępna moc byłaby niewystarczająca.

Oznacza to, że na przykład sprzęt łączności Broadcom również w dużym stopniu korzysta z rozbudowy centrów danych AI, podobnie jak wyspecjalizowane rozwiązania, takie jak dostawcy sprzętu chłodniczego, na przykład Vertiv (VRT -0.53%) lub Schneider Electric (SU.PA).

Zasilanie może również stać się problemem, a kilku gigantów technologicznych próbuje rozwiązać ten problem, stawiając na energię jądrową, z pierwszym ruchem Microsoftu w 2024 roku, a po nim nastąpiło wiele innych.

W połączeniu z zobowiązaniem firm technologicznych do zmniejszenia śladu węglowego sztucznej inteligencji powinno to przynieść znaczne korzyści firmom działającym w sektorze energii jądrowej lub odnawialnej, takim jak kameka (CCJ -0.72%), GE Vernova (GEV -2.29%), First Solar (FSLR + 2.4%), Następna Era (NEE + 0.26%)lub Partnerzy Energetyczni Brookfield (BEP + 1.02%) (kliknij na link, aby zapoznać się z raportem na temat każdej spółki).

Nowe technologie obliczeniowe AI

Komputery kwantowe

Ponieważ sztuczna inteligencja jest tak łakoma na moc obliczeniową, możliwe jest, że przyszłość sprzętu wykorzystywanego w tej dziedzinie nie będzie nawet odpowiadać obecnie dostępnym rozwiązaniom krzemowym.

Jedną z możliwości jest to, że obliczenia kwantowe można by wykorzystać do wykrywania wzorców znacznie wydajniej niż kiedykolwiek obliczenia klasyczne, coś, co już zostało zbadane przez badaczy.

Komputery kwantowe jako całość mogłyby zostać wykorzystane do rozwiązywania pewnych specyficznych obliczeń, które są praktycznie niemożliwe do wykonania przy użyciu obliczeń binarnych. Prawdopodobnie ostatecznie znajdzie to zastosowanie w sztucznej inteligencji, ale pierwsze komercyjne komputery kwantowe są jeszcze odległe o kilka lat, a powstanie dużej sieci kwantowej jest jeszcze bardziej odległe.

fotonika

Wykorzystując światło zamiast elektronów do przesyłania danych, fotonika może być znacznie szybsza od urządzeń elektronicznych.

Ponieważ komputery kwantowe zazwyczaj przenoszą dane kwantowe za pomocą splątanych fotonów, istnieje również wiele wspólnych obszarów między komputerami kwantowymi a fotoniką, Pierwszy podwójny układ kwantowo-fotoniczny został już ogłoszony.

Organoidy

Ponieważ większość sztucznej inteligencji (AI) odtwarza w komputerach funkcjonowanie sieci neuronowych mózgu, niektórzy badacze zastanawiają się, czy nie moglibyśmy zamiast tego wykorzystać… prawdziwych komórek mózgowych.

To intrygujący pomysł, zwłaszcza że niektóre badania mogą wskazywać, że mózg jest w rzeczywistości organicznym komputerem kwantowym.

Ten typ „komputera” nazywa się organoidami i zasadniczo składa się z neuronów hodowanych w laboratorium na chipie komputerowym. Neurony następnie samoczynnie organizują swoje dendryty i połączenia w odpowiedzi na bodziec z chipa.

Technologia ta jest wciąż nowa i opiera się na biodruk 3D.

Pozostałe

W „Rozważaliśmy inne alternatywy dla obliczeń krzemowych”10 najlepszych firm zajmujących się komputerami innymi niż krzem”, takie jak dwutlenek wanadu, grafen, bramkowanie redoks lub materiały organiczne.

Każdy z nich obiecuje być znacznie szybszy lub znacznie mniej energochłonny niż klasyczne komputery oparte na krzemie. Są one jednak wciąż stosunkowo nowe i mało prawdopodobne, aby zrewolucjonizowały dziedzinę sztucznej inteligencji na skalę komercyjną, przynajmniej w ciągu najbliższych 5-10 lat.

Sztuczna inteligencja w chmurze i sztuczna inteligencja brzegowa: trendy w zakresie dostępności

Chmura AI

Ponieważ najpotężniejsze systemy AI są tworzone przez duże firmy technologiczne, dostęp do nich jest głównie możliwy za pośrednictwem chmury. To samo dotyczy dostępu do samego sprzętu wyspecjalizowanego w AI.

Liderem tego trendu jest Splot rdzeniowy (CRCW -23.08%), firma, która przeszła od dostawcy usług w chmurze do wydobywania kryptowalut z wykorzystaniem procesorów GPU, a dziś zajmuje się dostarczaniem obliczeń AI na żądanie.

Dzięki temu CoreWeave stał się kluczowym partnerem wschodzących startupów zajmujących się sztuczną inteligencją, które próbują konkurować z gigantami technologicznymi, takimi jak Przegięcie AI i jego Klaster GPU o wartości 1.3 mld dolarów, finansowane w ramach nowej rundy finansowania.

„Dwa miesiące temu firma mogła nie istnieć, a teraz może mieć 500 milionów dolarów finansowania kapitału podwyższonego ryzyka.

A najważniejszą rzeczą, którą muszą zrobić, jest zapewnienie sobie dostępu do zasobów obliczeniowych. Nie będą mogli uruchomić swojego produktu ani firmy, dopóki tego nie zrobią”

Ponieważ producenci sprzętu AI zaczynają obawiać się, że duże firmy technologiczne produkują własne procesory graficzne, TPU, XPU itp. i z klientów stają się konkurentami, prawdopodobne jest, że firmy takie jak CoreWeave uzyskają priorytetowy dostęp do najnowszych wydań sprzętu firmy Nvidia i innych.

Ten model biznesowy będzie prawdopodobnie szczególnie ważny w przypadku szkolenia sztucznej inteligencji, które wymaga znacznie większych mocy obliczeniowych niż korzystanie wyłącznie ze sztucznej inteligencji już wyszkolonej.

Edge Computing i komputery ze sztuczną inteligencją

Innym przykładem szybko rozwijającej się dziedziny obliczeń związanych ze sztuczną inteligencją jest potrzeba przeprowadzania obliczeń systemów sztucznej inteligencji na miejscu, jak najbliżej sytuacji rzeczywistych.

Jest to konieczne w przypadku systemów, które nie tolerują odłączenia od sztucznej inteligencji w przypadku zerwania połączenia lub gdy opóźnienie w przesyłaniu danych do chmury i z powrotem jest zbyt duże.

Dobrym przykładem są samochody autonomiczne, od których oczekuje się, że będą w stanie zrozumieć otoczenie także w trybie offline.

Ten rodzaj obliczeń nazywa się przetwarzaniem brzegowym i w dużym stopniu opiera się na wydajniejszym i mniej energochłonnym sprzęcie.

Może zwiększyć niezawodność sztucznej inteligencji (AI), a w miarę zwiększania efektywności modeli, czego przykładem jest postęp technologii DeepSeek, może stać się w przyszłości szerzej stosowanym modelem wdrażania sztucznej inteligencji.

Z tego samego powodu komputery PC ze sztuczną inteligencją jak ten niedawno wprowadzony na rynek przez firmę Nvidia, może w dłuższej perspektywie wystarczyć do uruchomienia wielu aplikacji AI lokalnie, zwiększając prywatność i bezpieczeństwo w porównaniu ze sztuczną inteligencją stale połączoną z chmurą.

Wniosek

Sprzęt AI przez pewien czas był w pewnym sensie synonimem procesorów graficznych (GPU), ponieważ karty graficzne były znacznie wydajniejsze w szkoleniu AI niż inne rodzaje sprzętu, takie jak procesory CPU. To przyniosło fortunę firmie Nvidia i wielu jej wczesnym akcjonariuszom.

Procesory graficzne (GPU), a zwłaszcza „superGPU” zorientowane na sztuczną inteligencję (AI), prawdopodobnie nadal będą odgrywać ważną rolę w budowie centrów danych AI. Będą jednak ewoluować i staną się tylko jednym z elementów coraz bardziej złożonych i wyspecjalizowanych systemów.

Operacje transformatorowe będą wysyłane do układów TPU, sieci neuronowe będą przydzielane do elektrowni jądrowych, a powtarzające się zadania będą przydzielane do dedykowanych układów ASIC lub rekonfigurowanych układów FPGA.

W międzyczasie pamięć o dużej przepustowości, zaawansowane złącza telekomunikacyjne i niezwykle wydajne chłodzenie zapewnią ciągłą pracę wszystkich funkcji pomocniczych wokół rdzenia obliczeniowego.

W przypadku przetwarzania brzegowego i mniejszych SI niż masowe LLM, obliczenia lokalne, być może wspierane przez wielofunkcyjne jednostki XPU, będą prawdopodobnie wykorzystywane przez naukowców, kierowców autonomicznych samochodów i użytkowników zaniepokojonych kwestią prywatności lub cenzury, potencjalnie z wykorzystaniem modeli SI typu open source.

Pewne jest, że zyski ze sprzedaży „kilofów i łopat” sprzętu AI w gorączce złota związanej ze sztuczną inteligencją jeszcze się nie skończyły.

Po okresie dominacji firmy Nvidia inwestorzy mogą chcieć zdywersyfikować ryzyko, rozszerzając portfolio sprzętu AI na inne projekty, a może nawet na firmy energetyczne, które dostarczą cenne gigawaty do zasilania coraz większych i liczniejszych centrów danych AI na świecie.