Trí tuệ nhân tạo

Đầu tư vào phần cứng AI: Từ CPU đến XPU

Securities.io duy trì các tiêu chuẩn biên tập nghiêm ngặt và có thể nhận được khoản bồi thường từ các liên kết được đánh giá. Chúng tôi không phải là cố vấn đầu tư đã đăng ký và đây không phải là lời khuyên đầu tư. Vui lòng xem công bố liên kết.

Đầu tư vào phần cứng AI: Phương pháp tiếp cận kiểu cuốc xẻng

AI hứa hẹn sẽ là sự thay đổi quan trọng nhất trong nền kinh tế, hệ thống sản xuất và xã hội của chúng ta trong vài thập kỷ qua, thậm chí có khả năng khiến những thay đổi cơ bản do Internet mang lại trở nên tầm thường khi so sánh.

Nó có thể khiến toàn bộ một loại công việc biến mất, bao gồm tài xế, biên dịch viên, hỗ trợ khách hàng, nhà thiết kế web, v.v. Những công việc khác có thể chứng kiến sự sụt giảm mạnh về nhu cầu, như lập trình viên, luật sư mới vào nghề, bác sĩ chẩn đoán, v.v.

Nó cũng sẽ tạo ra nhiều giá trị và năng suất bổ sung cho nhiều nhiệm vụ khác, trong đó các công ty phần mềm AI thống trị có thể là những công ty đầu tiên đạt được vốn hóa thị trường mà trước đây không thể tưởng tượng được.

Vì tất cả những lý do này, thị trường vốn và các nhà đầu tư đã bị AI mê hoặc và dành nhiều sự chú ý đến sự tiến bộ của nhiều gã khổng lồ công nghệ trong lĩnh vực AI, cũng như sự cạnh tranh mạnh mẽ đang nổi lên từ các gã khổng lồ công nghệ Trung Quốc như Alibaba và các công ty khởi nghiệp như tìm kiếm sâu.

Một cách khác để tận dụng cơn sốt AI là áp dụng chiến lược đã được biết đến trong mọi cơn sốt vàng: đừng tìm vàng, mà hãy bán cuốc xẻng. Điều này chắc chắn đã hiệu quả với các công ty tình cờ ở vị thế tốt nhất để bán phần cứng được tối ưu hóa cho AI, với Nvidia (NVDA ) đã biến card đồ họa chơi game của mình thành chip đào tạo AI, biến nó trở thành công ty có giá trị nhất thế giới, vượt qua mức vốn hóa thị trường đáng kinh ngạc 4 nghìn tỷ đô la (theo liên kết để biết báo cáo đầy đủ về Nvidia).

Vì AI yêu cầu phần cứng rất cụ thể, khác biệt đáng kể so với các dạng tác vụ tính toán trước đây và là một cơ hội kinh doanh lớn, nên ngành công nghiệp bán dẫn hiện đang chạy đua để phát triển các dạng phần cứng mới được thiết kế riêng cho việc đào tạo và chạy các chương trình AI.

Trong khi Nvidia có khả năng vẫn là một trong những công ty hàng đầu trong lĩnh vực này, các lựa chọn thay thế hiện đang nổi lên và có thể mang đến những cơ hội thú vị cho các nhà đầu tư chú ý sớm.

Tại sao AI cần phần cứng chuyên dụng

Nhiều phép tính nhỏ

Những nỗ lực ban đầu trong lĩnh vực AI sử dụng cùng khả năng tính toán như các chương trình khác, chủ yếu tập trung vào bộ xử lý (Bộ xử lý trung tâm – CPU). CPU vẫn quan trọng, nhưng chúng nhanh chóng nhận ra rằng không phải là lựa chọn tối ưu cho hầu hết các phương pháp hiện đang được sử dụng để phát triển AI.

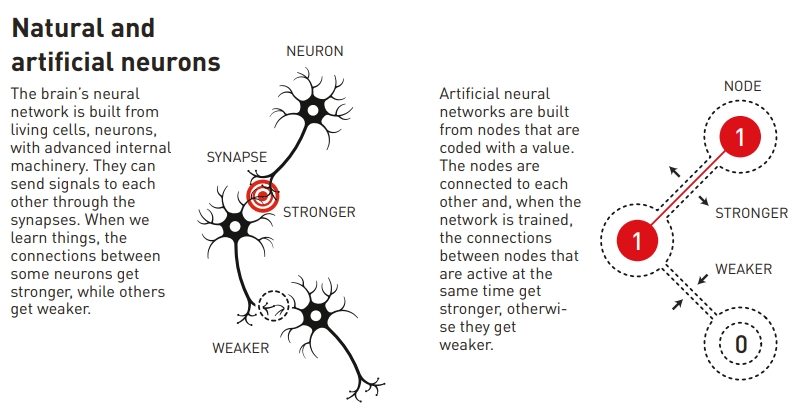

Mạng nơ-ron nhân tạo và các phương pháp tương tự khác đòi hỏi nhiều phép tính tương đối đơn giản, thay vì một phép tính phức tạp. Vì vậy, nhiều chip nhỏ hơn hoạt động song song thường tốt hơn so với các CPU mạnh mẽ và đồ sộ.

Đây chính là lý do chính khiến GPU nhanh chóng trở nên phổ biến hơn, vì card đồ họa vốn được thiết kế để thực hiện hàng nghìn phép tính nhỏ song song.

Đào tạo AI ngày nay phần lớn dựa trên mạng lưới nơ-ron, một khái niệm đã giành được Giải Nobel Vật lý năm 2024, một giải thưởng mà chúng tôi đã đề cập chi tiết trong một bài viết chuyên sâu vào thời điểm đó.

Nguồn: giải thưởng Nobel

Cuộc cách mạng thứ hai trong công nghệ AI xuất hiện với "máy biến áp". Chúng giải quyết các vấn đề của mạng nơ-ron truyền thống. không có khả năng xử lý hiệu quả các chuỗi dữ liệu dài, một đặc điểm chung của bất kỳ ngôn ngữ tự nhiên nào.

Được các nhà nghiên cứu của Google giới thiệu lần đầu tiên vào năm 2017, đây chính là nguyên nhân gốc rễ cho sự bùng nổ năng lực AI hiện nay. Transformers là cốt lõi của các sản phẩm AI như LLM (Mô hình Ngôn ngữ Lớn), bao gồm cả ChatGPT.

Yêu cầu khác nhau

Một sự khác biệt quan trọng trong quy trình làm việc của AI là sự khác biệt giữa tinh chỉnh và suy luận, cả hai đều có yêu cầu về phần cứng riêng biệt.

- Tinh chỉnh bao gồm việc huấn luyện một mô hình trên dữ liệu chuyên biệt của từng miền, đòi hỏi sức mạnh tính toán và bộ nhớ đáng kể. Đây là một nhiệm vụ rất kỹ thuật, thường nằm ở ranh giới của khoa học AI.

- Sự suy luận tập trung vào việc sử dụng một mô hình đã được đào tạo để tạo ra đầu ra, đòi hỏi ít sức mạnh tính toán hơn nhưng tập trung nhiều hơn vào độ trễ thấp và hiệu quả về chi phí.

- Việc này thường được các chuyên gia AI thực hiện bằng cách triển khai các mô hình có sẵn để giải quyết các vấn đề thực tế.

Vì vậy, trong khi chi phí rõ ràng là mối quan tâm đối với cả việc tinh chỉnh/đào tạo và suy luận/sử dụng AI, thì việc đào tạo thường sẽ yêu cầu phần cứng tốt nhất có thể, trong khi các tác vụ sử dụng sẽ tập trung nhiều hơn vào chi phí phần cứng và mức tiêu thụ năng lượng khi chọn tùy chọn phần cứng tốt nhất.

CPU so với GPU

Bộ xử lý trung tâm (CPU):

CPU là phần cứng đa năng và không dành riêng cho AI. Tuy nhiên, chúng vẫn rất cần thiết để thực thi các lệnh và tính toán cơ bản trong hệ thống AI.

Hầu hết các phần mềm xử lý giao diện với người dùng cuối của hệ thống AI cũng sẽ tập trung vào CPU, có thể là máy tính cá nhân hoặc phần mềm dựa trên đám mây.

Nguồn: AnandTech

CPU cũng có thể được sử dụng cho các AI rất đơn giản, nơi không thực sự cần phần cứng chuyên dụng. Điều này đặc biệt đúng khi đầu ra không quá cấp bách và tốc độ xử lý AI tương đối chậm của CPU không phải là vấn đề.

Vì vậy, các mô hình nhỏ với khối lượng dữ liệu và tính toán nhỏ có thể hoạt động tốt trên CPU. Sự hiện diện phổ biến của CPU trong các máy tính thông thường cũng khiến nó trở thành một lựa chọn tốt cho người dùng trung bình không muốn đầu tư vào phần cứng chuyên dụng cho AI.

CPU cũng rất đáng tin cậy và ổn định, khiến chúng trở thành lựa chọn tốt cho các tác vụ quan trọng mà tiêu chí không có lỗi là quan trọng.

Cuối cùng, CPU hữu ích cho một số tác vụ trong đào tạo AI, thường kết hợp với các loại phần cứng khác, như tải dữ liệu, định dạng, lọc và trực quan hóa.

Đơn vị xử lý đồ họa (GPU):

Ban đầu được thiết kế để kết xuất đồ họa, GPU được thiết kế để xử lý song song, khiến chúng trở nên lý tưởng để đào tạo các mô hình AI đòi hỏi phải xử lý các tập dữ liệu lớn. Việc chuyển đổi từ CPU sang GPU đã rút ngắn thời gian đào tạo từ vài tuần xuống còn vài giờ.

Do tính phổ biến rộng rãi và kinh nghiệm làm việc của các chuyên gia CNTT, GPU là loại phần cứng máy tính đầu tiên được lắp đặt theo chuỗi để mở rộng quy mô nghiên cứu AI.

Nguồn: Aorus

Một yếu tố quan trọng khác góp phần vào thành công của GPU là sự phát triển CUDA của Nvidia, một giao diện lập trình đa năng cho GPU của NVIDIA, mở ra cánh cửa cho các ứng dụng khác ngoài chơi game. Điều này được thực hiện bởi vì một số nhà nghiên cứu đã sử dụng GPU để thực hiện tính toán thay vì siêu máy tính thông thường.

Các nhà nghiên cứu nhận ra rằng khi mua card chơi game có tên GeForce, bạn sẽ gắn nó vào máy tính của mình, về cơ bản bạn sẽ có một siêu máy tính cá nhân.

Động lực học phân tử, xử lý địa chấn, tái tạo CT, xử lý hình ảnh—rất nhiều thứ khác nhau.”

Ngày nay, GPU vẫn là một trong những loại phần cứng AI được săn đón nhiều nhất, trong khi Nvidia hầu như không thể sản xuất đủ để đáp ứng nhu cầu của các gã khổng lồ công nghệ đang xây dựng các trung tâm dữ liệu AI quy mô gigawatt.

Đây cũng là sự khởi đầu của “kỷ nguyên siêu GPU”, với sự ra mắt gần đây của Nvidia GB200 NVL72.

Phần cứng này được thiết kế để hoạt động như một GPU khổng lồ duy nhất ngay khi xuất xưởng, thay vì phải kết nối nhiều GPU nhỏ. Điều này khiến nó mạnh mẽ hơn nhiều so với mẫu H100 từng phá kỷ lục trước đó.

Nguồn: Nvidia

Điều này cũng sẽ tiết kiệm năng lượng hơn rất nhiều, một điểm quan trọng vì ngành công nghiệp AI có thể sẽ thiếu năng lượng trước khi thiếu chip với tốc độ xây dựng các trung tâm dữ liệu AI hiện nay. Hiệu suất tính toán và năng lượng cao hơn đồng nghĩa với việc ít nhiệt thải hơn, qua đó tạm thời giải quyết vấn đề quá nhiệt.

| Loại phần cứng | Trường hợp sử dụng tốt nhất | Tốc độ | Hiệu quả năng lượng | Linh hoạt |

|---|---|---|---|---|

| CPU | Nhiệm vụ mục đích chung | Thấp | Cao | Rất cao |

| GPU | Đào tạo AI và nhiệm vụ song song | Cao | Trung bình | Trung bình |

| TPU | Các phép toán và biến đổi tenxơ | Rất cao | Cao | Thấp |

| ASIC | Tăng tốc nhiệm vụ đơn lẻ | Rất cao | Rất cao | Rất thấp |

| FPGA | Khối lượng công việc AI có thể cấu hình lại | Trung bình | Trung bình | Cao |

Sự trỗi dậy của ASIC và phần cứng AI

Mạch tích hợp ứng dụng cụ thể (ASIC) là phần cứng máy tính được thiết kế riêng cho một tác vụ tính toán nhất định, khiến chúng trở nên chuyên biệt hơn so với GPU vẫn tương đối phổ biến.

Vì vậy, chúng kém linh hoạt và khó lập trình hơn so với phần cứng thông thường.

Thông thường, chúng có xu hướng phức tạp hơn. Chúng cũng thường đắt hơn, do thiếu tính kinh tế theo quy mô sản xuất và chi phí thiết kế riêng.

Tuy nhiên, chúng hiệu quả hơn nhiều trong nhiệm vụ được giao, thường tạo ra kết quả nhanh hơn với ít năng lượng và sức mạnh tính toán bị lãng phí hơn.

ASIC và các phần cứng chuyên dụng cho AI khác đang ngày càng được sử dụng rộng rãi vì lĩnh vực này dần nhận thấy rằng một số phép tính không thực hiện được trên GPU một cách lý tưởng mà lại cần đến thiết bị chuyên dụng hơn.

Bộ xử lý Tensor (TPU)

TPU được phát triển bởi Google (GOOGL ) chuyên dụng để thực hiện các phép tính tenxơ (liên quan đến phép tính dựa trên biến áp). Chúng được tối ưu hóa cho phép tính số học thông lượng cao, độ chính xác thấp.

Nguồn: Góc C#

Điều này mang lại cho TPU hiệu suất, hiệu quả và khả năng mở rộng cao để đào tạo các mạng nơ-ron lớn.

TPU sở hữu các tính năng chuyên biệt, chẳng hạn như đơn vị nhân ma trận (MXU) và cấu trúc kết nối độc quyền, giúp chúng trở nên lý tưởng để tăng tốc quá trình đào tạo và suy luận AI.

TPU cung cấp năng lượng cho Gemini và tất cả các ứng dụng hỗ trợ AI của Google như Tìm kiếm, Ảnh và Bản đồ, phục vụ hơn 1 tỷ người dùng.

Loại phần cứng này có thể tăng tốc đáng kể quá trình phát triển và hoạt động của mạng nơ-ron, trong đó lỗi thỉnh thoảng ít quan trọng hơn vì các mô hình này phụ thuộc rất nhiều vào số liệu thống kê và một lượng lớn phép tính ngay từ đầu.

Trong số các tác vụ của người dùng cuối, TPU phù hợp nhất là học sâu, nhận dạng giọng nói và phân loại hình ảnh.

Bộ xử lý mạng nơ-ron (NNP):

Cũng liên quan đến Bộ xử lý thần kinh (NPU) và được gọi là chip hình thái thần kinh, NPP chuyên về tính toán mạng lưới thần kinh, được thiết kế để mô phỏng các kết nối thần kinh trong não người. Chúng đôi khi còn được gọi là bộ tăng tốc AI, mặc dù thuật ngữ này chưa được định nghĩa rõ ràng.

NPU cũng sẽ tích hợp lưu trữ và tính toán thông qua trọng số synap. Nhờ đó, nó có thể điều chỉnh hoặc "học" theo thời gian, giúp cải thiện hiệu quả hoạt động.

NPU bao gồm các mô-đun cụ thể cho phép nhân và phép cộng, hàm kích hoạt, hoạt động dữ liệu 2D và giải nén.

Mô-đun nhân và cộng chuyên dụng được sử dụng để thực hiện các phép toán liên quan đến việc xử lý các ứng dụng mạng nơ-ron, chẳng hạn như tính toán phép nhân và phép cộng ma trận, phép tích chập, tích vô hướng và các hàm khác.

Sự chuyên môn hóa có thể giúp NPU hoàn thành một hoạt động chỉ với một phép tính thay vì hàng nghìn phép tính với phần cứng tổng quát. Ví dụ: IBM tuyên bố rằng NPU có thể cải thiện đáng kể hiệu quả tính toán AI so với GPU.

“Các cuộc thử nghiệm đã chỉ ra rằng hiệu suất của một số NPU tốt hơn gấp 100 lần so với GPU tương đương, với mức tiêu thụ điện năng như nhau.”

Nhờ hiệu quả năng lượng này, NPU được các nhà sản xuất ưa chuộng lắp đặt trong thiết bị của người dùng, nơi chúng có thể giúp thực hiện các tác vụ cục bộ cho các ứng dụng AI tạo sinh, một ví dụ về "điện toán biên". (xem thêm về chủ đề này bên dưới).

Hiện nay, nhiều phương pháp đang được khám phá để tạo ra chip mô phỏng thần kinh:

- Tận dụng tính sắt điện mới chớm nở, một hiện tượng vẫn chưa được hiểu rõ.

- Chất nền hoạt động sử dụng vanadi hoặc titan.

- Sử dụng memristor, một loại linh kiện điện tử mới, có thể thực hiện các nhiệm vụ AI ở mức 1/800thcủa mức tiêu thụ điện năng bình thường.

Aphụ nữ Pđánh giá Utrứng chí (XPU)

XPU kết hợp CPU (bộ xử lý), GPU (card đồ họa/bộ xử lý song song) và bộ nhớ thành cùng một thiết bị điện tử.

Nguồn: Broadcom

XPU là một thuật ngữ rộng, bao gồm nhiều biến thể của khái niệm này về việc đưa tất cả phần cứng vào các đơn vị độc lập, bao gồm Đơn vị xử lý dữ liệu (DPU), Đơn vị xử lý cơ sở hạ tầng (IPU)và Thẻ tăng tốc chức năng (FAC).

XPU được xem là giải pháp giải quyết vấn đề ngày càng gia tăng của các trung tâm dữ liệu AI, đó là nhu cầu kết nối ngày càng tăng giữa các đơn vị phụ, đến mức độ trễ dữ liệu trở thành yếu tố quan trọng làm chậm quá trình tính toán, hơn cả công suất tính toán hiện có.

Về cơ bản, các chip (GPU, TPU, NPP, v.v.) đang chờ dữ liệu nhiều như chúng thực sự hoạt động.

Người dẫn đầu công nghệ này là Broadcom (AVGO ), Mà chúng tôi đã thảo luận chi tiết trong một báo cáo đầu tư chuyên dụng.

Mảng cổng lập trình được (FPGA):

FPGA là bộ xử lý có thể lập trình, khiến chúng linh hoạt và dễ cấu hình hơn đáng kể so với các ASIC cứng nhắc hơn. FPGA có thể được tùy chỉnh cho các thuật toán AI cụ thể, có khả năng mang lại hiệu suất và hiệu quả năng lượng cao hơn.

Tính linh hoạt này cũng đi kèm với cái giá phải trả, vì FPGA thường phức tạp hơn, đắt hơn và tiêu thụ nhiều điện năng hơn. Tuy nhiên, chúng vẫn có thể hiệu quả hơn phần cứng thông thường.

Điều này khiến chúng trở thành một sản phẩm ngách, nơi tính linh hoạt của chúng bù đắp cho những nhược điểm. Ví dụ, học máy, thị giác máy tính và xử lý ngôn ngữ tự nhiên có thể được hưởng lợi từ tính linh hoạt của FPGA.

Bộ nhớ băng thông cao (HBM):

Những phát triển quan trọng nhất trong phần cứng tùy chỉnh tập trung vào AI nằm ở lĩnh vực sức mạnh tính toán, từ lâu đã là điểm nghẽn trong việc xây dựng thêm năng lực tính toán để đào tạo AI mới.

Tuy nhiên, các hệ thống này cũng cần hệ thống hỗ trợ hiệu suất cao, trong đó bộ nhớ là một yếu tố quan trọng. Đúng như tên gọi, HBM cung cấp băng thông cao hơn DRAM truyền thống.

Điều này đạt được bằng cách xếp chồng nhiều đế DRAM theo chiều dọc và kết nối chúng bằng các via silicon xuyên qua (TSV). Thế hệ HBM đầu tiên được phát triển vào năm 2013.

Việc xếp chồng theo chiều dọc giúp tiết kiệm không gian và giảm khoảng cách vật lý mà dữ liệu cần di chuyển, tăng tốc độ truyền dữ liệu, một điều cần thiết trong điện toán AI.

HBM phức tạp hơn trong sản xuất và đắt hơn DRAM, nhưng hiệu suất và hiệu quả sử dụng điện năng thường bù đắp cho chi phí cao hơn đối với các ứng dụng AI.

Cơ sở hạ tầng trung tâm dữ liệu AI: Nguồn điện, hệ thống làm mát và kết nối

Bên cạnh bộ nhớ và sức mạnh tính toán, các hệ thống phụ trợ của trung tâm dữ liệu AI cũng rất quan trọng. Nếu không có chúng, dữ liệu sẽ không thể lưu thông đủ nhanh, chip sẽ quá nhiệt hoặc nguồn điện không đủ.

Điều này có nghĩa là, ví dụ, phần cứng kết nối Broadcom cũng được hưởng lợi rất nhiều từ việc xây dựng trung tâm dữ liệu AI, cũng như các giải pháp chuyên biệt như nhà cung cấp thiết bị làm mát, ví dụ như Vertiv (VRT ) hoặc Schneider Electric (SU.PA).

Nguồn cung cấp điện cũng có thể trở thành một vấn đề và một số gã khổng lồ công nghệ đang cố gắng giải quyết vấn đề này bằng cách đặt cược vào năng lượng hạt nhân. với động thái đầu tiên của Microsoft vào năm 2024, tiếp theo là nhiều người khác kể từ đó.

Kết hợp với cam kết giảm lượng khí thải carbon của AI từ các công ty công nghệ, điều này sẽ mang lại lợi ích to lớn cho các công ty trong lĩnh vực năng lượng hạt nhân hoặc năng lượng tái tạo, như khách mời (CCJ ), GE Vernova (GEV ), năng lượng mặt trời đầu tiên (FSLR ), kỷ nguyên tiếp theo (NEE ), hoặc là Đối tác năng lượng Brookfield (BEP ) (theo các liên kết để biết báo cáo về từng công ty).

Công nghệ điện toán AI mới nổi

Tính toán lượng tử

Vì AI rất cần sức mạnh tính toán nên có khả năng tương lai của phần cứng trong lĩnh vực này sẽ không phụ thuộc vào các giải pháp silicon hiện có.

Một khả năng là máy tính lượng tử có thể được sử dụng để phát hiện các mẫu hiệu quả hơn nhiều so với máy tính cổ điển, một cái gì đó đã được các nhà nghiên cứu khám phá.

Điện toán lượng tử nói chung có thể được sử dụng để giải quyết một số phép tính cụ thể mà điện toán nhị phân gần như không thể. Điều này cuối cùng có thể sẽ được áp dụng cho AI, nhưng những chiếc máy tính lượng tử thương mại đầu tiên vẫn còn phải mất vài năm nữa, và một mạng lưới lượng tử lớn thậm chí còn xa hơn nữa.

Quang tử

Sử dụng ánh sáng thay vì electron để truyền dữ liệu, quang tử có thể nhanh hơn nhiều so với các thiết bị điện tử.

Bởi vì máy tính lượng tử thường mang dữ liệu lượng tử với các photon rối, nên cũng có rất nhiều sự chồng chéo giữa máy tính lượng tử và quang tử, và chip lượng tử-photonic kép đầu tiên đã được công bố.

chất hữu cơ

Vì hầu hết AI đều mô phỏng hoạt động của mạng lưới nơ-ron thần kinh trong não trên máy tính, nên một số nhà nghiên cứu đang tự hỏi liệu chúng ta có thể sử dụng… các tế bào não thực sự hay không.

Đây là một ý tưởng hấp dẫn, đặc biệt là khi một số nghiên cứu có thể chỉ ra rằng bộ não thực sự là một máy tính lượng tử hữu cơ.

Loại "máy tính" này được gọi là organoid, về cơ bản bao gồm các tế bào thần kinh được nuôi cấy trong phòng thí nghiệm trên một con chip máy tính. Sau đó, các tế bào thần kinh tự tổ chức các sợi nhánh và kết nối của chúng để đáp ứng với kích thích từ con chip.

Công nghệ này vẫn còn mới và dựa vào in sinh học 3D.

Khác

Chúng tôi đã khám phá các giải pháp thay thế khác cho điện toán silicon trong “10 công ty điện toán phi silicon hàng đầu”, chẳng hạn như vanadi dioxit, graphene, cổng oxy hóa khử hoặc vật liệu hữu cơ.

Mỗi công nghệ đều hứa hẹn sẽ nhanh hơn nhiều hoặc tiêu tốn ít năng lượng hơn so với điện toán dựa trên silicon cổ điển. Tuy nhiên, chúng vẫn còn tương đối mới và khó có thể cách mạng hóa lĩnh vực AI ở quy mô thương mại, ít nhất là trong 5-10 năm tới.

AI đám mây và AI biên: Xu hướng khả năng truy cập

AI đám mây

Vì các hệ thống AI mạnh mẽ nhất được phát triển bởi các công ty công nghệ lớn, nên chúng chủ yếu được truy cập thông qua đám mây. Điều tương tự cũng đang diễn ra đối với việc truy cập vào phần cứng chuyên dụng cho AI.

Người dẫn đầu xu hướng này là lõi dệt (CRCW ), một công ty chuyển từ nhà cung cấp dịch vụ đám mây sang khai thác tiền điện tử bằng GPU, cho đến ngày nay cung cấp dịch vụ điện toán AI theo yêu cầu.

Điều này khiến CoreWeave trở thành đối tác quan trọng của các công ty khởi nghiệp AI sắp ra mắt đang cố gắng cạnh tranh với các gã khổng lồ công nghệ, như Trí tuệ nhân tạo và của mình Cụm GPU trị giá 1.3 tỷ đô la, được tài trợ bởi một vòng tài trợ mới.

“Hai tháng trước, một công ty có thể chưa tồn tại, nhưng bây giờ họ có thể có 500 triệu đô la tiền đầu tư mạo hiểm.

Và điều quan trọng nhất họ cần làm là đảm bảo quyền truy cập an toàn vào máy tính; họ không thể ra mắt sản phẩm hoặc khởi nghiệp kinh doanh cho đến khi có được nó,”

Khi những người chơi chuyên nghiệp trong lĩnh vực phần cứng AI trở nên cảnh giác với các công ty công nghệ lớn sản xuất GPU, TPU, XPU, v.v. của riêng họ và chuyển từ khách hàng sang đối thủ cạnh tranh, thì rất có thể các công ty như CoreWeave sẽ được ưu tiên tiếp cận với bản phát hành phần cứng mới nhất của Nvidia và các công ty khác.

Mô hình kinh doanh này có thể đặc biệt quan trọng đối với việc đào tạo AI, vốn đòi hỏi năng lực tính toán cao hơn nhiều so với việc chỉ sử dụng các AI đã được đào tạo.

Máy tính biên và AI

Một trường hợp khác về điện toán AI đang phát triển nhanh chóng là nhu cầu thực hiện điện toán cho các hệ thống AI ngay tại chỗ, càng gần với các tình huống thực tế càng tốt.

Đây là điều bắt buộc đối với các hệ thống không thể ngắt kết nối với AI nếu kết nối bị lỗi hoặc khi độ trễ khi trao đổi dữ liệu qua lại với đám mây quá chậm.

Một ví dụ điển hình là xe tự lái, được kỳ vọng có thể hiểu được môi trường xung quanh khi ngoại tuyến.

Loại tính toán này được gọi là điện toán biên và được hưởng lợi rất nhiều từ phần cứng hiệu quả hơn và ít tốn điện năng hơn.

Nó có thể tăng độ tin cậy của AI và khi các mô hình trở nên hiệu quả hơn, minh họa bằng bước tiến vượt bậc của DeepSeek, nó có thể trở thành mô hình triển khai AI phổ biến hơn trong tương lai.

Vì lý do tương tự, máy tính cá nhân AI giống như cái mới được Nvidia ra mắt gần đây, về lâu dài có thể đủ để chạy nhiều ứng dụng AI cục bộ, tăng cường quyền riêng tư và bảo mật so với việc luôn kết nối với AI đám mây.

Kết luận

Phần cứng AI từ lâu đã được coi là đồng nghĩa với GPU, vì card đồ họa hiệu quả hơn nhiều trong việc đào tạo AI so với các loại phần cứng khác như CPU. Điều này đã tạo nên vận may cho Nvidia và nhiều cổ đông ban đầu của công ty.

GPU, đặc biệt là các "siêu GPU" tập trung vào AI, có thể sẽ vẫn đóng vai trò quan trọng trong việc xây dựng các trung tâm dữ liệu AI. Tuy nhiên, chúng sẽ dần trở thành một thành phần của các hệ thống ngày càng phức tạp và chuyên biệt.

Các hoạt động của máy biến áp sẽ được gửi đến TPU, mạng nơ-ron giao nhiệm vụ cho NPP, lặp lại các nhiệm vụ cho ASIC chuyên dụng hoặc FPGA được cấu hình lại.

Trong khi đó, bộ nhớ băng thông cao, đầu nối viễn thông tiên tiến và hệ thống làm mát siêu hiệu quả sẽ duy trì mọi chức năng phụ trợ xung quanh lõi máy tính.

Đối với điện toán biên và AI nhỏ hơn so với LLM khổng lồ, điện toán cục bộ, có thể được cung cấp bởi XPU tất cả trong một, có thể sẽ được các nhà khoa học, xe tự lái và người dùng quan tâm đến quyền riêng tư hoặc kiểm duyệt sử dụng, có khả năng với các mô hình AI nguồn mở.

Điều chắc chắn là lợi nhuận từ việc bán "cuốc xẻng" phần cứng AI trong cơn sốt vàng AI vẫn chưa chấm dứt.

Sau một thời gian bị Nvidia thống trị, các nhà đầu tư có thể muốn đa dạng hóa rủi ro bằng cách mở rộng danh mục phần cứng IA của mình sang các thiết kế khác, và thậm chí có thể là các công ty điện lực sẽ cung cấp các gigawatt quý giá để vận hành các trung tâm dữ liệu AI ngày càng lớn và nhiều trên thế giới.